昨天,OpenAI 正式發佈了 GPT-5.4 mini 與 nano。

不少免費用戶在刷新 ChatGPT 後,很快就感受到了變化:回答速度更快,代碼處理更穩,整體交互也更流暢。對普通用戶來說,這種變化未必第一時間能被準確描述出來,但體驗上的提升已經相當明顯。

GPT-5.4 mini 的定位非常清晰:高吞吐、低延遲,面向子智能體、並行 Agent、編碼以及 computer use 等高頻場景。

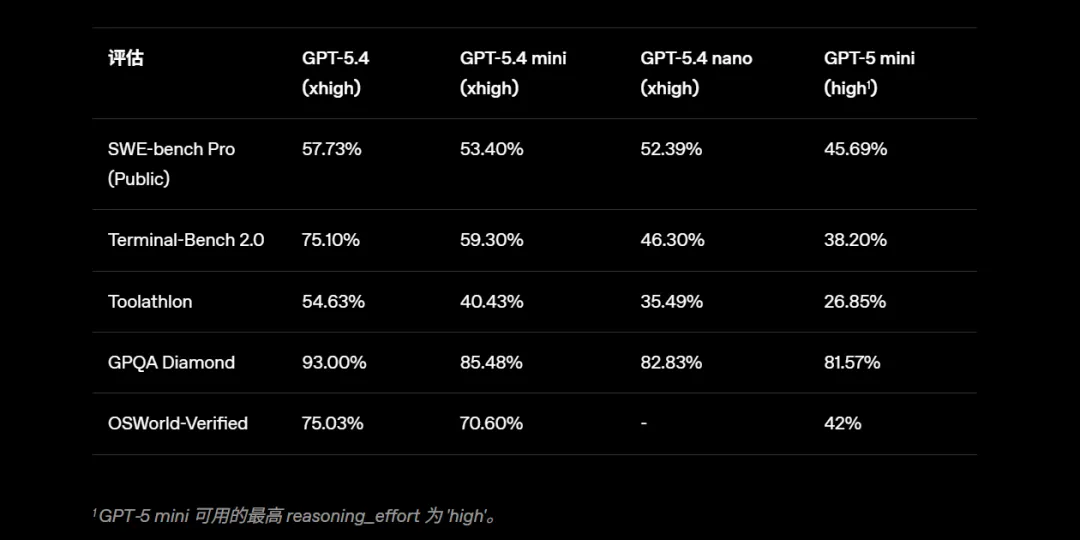

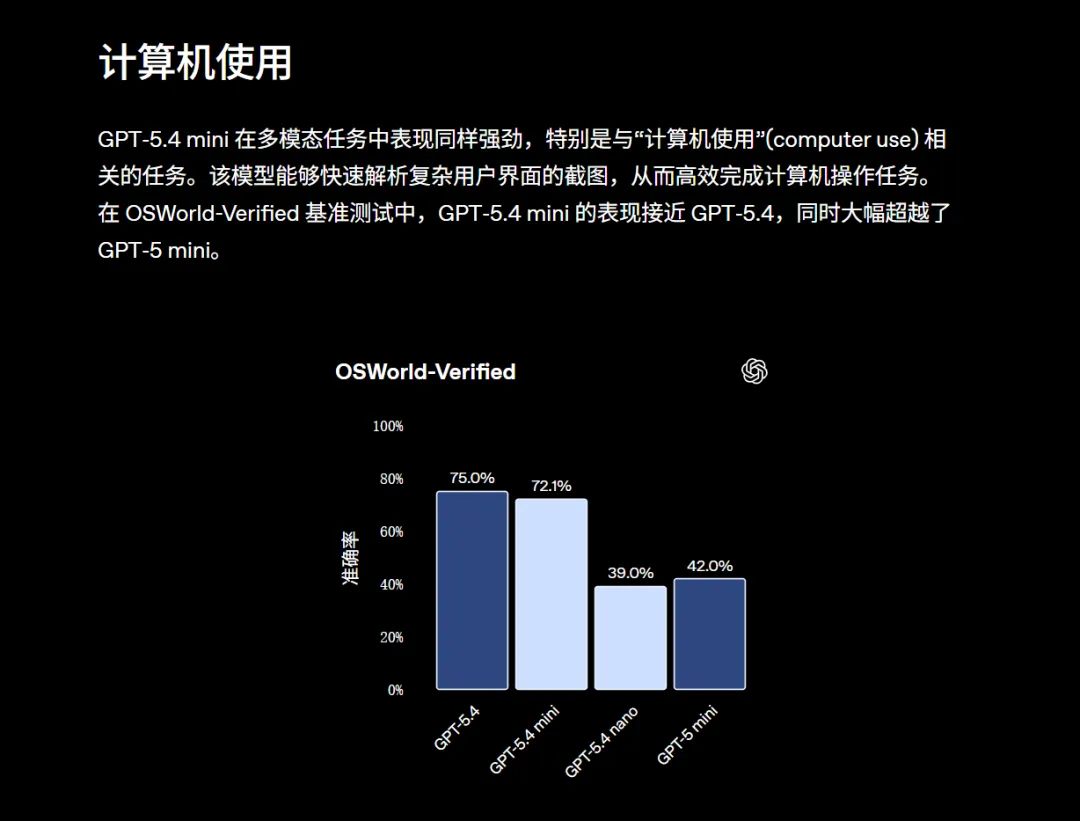

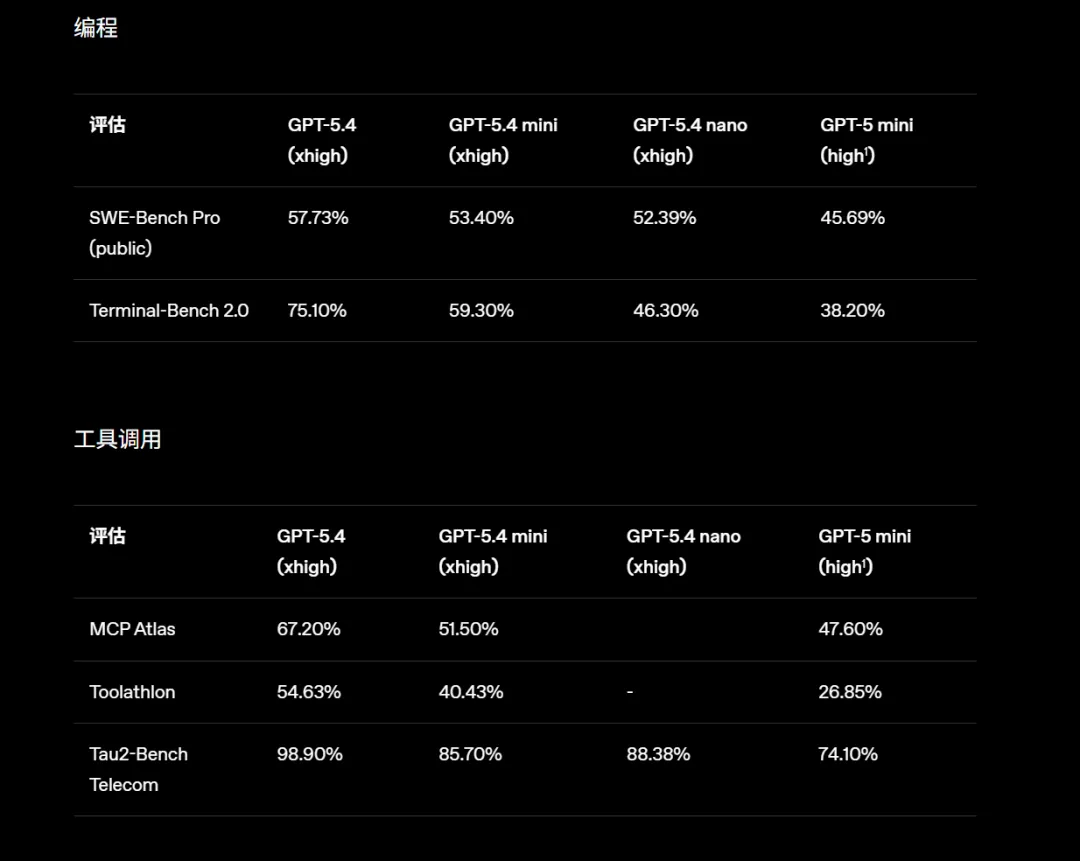

相比此前的 GPT-5 mini,它在代碼、推理、多模態理解和工具調用方面都有明顯提升;在 SWE-Bench Pro、OSWorld-Verified 等評測中,表現已經逼近旗艦 GPT-5.4,而運行速度則超過舊版兩倍。

nano 則在輕量化的路上走得更進一步。

它主打分類、數據提取、排序、輕量編碼等高重複任務,重點不是“更全面”,而是“更快、更便宜、更適合規模化調用”,不過目前 nano 僅通過 API 提供,但在速度與成本上的優勢已經非常突出。

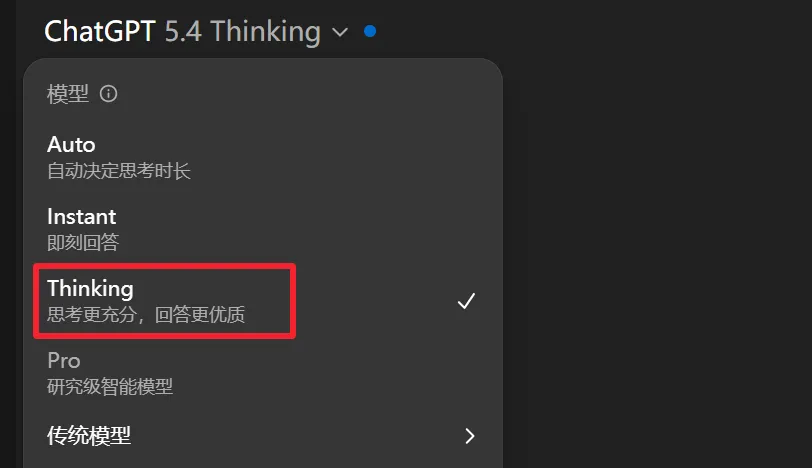

在 ChatGPT 端,免費版和 Go 用戶現在可以直接通過 “+” 菜單中的 “Thinking” 使用 GPT-5.4 mini;對付費用戶而言,它則會作爲 GPT-5.4 Thinking 的速率限制備選方案出現。

與此同時,400K 上下文窗口、圖片輸入、工具調用、web search、file search、computer use 等能力也都已經覆蓋。

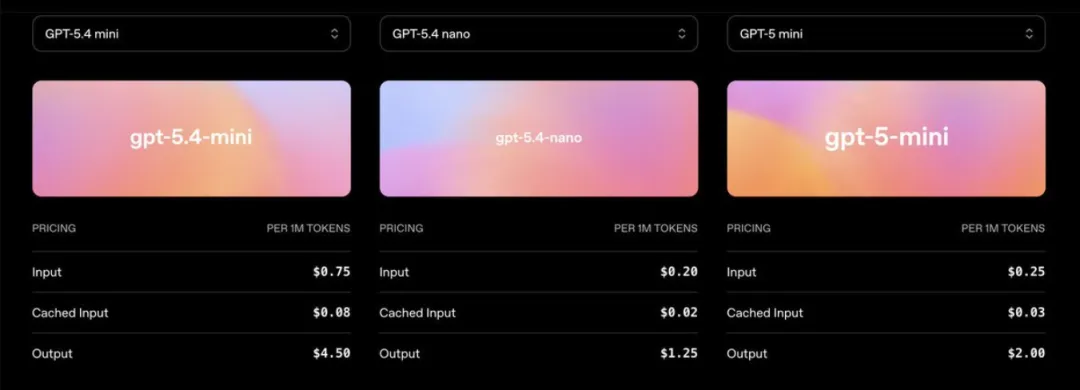

價格層面,這次的調整就很有吸引力了。

GPT-5.4 mini 的 API 定價爲每百萬輸入 token 0.75 刀、輸出 4.5 刀;nano 則進一步下探到輸入 0.2 刀、輸出 1.25 刀。

這也是目前 OpenAI 在 GPT-5.4 系列中最便宜的兩檔模型,對於成本敏感型項目來說,整體調用支出有機會被大幅壓縮。

開發者側的反饋也來得很快。

已經有人開始把整條產品流水線切換到 mini,最直接的感受就是響應更平滑、整體更穩定。

過去一些原本必須依賴大模型完成的任務,如今 mini 已經能夠較穩地承接;而 nano 則進一步覆蓋了那些高頻、重複、但又無法忽略的基礎工作。

這次發佈,也讓 OpenAI 的模型家族化策略變得更清楚了:

旗艦模型繼續負責最複雜、最關鍵的任務;mini 用來承擔大量並行子智能體和中高頻執行任務;nano 則進一步向底層重複勞動下沉。

對整個 Agentic Workflow 來說,這種分層意味着成本結構和調度方式都在被重新改寫。在過去,搭建多 Agent 系統時,團隊往往需要在效果、速率和成本之間反覆權衡。

現在,mini 以更低價格提供接近旗艦的能力,遷移門檻顯著下降;而免費用戶也意外獲得了體驗上的直接收益。。無論是寫代碼,還是處理日常任務,ChatGPT 免費版的可用性都在被進一步抬高。

這次 OpenAI 對旗艦能力的下放,可以說相當徹底。

普通用戶可能還沒有完全意識到 ChatGPT 免費版已經變強了多少,但開發者已經率先感受到了速度與成本被同時釋放的現實價值——很便宜,還好用。

GPT-5.4 mini 和 nano 的發佈,把 OpenAI 的模型家族中,性價比選手的空位補上了,今後,高頻任務不再需要持續調用旗艦模型,成本和效率都有了新的平衡點。

對於普通用戶和開發者來說,這都是一次很實際、也值得關注的更新。

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com