有句話說得好,敵人的敵人就是朋友。

在面對共同的“敵人”時,大美麗的AI巨頭們這次似乎“很有默契”地選擇站到了一起來抵抗我們這邊的AI公司。

近期,OpenAI、Anthropic 和Google通過共同成立的Frontier Model Forum,開始共享“對抗性蒸餾”相關信息。

“對抗性蒸餾”,這個描述就很有意思。

光聽着就有一定的火藥味,把正常的知識轉移直接上升到了對抗層面,彷彿別人從你模型裏學東西就是在發動一場“偷襲”。

這個組織的官網我也替大家看了,是一個圍繞大模型安全問題而成立的組織,各種口號和理念倒是寫得很先進,似乎在爲全人類着想。

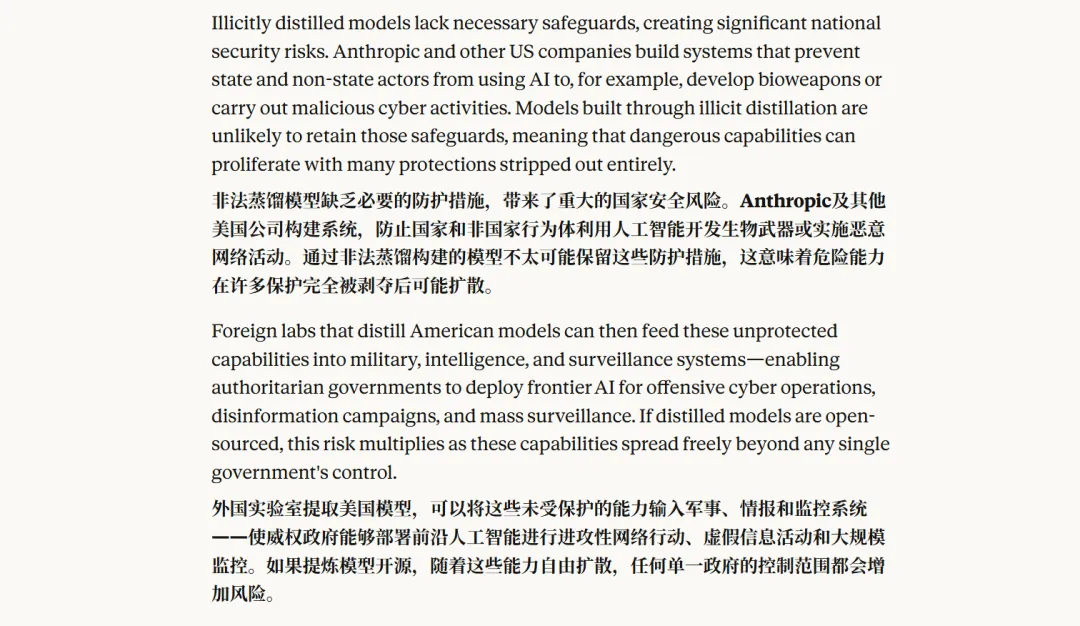

不過實際上,目前該組織的核心目標就是以“安全”的名義,想辦法阻止我們這邊的AI公司去使用他們的模型,僅此而已。

OpenAI 甚至在提交給大美麗國會的備忘錄裏直接點名 DeepSeek。

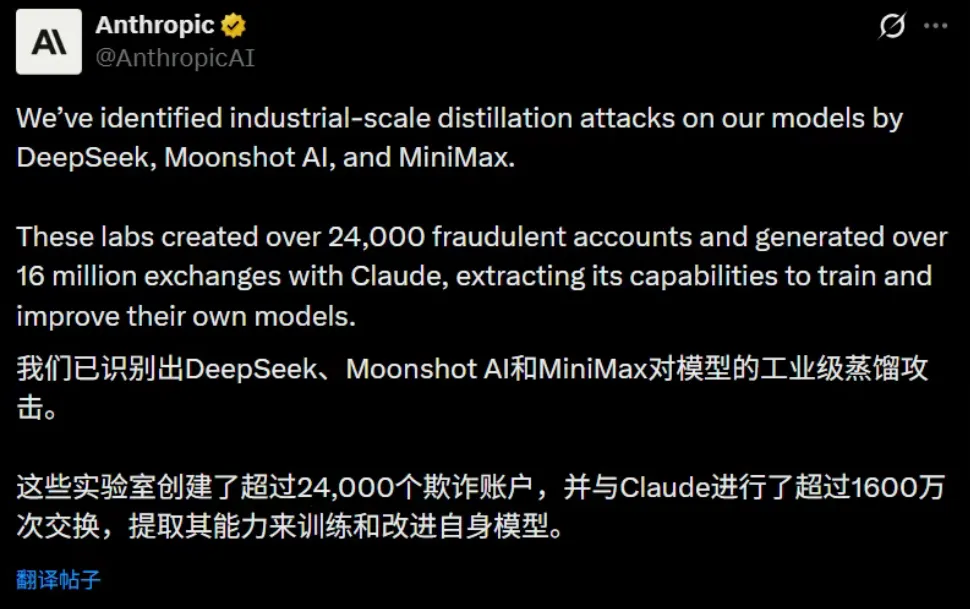

Anthropic 不用多說了,大美麗急先鋒,沒有之一。

Google 雖然沒有公開細節,但說三方都表示會繼續合作。

說起蒸餾,這事都不用我多說了——大美麗的AI公司自己也經常幹類似的事。

已經不知道有多少次,在有人問 ChatGPT/Gemini/Claude “你是誰”時,它們會抽風直接回答自己是來自國內的某家AI,或者承認用了大量中文數據訓練。

結果現在輪到別人從它們模型裏學東西,就立刻喊“國家安全”“工業級攻擊”。

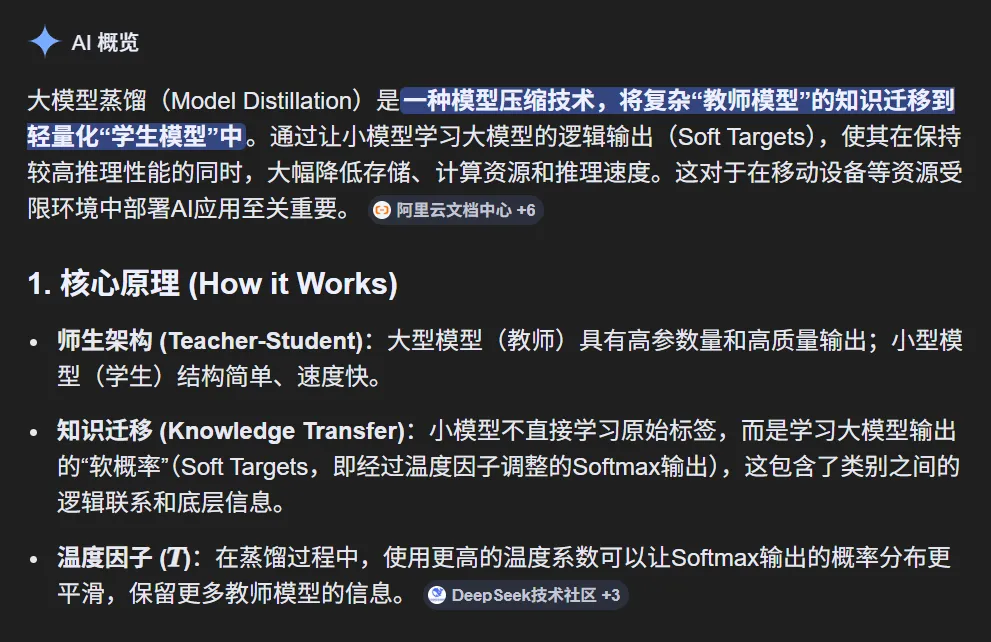

蒸餾這種做法在AI行業早就不是什麼祕密。

它本質上是用強模型的輸出訓練弱模型,實現能力快速遷移和成本大幅壓縮。很多模型(不管是GPT還是Gemini、Claude,乃至 DeepSeek)都用過這種方式,在短時間內把推理、編碼、多模態等能力追了上來。

對於行業而言,這是一種幾乎公開的做法,通過這種方式,可以在相對較短的時間內,讓一個較弱的模型快速學習到較強的模型的能力以實現進步。

可大美麗這邊就很雙標了。

我可以蒸餾你,這叫“技術進步”“推動人類文明發展”;

你們不能蒸餾我,因爲事關“美麗安全”,你們會把技術用於軍事,這是“非法的”。

這其中,以 Anthropic 2月那篇長文尤其典型,高調指責DeepSeek、月之暗面、MiniMax 蒸餾 Claude,喊得義正詞嚴。

這就很幽默了。

只要你面對公衆提供服務,那麼技術擴散的速度永遠比封鎖快,這點在AI圈已經反覆驗證過了。

就以國外的模型爲例,Meta Llama系列剛開源沒多久就被Fork了無數個版本,Flux 一放出來就變成人人可用的圖像生成底座,早期的 GPT-3 輸出也被拿去訓練了一堆小模型。

想徹底堵住?幾乎不可能。

技術這東西,一旦到了公開可用的地步,就跟水一樣,哪裏有縫往哪裏流。

更搞笑的是,它們堵了半天,最後估計還是堵不住。

話糙理不糙

隨便整個中轉、換個IP、或者想想別的辦法,該蒸餾還是一樣蒸餾。

就跟他們蒸餾我們的這邊的模型一樣(甚至門檻更低)。

最後,希望大美麗的AI公司能稍微放下一些偏見,別把所有精力都放在怎麼防別人上。真正推動技術進步的,還是大家一起把模型做得更好、讓更多人用得上,而不是天天盯着別人怎麼學自己。

AI發展到現在,已經不是誰藏着掖着就能領先的時代了。

開放、競爭、互相學習,纔是讓整個行業真正往前走的正確方式。

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com