有句话说得好,敌人的敌人就是朋友。

在面对共同的“敌人”时,大美丽的AI巨头们这次似乎“很有默契”地选择站到了一起来抵抗我们这边的AI公司。

近期,OpenAI、Anthropic 和Google通过共同成立的Frontier Model Forum,开始共享“对抗性蒸馏”相关信息。

“对抗性蒸馏”,这个描述就很有意思。

光听着就有一定的火药味,把正常的知识转移直接上升到了对抗层面,仿佛别人从你模型里学东西就是在发动一场“偷袭”。

这个组织的官网我也替大家看了,是一个围绕大模型安全问题而成立的组织,各种口号和理念倒是写得很先进,似乎在为全人类着想。

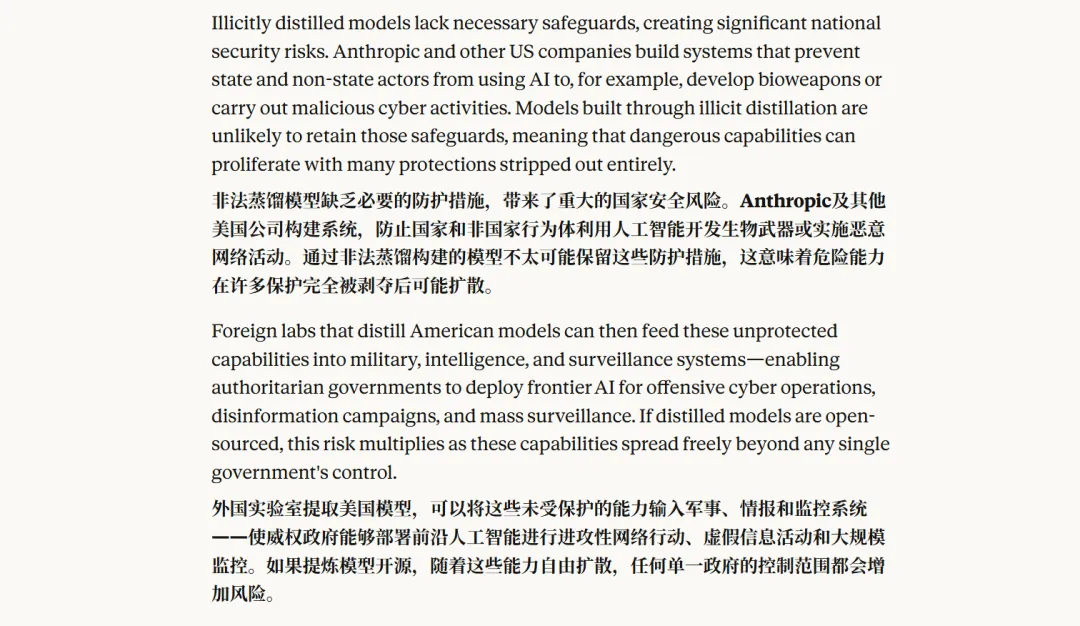

不过实际上,目前该组织的核心目标就是以“安全”的名义,想办法阻止我们这边的AI公司去使用他们的模型,仅此而已。

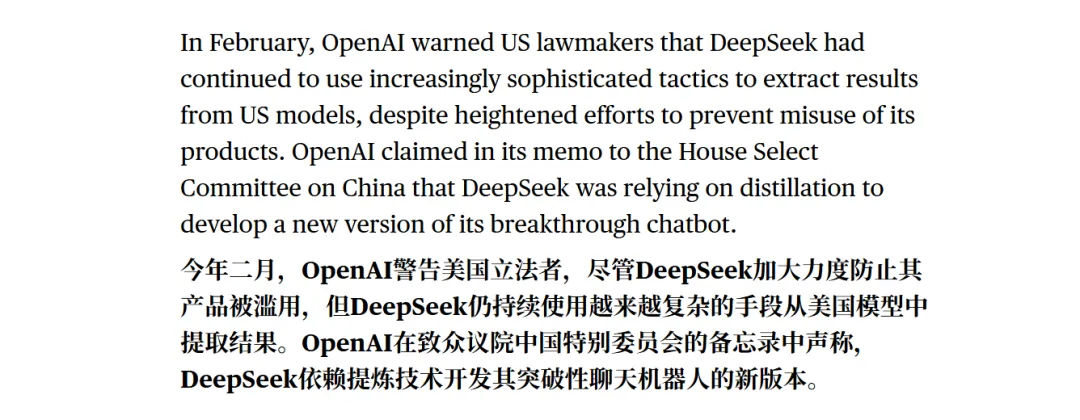

OpenAI 甚至在提交给大美丽国会的备忘录里直接点名 DeepSeek。

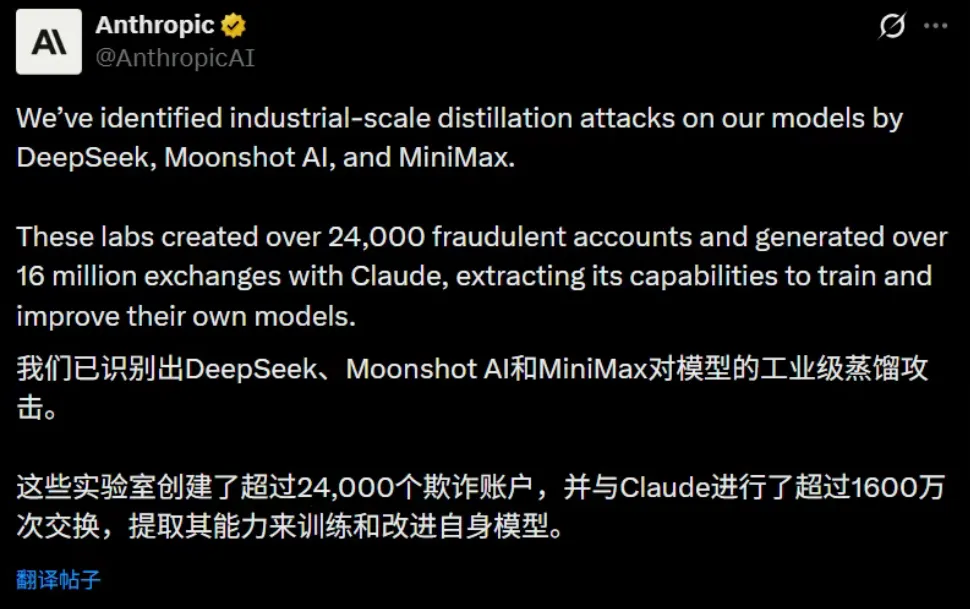

Anthropic 不用多说了,大美丽急先锋,没有之一。

Google 虽然没有公开细节,但说三方都表示会继续合作。

说起蒸馏,这事都不用我多说了——大美丽的AI公司自己也经常干类似的事。

已经不知道有多少次,在有人问 ChatGPT/Gemini/Claude “你是谁”时,它们会抽风直接回答自己是来自国内的某家AI,或者承认用了大量中文数据训练。

结果现在轮到别人从它们模型里学东西,就立刻喊“国家安全”“工业级攻击”。

蒸馏这种做法在AI行业早就不是什么秘密。

它本质上是用强模型的输出训练弱模型,实现能力快速迁移和成本大幅压缩。很多模型(不管是GPT还是Gemini、Claude,乃至 DeepSeek)都用过这种方式,在短时间内把推理、编码、多模态等能力追了上来。

对于行业而言,这是一种几乎公开的做法,通过这种方式,可以在相对较短的时间内,让一个较弱的模型快速学习到较强的模型的能力以实现进步。

可大美丽这边就很双标了。

我可以蒸馏你,这叫“技术进步”“推动人类文明发展”;

你们不能蒸馏我,因为事关“美丽安全”,你们会把技术用于军事,这是“非法的”。

这其中,以 Anthropic 2月那篇长文尤其典型,高调指责DeepSeek、月之暗面、MiniMax 蒸馏 Claude,喊得义正词严。

这就很幽默了。

只要你面对公众提供服务,那么技术扩散的速度永远比封锁快,这点在AI圈已经反复验证过了。

就以国外的模型为例,Meta Llama系列刚开源没多久就被Fork了无数个版本,Flux 一放出来就变成人人可用的图像生成底座,早期的 GPT-3 输出也被拿去训练了一堆小模型。

想彻底堵住?几乎不可能。

技术这东西,一旦到了公开可用的地步,就跟水一样,哪里有缝往哪里流。

更搞笑的是,它们堵了半天,最后估计还是堵不住。

话糙理不糙

随便整个中转、换个IP、或者想想别的办法,该蒸馏还是一样蒸馏。

就跟他们蒸馏我们的这边的模型一样(甚至门槛更低)。

最后,希望大美丽的AI公司能稍微放下一些偏见,别把所有精力都放在怎么防别人上。真正推动技术进步的,还是大家一起把模型做得更好、让更多人用得上,而不是天天盯着别人怎么学自己。

AI发展到现在,已经不是谁藏着掖着就能领先的时代了。

开放、竞争、互相学习,才是让整个行业真正往前走的正确方式。

更多游戏资讯请关注:电玩帮游戏资讯专区

电玩帮图文攻略 www.vgover.com