知名科技公司英偉達,市值突破了4萬億美元,超過微軟和蘋果,成爲全球市值最高的公司,在過去的30年時間裏,英偉達從一家開發圖形處理遊戲顯卡的小公司,一路成長爲全球AI巨擘!歡迎大家來到老黃髮家史的第12期,今天承接前11期內容,繼續聊老黃的創業史!

01 數據爲王

上文講到在與微軟合作破裂後,黃仁勳祕密啓動了CUDA項目,

這導致英偉達的遊戲顯卡業務擱置,成本激增,

面對AMD的激烈競爭和內部股東的嚴重分歧,

黃仁勳陷入了創業以來的最大危機,

然而,他堅信CUDA能爲科學家提供超級計算工具,

儘管當時並不清楚具體應用領域,

但他預感一定會有人利用英偉達GPU掀起一場技術革命。

斯坦福教授李飛飛受到了WordNet的啓發,

意識到數據是未來技術發展的新燃料,

構建了規模龐大的ImageNet數據集,

包含2200萬張圖像和2.2萬個類別,其規模是同類數據集的1000倍。

起初,學術界並不看好,

認爲突破需要算法而非數據。

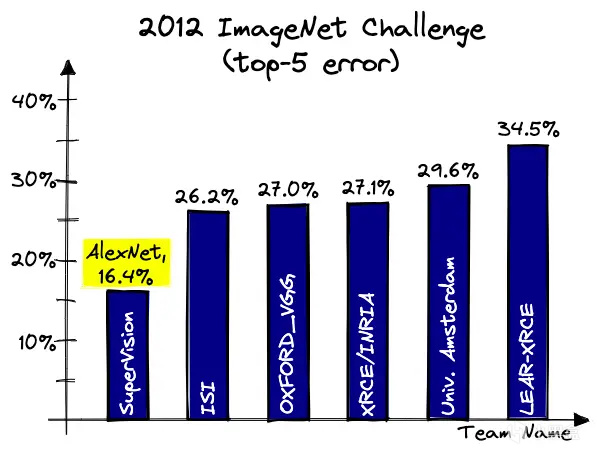

爲了驗證數據的價值,李飛飛於2010年推出了ImageNet挑戰賽,

前兩屆比賽的冠軍團隊日本NEC-UIUC和XRCE小組,

都主要依靠傳統的特徵工程方法取勝,錯誤率的下降速度緩慢,

如果繼續按照這個速度,比賽可能失去意義,

而特徵工程加SVM的組合似乎成爲不可撼動的權威,AI革命也無從談起,

就在ImageNet陷入僵局之際,

一個不起眼的團隊引起了李飛飛的注意,

這個團隊的領隊正是多倫多大學的傑弗裏·辛頓教授,

日後辛頓教授成爲了AI教父,還拿下圖靈機和諾獎兩項最高榮譽!

黃仁勳與深度學習三巨頭

02 神經網絡

但是在當時,辛頓在學術界被認爲是過時老掉牙技術的代表,

原因也很簡單,辛頓堅持研究的神經網絡已經是被證明是“死去”的領域,

神經網絡的雛形最早源於1943年,

到58年羅森布拉特教授提出了感知機(Perceptron)算法,

掀起了60年代的AI熱潮,甚至被《紐約時報》譽爲“胚胎計算機”,

不過到了70年代初期,馬文·明斯基和西摩爾·帕珀特

指出感知機無法解決異或(XOR)等非線性問題,

這個結論無疑也宣判了神經網絡的死刑,之後學術界轉而研究專家系統等AI方向。

到了80年代,神經網絡的寒冬短暫復甦,

霍普菲爾德提出了霍普菲爾德網絡,辛頓與特倫斯·塞諾夫斯基推出了玻爾茲曼機。

霍普菲爾德、辛頓 2024諾貝爾物理學獎

而在1986年,奠定英偉達日後取得成功的反向傳播BP算法興起,

辛頓還提出了多層感知機(MLP),能夠解決複雜的非線性問題,

然而,由於計算資源匱乏和對神經網絡營銷的厭倦,

這些研究並未得到廣泛認可。

到了1998年,Lecun開發了人類歷史上第一個卷積神經網絡(CNN)——LeNet-5,

LeNet-5引入了卷積層和池化層,特別適用於圖像數據,

但當時英偉達纔剛成立,

缺乏強大的顯卡來支持如此龐大的計算量,因此也未能引起廣泛關注。

進入21世紀,辛頓繼續探索更深層的神經網絡架構,

到了2006年,他首次創建了深度信念網絡(DBN),

標誌着深度學習概念的萌芽,

09年辛頓又提出了深度玻爾茲曼機(DBM),

展示出無監督預訓練和生成模型的潛力。

03 黑箱模型

經過了多輪的AI泡沫,無論是學術界還是華爾街都不看好神經網絡的發展,

在當時,訓練深層的神經網絡主要有四個問題,

第一是數據非常稀缺,獲取大量高質量的標註數據耗時且成本高昂;

第二是過擬合問題,數據有限時,複雜模型容易過擬合;

第三是梯度消失問題,傳統的激活函數會導致反向傳播中梯度指數級縮小;

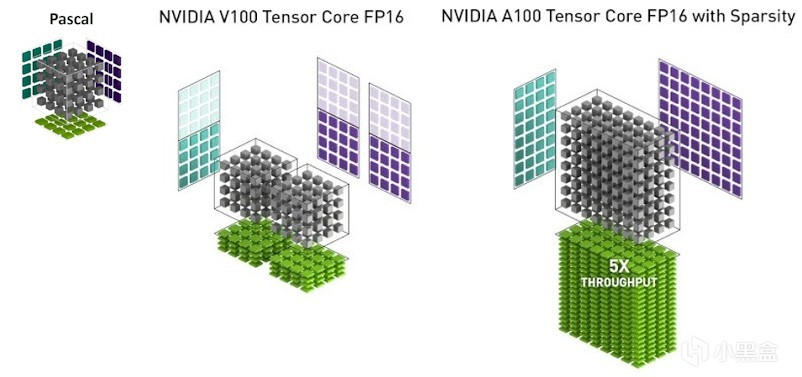

第四則是最困難的問題,傳統的CPU無法高效運算,而GPU也未廣泛用於通用計算。

多數學者仍認爲神經網絡是效果不佳的“黑箱模型”。

時間來到2011年,黃仁勳(算力)、李飛飛(數據)和辛頓(算法),

三條獨立的人物線奇蹟般地重合,

數據科學的這些問題也首次得到同時解決

此時距離神經網絡提出時間已經過去了近70年,

英偉達和老黃的命運也即將在2012年的ImageNet大賽上徹底得到改變,

2012年也成爲全球人工智能領域公認的AI元年。

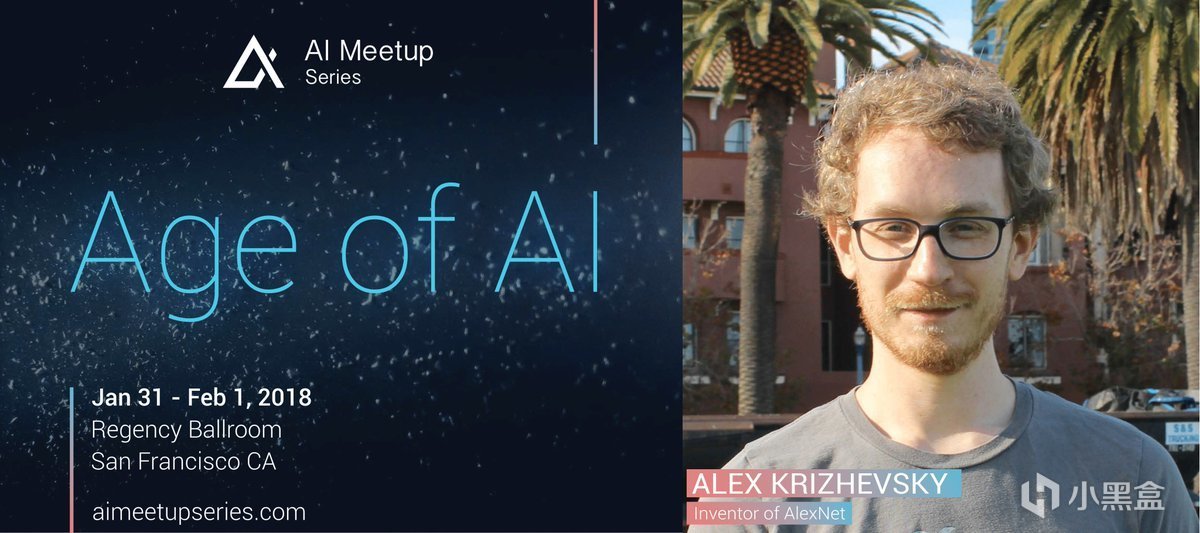

接下來上場的主人公就是辛頓的兩位學生,

他們即將成爲全球AI領域最著名的明星,

我們還是從兩位天才的故事開始講起。

04 俄裔天才

時間來到2000年初,辛頓仍然在多倫多大學研究神經網絡,

由於神經網絡遇冷,研究生普遍不願意給辛頓當研究生,

但是其中一位留學生Alex Krizhevsky對神經網絡很感興趣(下文簡稱爲Alex),

Alex本人是俄裔母語爲俄語,到了青年時期才移民加拿大,

不過Alex英語說得非常流利,但他很少在公衆面前說話,

有一天,Alex突然找到了辛頓,Alex說自己是多大軟件工程最優秀的研究生,

覺得學習有些無聊,希望加入辛頓團隊一起做研究,

辛頓覺得非常驚訝,因爲哪怕是在多大,

也有一羣對他的神經網絡表示冷漠甚至是敵意的學者,

這也是爲何辛頓沒有去斯坦福或者MIT這樣的計算機學術中心,

反而“流落”到多倫多,當時多大的CS專業遠遠比不上北美高校,

辛頓提醒Alex可以去斯坦福、MIT這些頂級強校,

沒有必要留在多倫多讀博,而且研究的還是最不受歡迎的神經網絡,

Alex卻並不在意這些,他的優點是數學極好總能一眼抓住問題的精髓,

辛頓回憶,Alex爲了讓項目更容易獲得學校的審批,

還特意將神經網絡工作描述爲“機器學習”或者“深度學習”,

以便可以從學校獲得資金,唯獨避免提及“人工智能”一詞。

在Alex堅持不懈的努力下,最終成功加入辛頓團隊,

還成爲辛頓最器重的博士生!

與Alex一起成爲辛頓學生的也是一位俄裔移民Ilya Sutskever(下文簡稱爲Ilya),

Ilya同樣也是數學天才,編程能力非常強,

他對神經網絡的信心甚至比辛頓還要強,

Ilya在2005年時就告訴辛頓,“神經網絡終有一日會超越人類的智能。”

(事實也是這樣進行的,Ilya日後成爲了OpenAI的四位創始人之一)

奧特曼和Ilya

05 ImageNet大賽

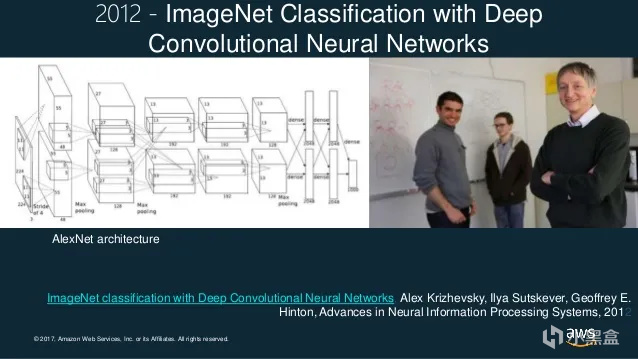

2012年,辛頓決定帶着自己的卷積神經網絡技術,

去挑戰第三屆ImageNet挑戰賽,

辛頓給兩位學生Ilya和Alex佈置了一項看起來非常難以完成的技術,

就是利用英偉達的GPU,去訓練計算機學會圖像識別,

前面幾期已經濃墨渲染了老黃堅持CUDA的故事,

辛頓也在自己的實驗室開始運用CUDA

(不過他自己的編程能力並沒有自己的學生強,

所以實際幹活的都是他的研究生和博士生)。

辛頓與英偉達結緣其實是在2008年,

當時辛頓就指派自己的研究生阿卜杜勒拉赫曼和喬治·達爾,

開發了一個基於英偉達服務器的語音識別模塊,

到了2009年初,這個語音識別模塊已經與最優秀的機器學習模型不相上下,

這個成果讓辛頓感到震驚,於是在同年的頂會NeuralPS上面,

辛頓向整個研究領域宣稱,

在並行計算處理器上運行神經網絡是AI的未來發展方向,

希望研究人員們立即放下手頭的工作,轉而採購英偉達的GPU,

不過辛頓的話並沒有引起學術界的普遍注意,

甚至也沒有引起老黃的注意。

06 老黃的冷落

在NeuralPS會後,辛頓親自給英偉達發了一封電子郵件,

非常自豪地說,“我剛剛告訴這次會議上的1000名機器學習專家,

他們都應該去買英偉達的顯卡。

所以,你們能送我一張免費的嗎?”

結果老黃和英偉達直接拒絕了。

比較搞笑的是,當時老黃在各個高校實驗室推銷CUDA,

想要和高校合作,但當辛頓討要一張英偉達GPU時,

老黃都不願意給,

因爲機器學習並不在柯克計劃領域之內,

CUDA小組有時甚至故意不回覆辛頓的電子郵件。

當時英偉達的AI課程也尤其讓人難繃,

因爲課堂裏還在說神經網絡無法解決簡單的邏輯函數問題,

但實際上BP算法早在幾十年前就突破了這一限制,

辛頓對老黃的冷落極度不滿,他心想既然無法和英偉達合作,

唯一的方法就是徹底打敗他們,搞一個大新聞出來,

辛頓仔細看了下自己的研究生和博士生團隊,

最終挑出了兩位他最得意的門生,

沒錯也就是上面介紹的Alex和Ilya,

接下來辛頓以多倫多大學的名義正式參加第三屆ImageNet挑戰賽。

07 李飛飛的危機

除了老黃的CUDA危機、辛頓的神經網絡危機,

李飛飛的ImageNet也遇到了大危機,

因爲從ImageNet創立之初,學者就嘲笑李飛飛是想大力出奇跡,

認爲ImageNet就是規模大,沒有太大的意義,

2010年吸引了35位參賽者之後,

2011年的參賽者卻銳減至15人,

到了2012年,更是隻剩下7位參賽者,

競賽是否能夠再延續一年都成了未知數,

如果ImageNet失敗,李飛飛能否可以保住自己在斯坦福的教職還是個問題,

更別提成爲AI教母、三院院士,

站在2012年,辛頓已經65歲即將退休,

老黃和李飛飛都處於危機之中,

拯救他們命運的鑰匙,就落在了Ilya和Alex身上。

08 祕密實驗

在辛頓看來,Ilya和Alex有很多共同點,

他們的數學和編程能力強,很多時候只需要辛頓開啓一個問題,

Ilya和Alex便會開始用俄語討論,然後直接給出正確的答案,

這次的ImageNet挑戰賽,辛頓希望兩人用卷積神經網絡構建一個圖像識別系統,

雖然是首次參賽,辛頓鼓勵兩人不僅要贏,

而且還要徹底擊敗所有其他的競爭對手,

這樣英偉達纔有可能注意到他們,

辛頓的建議可以先從簡單的圖像識別任務練手,

還讓Alex研究下英偉達的CUDA。

於是Alex開始了自己的祕密實驗,

只花了幾個月時間,Alex迅速成爲並行計算編程的專家,

比全世界任何人都能更有效地使用那些GPU板卡運行卷積神經網絡,

2012年初,Alex已成功改造了一個原本僅用於教學練習的經典學術圖像識別網絡,

而且還可以在CUDA上順暢運行,

更加令人震驚的是,GPU僅用30秒就完成了訓練

(而用英特爾的CPU則需要1個小時以上),

辛頓自己是理論派大師,他想過自己的卷積神經網絡肯定有前途,

但這樣的速度也讓他大喫一驚,而且他沒想到英偉達的GPU居然這麼厲害,

當時辛頓並沒有將這些實驗公開,因爲他想直接在ImageNet這個更大的舞臺證明自己!

Alex krizhevsky

09 GTX 580

ImageNet有2200萬張圖像和2.2萬個類別,數據集非常龐大,

爲了支持研究,Ilya和Alex兩位研究生開始籌集資金,

希望打造出一臺運行儘可能快的計算機。

然而兩人都是從俄到加拿大的留學生,並不是什麼富二代,

資金有限的情況下,Ilya和Alex省喫儉用買了兩塊遊戲顯卡——GTX 580。

GTX 580在2010年11月發佈,一張卡的單價約爲500美元,

580是英偉達的旗艦遊戲卡,支持DX11,

當時比較火的3A大作是顯卡殺手孤島危機系列,

多數人買580其實都是爲了打遊戲,

而Ilya和Alex則是爲了搞科研。

Ilya回憶,當時580送過來的時候,

外形看起來就像是電影《異形》中的道具一樣,

每張顯卡大約重1.36公斤,外殼是黑色的,裝飾是鮮綠色的,

還有一個圓形的通風口,裏面裝有強力風扇,

而在這個外殼之下,是一塊巨大的英偉達芯片,

它被嵌入黑色的電路板,周圍佈滿了散熱片,

這塊芯片由30億個晶體管構成,被排列在32個並行核裏,

這也正是Alex最需要的東西

(現在大家認爲H100、A100這類纔是AI計算卡,但在當年580就是AI的初代神卡)。

10 瘋狂科學家

回到家中,Alex一刻都沒有停歇,

將兩塊GTX 580交火插在自己的PC上,

然後在自己搭建的卷積神經網絡上持續運行了1周

(辛頓回憶自己也沒有給Alex付電費,後來是Alex父母承擔了這筆實驗費用),

此時此刻,老黃還完全矇在鼓裏,

他完全沒想到,Alex成爲了全世界第一個喫螃蟹的人,

未來在GTX 580基礎上誕生的英偉達計算卡,

甚至會成爲各個國家核戰略級別的算力資源!

而改變這一切的Alex,甚至還是自己省錢買顯卡,

老黃給Alex磕一個都不過分!

爲了參加ImageNet比賽,Alex搭建了一個約有65萬個獨立神經元的網絡,

要訓練如此龐大的模型,數據需求量極大,

在訓練的開始階段,神經元是以隨機方式連接的,

但隨着訓練深入,它們會重新組織成一個錯綜複雜且精美的結構,

Alex的神經網絡會接收到隨機選取的數據集圖像,

並需要從李飛飛提供的數千個類別中爲其選定一個標籤。

圖像內容可能是一條黃貂魚,也可能是一隻蘇格蘭梗犬,或者是一輛高爾夫球車,

不論何種內容,神經網絡都是首次接觸,

因此在選定標籤時,它只能進行猜測,

所以第一次猜測往往都是錯誤的,

然而在這次錯誤的猜測中,網絡也獲取了一些關於圖像內容的微弱線索,

比如至少能確定圖像並非黃貂魚,

然後神經網絡會藉助辛頓提出的反向傳播方法,

來調整神經元間的連接處理這些信息,

真正麻煩的也就是BP這一步,因爲需要涉及到大規模的“矩陣乘法”。

11 Matrix

過去,許多訓練神經網絡的嘗試,其實都卡在BP做矩陣計算的這一步,

而Alex擁有比其他科學家更厲害的神器——GTX 580,

而且他還專門寫了適配矩陣計算的CUDA代碼,

可以用GTX 580的並行架構進行高效運算,

一旦數學運算完成,Alex的網絡便會接收到第二張圖像,

緊接着是第三張、第四張,直至成千上萬張,甚至數百萬張。

爲了“觀看”這些圖像,神經網絡實際上並不處理光線,

相反它接收的是一串數字,這些數字代表着特定像素陣列的排列與顏色,

隨後,神經網絡會更新代表不同解釋層突觸權重的數字網格,

在訓練剛開始的幾分鐘內,Alex就取得了重大收穫,

因爲他的神經網絡意外地成功標記了首張圖像——花盆,

這次成功觸發了大量的矩陣乘法運算,BP會不斷向神經網絡傳達,

是什麼特徵讓“花盆”區別於“黑猩猩”“檯球桌”或“自卸卡車”。

就這樣,這個過程日復一日地重複了數百萬次,

Alex的臥室彷彿變成了一個高速進化的世界,

每天晚上,Alex都會被顯卡風扇噪音吵得無法睡覺,

但是他發現圖像識別的準確率從0%開始緩慢攀升,

逐漸達到1%、10%、40%、60%,

這說明他們的實驗和假設成功了,神經網絡的時代已經到來!

12 一鳴驚人

2012年的ImageNet大賽,Alex帶着自己全新的卷積神經網絡參賽,

過去傳統的機器學習方法比如SVM、手工特徵提取的Top-5錯誤率高達25%以上,

而辛頓團隊的Top-5錯誤率15.3%,

較第二名(26.2%)提升近11個百分點,創歷史最大幅度提升,

辛頓和兩位學生Alex、Ilya從此也一鳴驚人,

成爲全世界最炙手可熱的AI明星,

不誇張地說,如今的AI時代,正是他們三人開啓的,

背後李飛飛憑藉ImageNet大賽奠定在學術界的地位,

而世俗意義上賺得最多的是悶聲發大財的老黃,

曾經英偉達團隊對辛頓的神經網絡愛答不理,

還要Alex和Ilya省錢去買顯卡,

如今英偉達卻因爲他們的成績名聲大噪,

一躍成爲全球第一大公司,

背後有太多太多的偶然,

而當所有偶然都聚集在一起時,似乎也成爲了必然。

Alex將他的神經網絡命名爲“SuperVision”,

日後大家將這個神經網絡用Alex的名字命名爲AlexNet,

2012年也成爲AI元年,GTX 580這張顯卡也成爲AI博物館裏程碑級別的標誌!

2013年,就在AlexNet發佈一年以後,

辛頓很快就遇到了新的挑戰,老黃也遇到了新對手,

AlexNet雖然出來了,但是從學術競賽到如今的大模型開花,

還有很長很長的一段路要走,

辛頓、Alex和Ilya的故事纔剛剛開始,

老黃的命運也從此被綁上AI的戰車,

欲知後事如何,且聽下回分解!

遊戲&AI系列:

老黃髮家史——英偉達市值突破4萬億,老黃的傳奇人生!

老黃髮家史——傳奇AMD工程師,老黃人生的第一份工作!

老黃髮家史——世嘉主機拯救英偉達,老黃曾差點破產!

老黃髮家史——FPS天才成就英偉達,N卡的誕生!

老黃髮家史——N卡大戰A卡,上古芯片巨頭ATI!

老黃髮家史——英偉達創造顯卡,PC遊戲的崛起!

老黃髮家史——極客玩家的一次靈感,啓發英偉達進軍AI!

老黃髮家史——讓玩家爲 AI 買單,老黃成功的祕訣!

老黃髮家史——CUDA崛起,英偉達AI的護城河!

老黃髮家史——華人AI教母李飛飛,老黃髮家的貴人!

老黃髮家史——神經網絡,AI革命的起點!

AI——是遊戲NPC的未來嗎?

巫師三——AI如何幫助老遊戲畫質重獲新生

你的遊戲存檔——正在改寫人類藥物研發史

無主之地3——臭打遊戲,竟能解決人類大腸便祕煩惱

一句話造GTA——全球首款A遊戲引擎Mirage上線

AI女裝換臉——FaceAPP應用和原理

AI捏臉技術——你想在遊戲中捏誰的臉?

Epic虛幻引擎——“元人類生成器”遊戲開發(附教程)

腦機接口——特斯拉、米哈遊的“魔幻未來技術”

白話科普——Bit到底是如何誕生的?

永劫無間——肌肉金輪,AI如何幫助玩家捏臉?

Adobe之父——發明PDF格式,助喬布斯封神

FPS遊戲之父——誰是最偉大的遊戲程序員?

《巫師3》MOD——製作教程,從零開始!

#gd的ai&遊戲雜談#

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com

![好想回到公司沒錢的時候[cube_doge]](https://imgheybox1.max-c.com/bbs/2025/11/21/56ce39f9ee8ebbfa0618d755eb4b17a6.jpeg?imageMogr2/auto-orient/ignore-error/1/format/jpg/thumbnail/398x679%3E)