知名科技公司英偉達,市值突破了4萬億美元,超過微軟和蘋果,成爲全球市值最高的公司,在過去的30年時間裏,英偉達從一家開發圖形處理遊戲顯卡的小公司,一路成長爲全球AI巨擘!歡迎大家來到老黃髮家史的第11期,今天承接前十期內容,繼續聊老黃的創業史!

01 技術偶然

上文講到老黃的至暗時刻,

英偉達與微軟合作破裂後,老黃轉而祕密啓動CUDA項目,

但是導致遊戲顯卡業務擱置、成本激增,

外部面臨AMD的激烈競爭,內部股東分歧嚴重,

黃仁勳陷入創業以來最嚴峻的危機。

但是老黃依然自比爲17世紀發明望遠鏡的荷蘭工匠,

堅持CUDA戰略,希望爲科學家提供超級計算工具,

彼時,老黃心中其實並不知道未來會出現什麼技術,

坦言自己缺乏馬斯克那種目標明確的願景,

自己只是感覺CUDA可以幫助到科學家,

但是具體在哪個領域,如何取得突破,

這些老黃都是一頭霧水。

但他仍然堅信,在地球上的某個角落,

一定會有研究者使用英偉達GPU掀起一場技術革命!

首先登上歷史舞臺的是斯坦福教授李飛飛,

她畢業於成都七中,後前往Caltech深造,

受語言數據集WordNet啓發,

她意識到數據是未來技術發展的新燃料,

於是構建了涵蓋2200萬張圖像、2.2萬類別的ImageNet數據集,

規模達同類1000倍,起初學術界並不看好李飛飛,

認爲這只不過是規模更大的數據集,

要想取得突破還是需要算法。

02 數據還是算法?

於是,李飛飛在2010年推出了ImageNet挑戰賽,

首屆冠軍由日本NEC(林元慶領隊)和UIUC(黃煦濤領隊),

以傳統特徵工程方法獲得,Top-5錯誤率28.2%,

華人團隊雖奪冠,但未突破算法瓶頸,

2011年,第二屆ImageNet挑戰賽,

獲得冠軍的是XRCE小組,

仍然是靠特徵提取和降低特徵維度這些特徵工程取勝,

Top-5錯誤率25.7%,較2010年提升2.5個百分點,

如果未來每年都是這個進步速度,

那麼李飛飛的ImageNet挑戰賽也會成爲無意義的刷榜,

特徵工程+SVM的組合就是不可挑戰的權威,

未來的AI革命自然也就無從談起,

英偉達也無法達到今天4萬億美元的盛況。

03 AI教父

在2011年參賽人員中,還有一個非常不起眼的團隊,

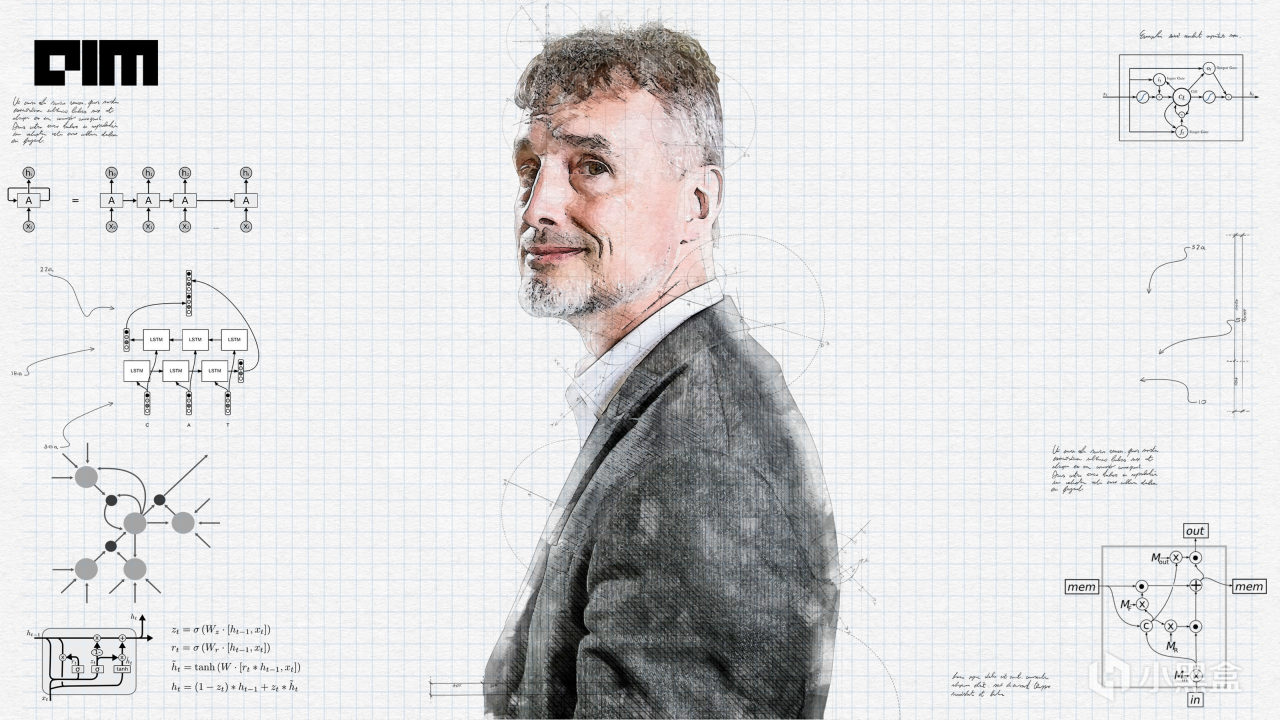

團隊領隊爲多倫多大學的Hinton辛頓教授,

辛頓對李飛飛的ImageNet挑戰賽很感興趣,

他開始思考自己一直信奉的算法,

是否可以在ImageNet比賽上取得好成績,

但學術界幾乎所有人都對此嗤之以鼻,

因爲辛頓在學界早就是過時老掉牙技術的代表了,

不過誰也沒有想到,這位老頭居然日後成爲AI教父,

並且榮獲圖靈獎和諾貝爾獎雙獎!

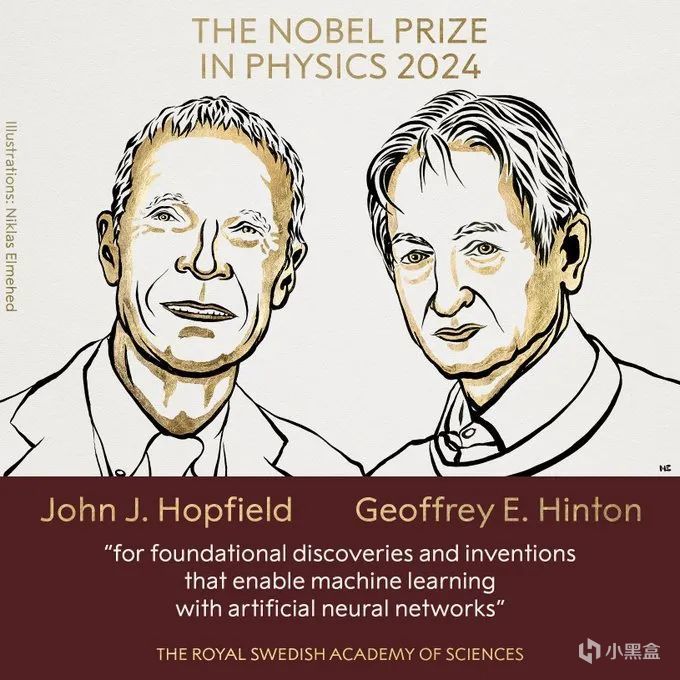

霍普菲爾德、辛頓 2024諾貝爾物理學獎

說來辛頓勉強也算是中國人的半個老朋友,

辛頓的高曾祖父是布爾代數的創始人喬治·布爾,

參與曼哈頓計劃的核物理學家瓊·辛頓是傑弗裏的堂姑,

瓊·辛頓師從費米,與楊振寧爲同學,

而瓊·辛頓的中文名大家更熟悉,名叫寒春,

寒春1948年隨未婚夫陽早移居中國,投身農業機械化建設,

成爲北京首位獲得中國綠卡的外國人!

話扯遠了,在2011年辛頓教授已經在神經網絡上鑽研了三十年,

但是一直無法獲得學術界的廣泛認可,

因爲在當時,神經網絡已經是被判“死刑”的技術。

黃仁勳與深度學習三巨頭

04 老掉牙的技術

神經網絡其實是起源於生物學,

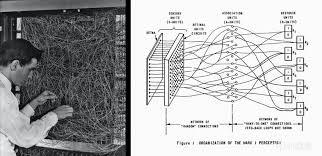

1943年,神經生理學家沃倫·麥卡洛克和數學家沃爾特·皮茨

創建了神經網絡的計算模型,他們利用電路模擬大腦神經元,

不過早期的模型都比較抽象,模型缺乏學習機制,

而且依賴同步時鐘信號,與生物神經元的異步特性不符。

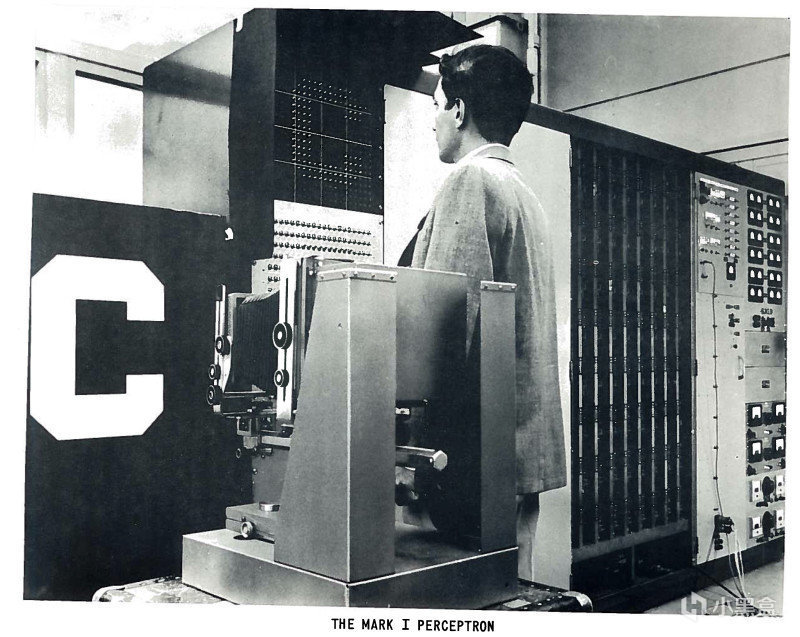

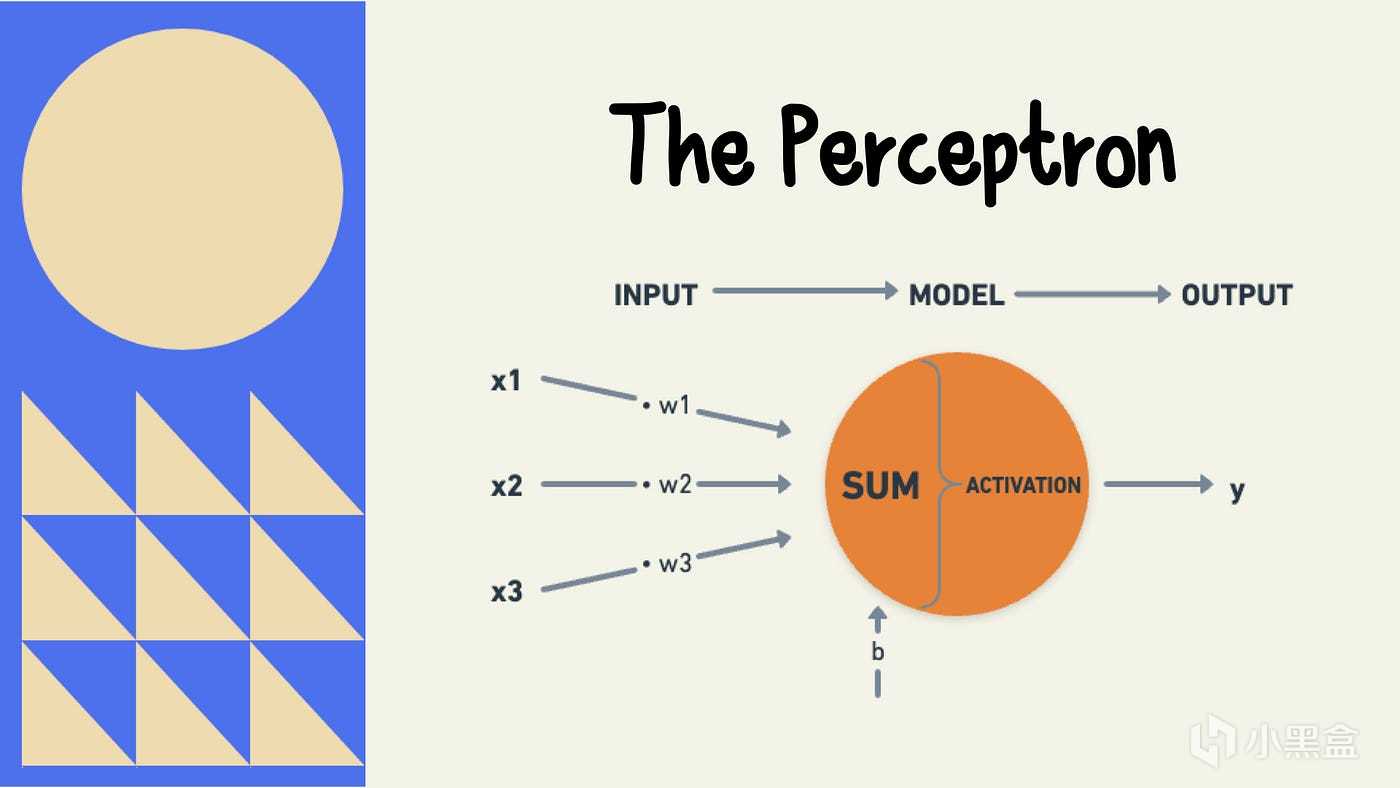

到了1958年,第一個採用神經網絡結構的算法感知機(Perceptron)出現,

弗蘭克·羅森布拉特教授從神經元工作方式得到啓發,

搭建了單層神經網絡感知機,

還成功在Mark I Perceptron計算機上實現,

1958年《紐約時報》頭版宣稱,

“感知機是胚胎計算機,未來可走路、說話、觀察、寫作!”

羅森布拉特的感知機直接掀起了60年代的AI熱潮,

美國海軍投入百萬美元資助,引發學界與資本追捧。

05 AI寒冬

70年代初期,馬文·明斯基和西摩爾·帕珀特對感知機進行了數學分析,

認爲感知機無法解決異或(XOR)操作等非線性可分問題,

這一分析導致了研究的顯著停滯,通常被稱爲“AI寒冬”。

單層感知機本質上是一個線性分類器,

決策邊界只能是一條直線(或高維超平面),

而XOR問題在二維空間中無法被一條直線完全分割,

明斯基是MIT人工智能實驗室聯合創始人,

他把觀點發布之後,幾乎否定了感知機的所有實用價值,

學界基本上放棄神經網絡,

轉而探索符號主義AI,比如專家系統,

但是符號主義依賴人工規則,難以處理真實世界的模糊性,

進一步加劇了AI應用的瓶頸。

06 學新聞學的

所以在上世紀70年代後期,AI方面的研究幾乎處於停滯狀態,

當時的美國媒體也基本上是學新聞學的,

每次AI領域有一點突破,媒體立刻放大資本湧入,

人工智能領域多次經歷這種炒作週期,

隨後就是失望和批評,

一個技術往往幾年甚至幾十年後才重新獲得興趣。

明斯基和帕珀特的批判觸發了AI寒冬,

但是並不代表神經網絡和感知機毫無意義,

恰恰相反,神經網絡和感知機正是這輪AI革命最早的起點,

只是當時大家的視野仍有侷限性,

看不到神經網絡未來的發展,

再加上公衆和媒體往往功利性很強,

很多好技術最終也會被埋沒,

好在這個世界上從來不缺像辛頓教授這樣較真的人。

07 反向傳播-1986

在上世紀80年代,AI寒冬短暫迎來複蘇,

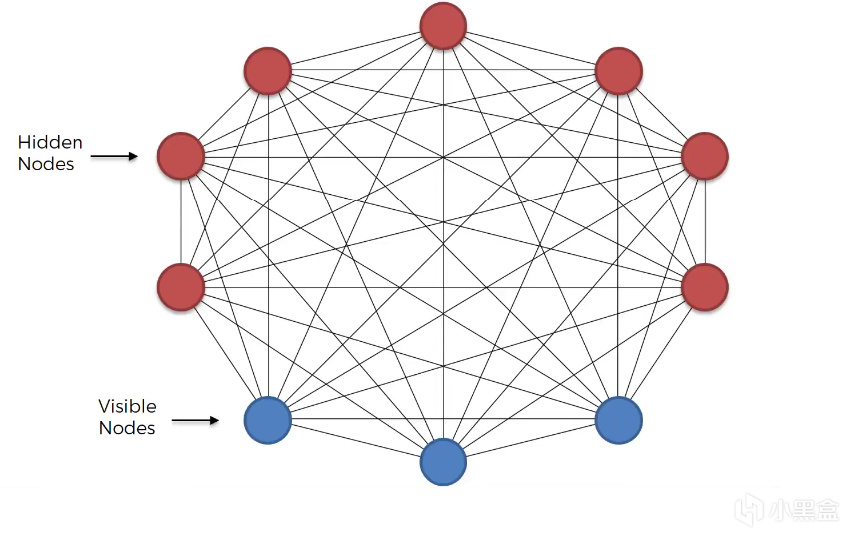

首先是霍普菲爾德在82年推出了霍普菲爾德網絡(Hopfield Network)

(注:霍普菲爾德與辛頓同獲諾獎),

而辛頓教授與特倫斯·塞諾夫斯基,

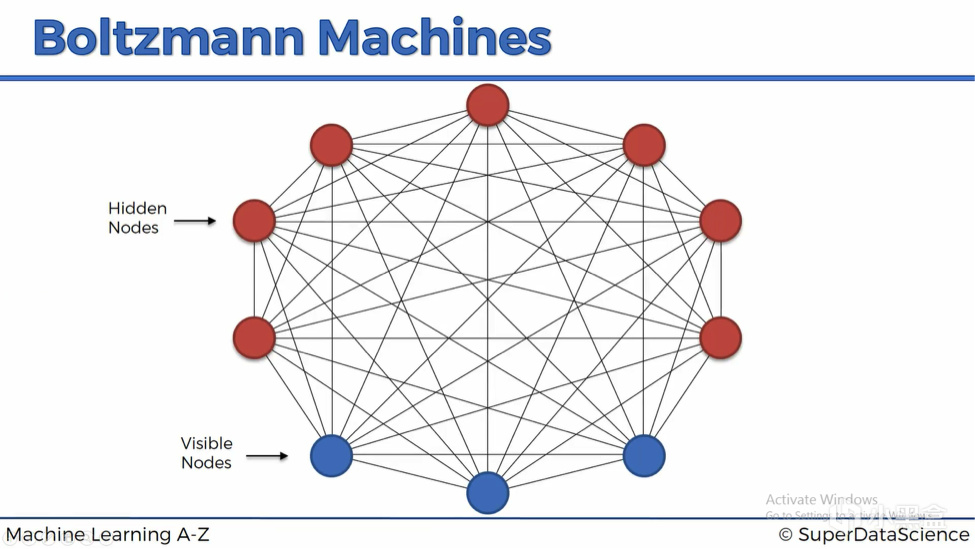

在85年推出了大名鼎鼎的玻爾茲曼機(Boltzmann Machine)。

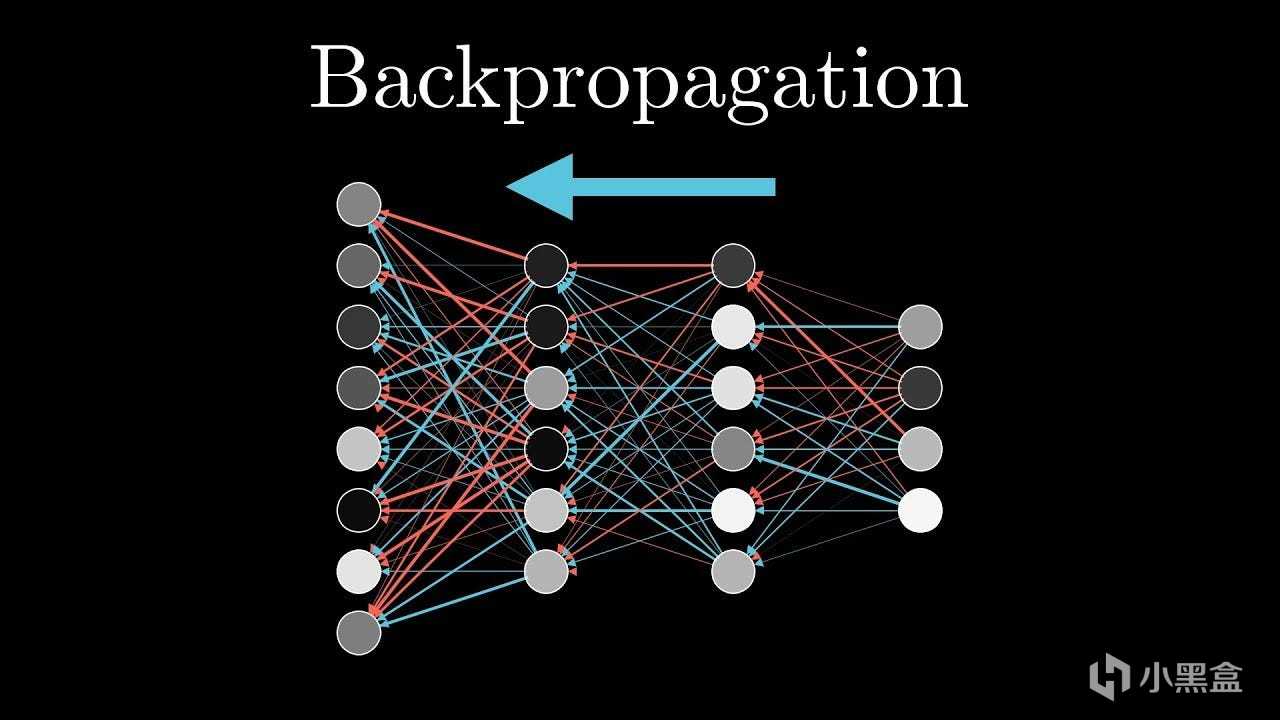

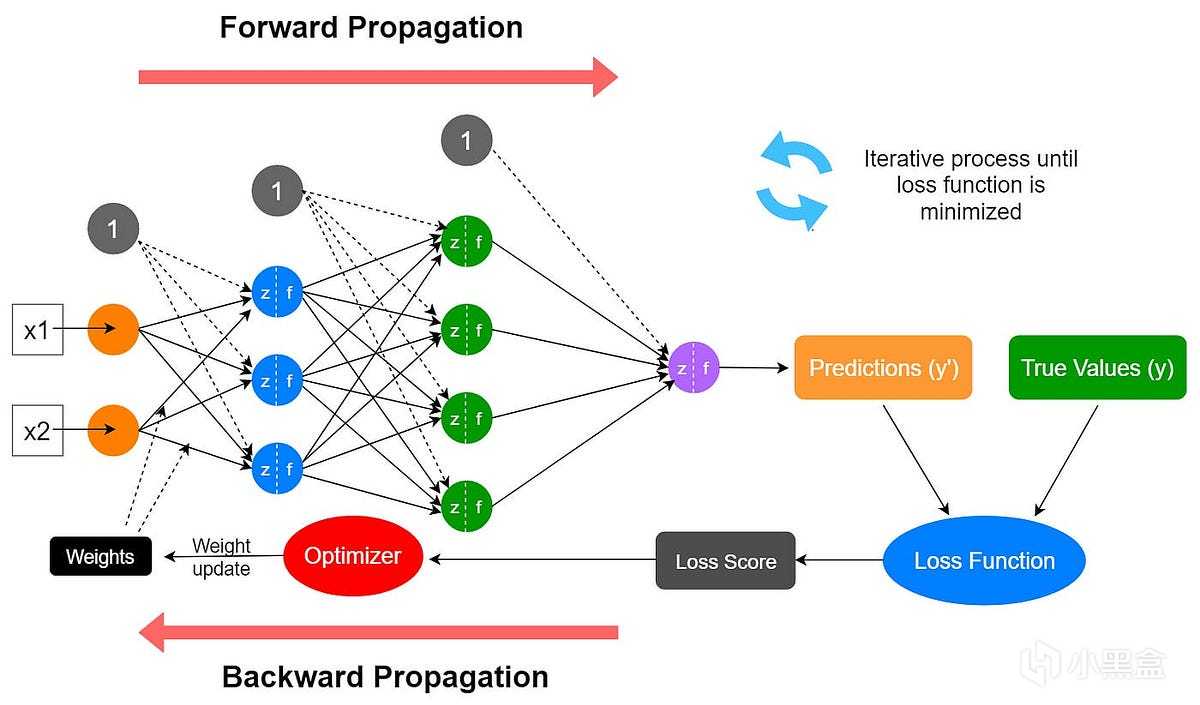

次年,辛頓、魯梅爾哈特和威廉姆斯推廣了反向傳播算法,

提出了多層感知機(MLP),

與之前的感知機不同,多層感知機使用非線性(可微分)激活函數,

能夠解決複雜的非線性問題,還能學習內部表示。

魯梅爾哈特還引入了循環神經網絡(RNN)的概念,

希望提高網絡處理序列數據的記憶能力,

MLP和RNN的提出,

直接成爲了日後計算機視覺CV和自然語言處理NLP騰飛的基石,

也直接造就瞭如今的AI大模型時代,

不過在80年代,由於大家已經厭倦了神經網絡的營銷,

再加上反向傳播BP需要大量的算力資源,

英偉達CUDA顯卡還沒有出來,沒有硬件可以支持這樣的算法,

所以多數學者仍然對辛頓的研究比較冷淡。

08 卷積神經網絡-1998

等到神經網絡下一次迎來躍遷,還要等到十年後,

1997年,Schmidthuber對RNN進行改進,

引入了長短期記憶網絡(LSTM),

通過部分解決梯度消失問題提高了記憶能力,

成爲自然語言處理的里程碑;

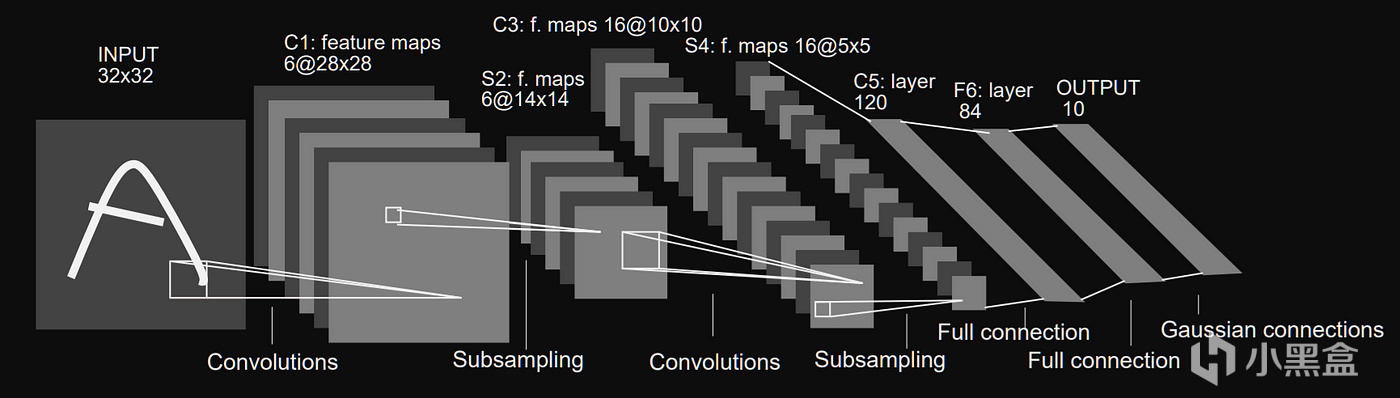

第二年,Yann LeCun開發了LeNet-5,

(Hinton、LeCun和Bengio日後一起獲得2018圖靈獎)

這是人類歷史上第一個卷積神經網絡(CNN),

與感知機神經網絡相比,Lecun引入了卷積層的概念,

卷積(Convolution)本身其實是很基礎的數學運算,

LeNet-5由7層神經網絡組成,

分別是輸入層+2個卷積層+2個池化層+3個全連接層,

用通俗語言來說,卷積層類似於偵探找線索,進行特徵提取,

池化層類似總結報告,降維保留關鍵信息,

而全連接層是最終決策,整合所有信息做判斷,

LeNet-5尤其適用於圖像數據,

不過放在1998年,那時老黃英偉達纔剛剛成立不久,

如果卷積神經網絡層數增大,

仍然缺乏顯卡來計算如此龐大的參數量,

所以遺憾的是,98年的卷積神經網絡仍然沒有引起大範圍的注意。

09 深度學習-2000年代

進入21世紀,在80年代和90年代的理論基礎上,

辛頓仍然沒有放棄神經網絡,

繼續探索更深層的架構,

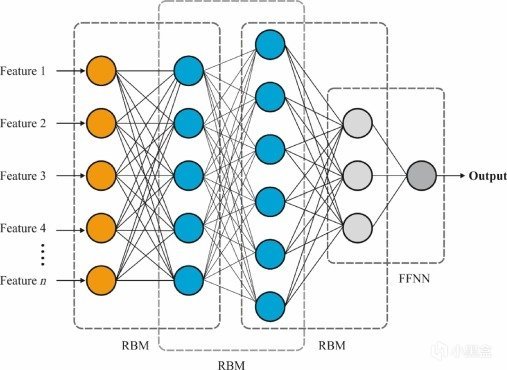

2006年,辛頓首次創建了深度信念/置信網絡(Deep Belief Network,DBN),

這是一種通過堆疊受限玻爾茲曼機形成的生成模型,

深度學習的概念也是從這一時期開始萌芽的,

但實際上人工智能、深度學習、大模型這些範圍很大的詞,

都屬於營銷話術,真正的研究都有非常具體的方向,

比如反向傳播這類研究屬於優化方法,

DBN是早期深度學習的算法實體,

更具體來說是爲了解決無監督特徵學習問題,

後來常被泛化爲“深度學習革命”的象徵符號,

而且深度學習本身是個很大的概念,

單獨拿出來討論意義不大,大模型也是同理,

接下來的英偉達老黃髮家史系列,

我也會給大家介紹各個領域的技術沿革發展。

DBN

10 2011年-AI浪潮前夜

辛頓的DBN首次證明深層網絡也可以高效訓練,

2009年,辛頓再提出深度玻爾茲曼機(Deep Boltzmann Machine,DBM),

DBM和DBN類似,但DBM是完全無向圖,

所有相鄰層均爲雙向對稱連接,訓練複雜度高,

這類生成模型也展示出無監督預訓練的潛力。

不過放在當時,訓練深度網絡需要巨大的計算能力,

而傳統的CPU根本無法高效做運算,

而GPU也尚未被廣泛用於通用計算,

再加上這類“深度學習模型”需要大量高質量的訓練數據,

當時想要獲取標註足夠的數據非常耗時而且成本極高,

所以在數據有限的情況下,複雜模型容易過擬合,

而使用傳統Sigmoid或Tanh激活函數的深度網絡中,

還容易出現梯度消失問題,

反向傳播過程中梯度會指數級縮小,使得模型難以學習。

DBM

種種問題疊加之下,

多數學者都認爲神經網絡是效果不太好的黑箱模型,

決策過程難以理解,還需要大量的數據和計算資源,

想要取得突破幾乎是不可能的事情,

但是在2011年,

屬於黃仁勳、李飛飛和辛頓三條完全獨立的人物線,

居然奇蹟般地重合了,數據科學的三大難題——

算力(黃仁勳)、數據(李飛飛)和算法(辛頓),

也在人類歷史上首次同時解決,

那麼究竟是誰成就了這一切,

人類歷史又是如何被改變的呢,

欲知後事如何,且聽下回分解!

AlexNet團隊

遊戲&AI系列:

老黃髮家史——英偉達市值突破4萬億,老黃的傳奇人生!

老黃髮家史——傳奇AMD工程師,老黃人生的第一份工作!

老黃髮家史——世嘉主機拯救英偉達,老黃曾差點破產!

老黃髮家史——FPS天才成就英偉達,N卡的誕生!

老黃髮家史——N卡大戰A卡,上古芯片巨頭ATI!

老黃髮家史——英偉達創造顯卡,PC遊戲的崛起!

老黃髮家史——極客玩家的一次靈感,啓發英偉達進軍AI!

老黃髮家史——讓玩家爲 AI 買單,老黃成功的祕訣!

老黃髮家史——CUDA崛起,英偉達AI的護城河!

老黃髮家史——華人AI教母李飛飛,老黃髮家的貴人!

AI——是遊戲NPC的未來嗎?

巫師三——AI如何幫助老遊戲畫質重獲新生

你的遊戲存檔——正在改寫人類藥物研發史

無主之地3——臭打遊戲,竟能解決人類大腸便祕煩惱

一句話造GTA——全球首款A遊戲引擎Mirage上線

AI女裝換臉——FaceAPP應用和原理

AI捏臉技術——你想在遊戲中捏誰的臉?

Epic虛幻引擎——“元人類生成器”遊戲開發(附教程)

腦機接口——特斯拉、米哈遊的“魔幻未來技術”

白話科普——Bit到底是如何誕生的?

永劫無間——肌肉金輪,AI如何幫助玩家捏臉?

Adobe之父——發明PDF格式,助喬布斯封神

FPS遊戲之父——誰是最偉大的遊戲程序員?

《巫師3》MOD——製作教程,從零開始!

#gd的ai&遊戲雜談#

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com

![好想回到公司沒錢的時候[cube_doge]](https://imgheybox1.max-c.com/bbs/2025/11/21/56ce39f9ee8ebbfa0618d755eb4b17a6.jpeg?imageMogr2/auto-orient/ignore-error/1/format/jpg/thumbnail/398x679%3E)