文章開篇先說明本次評測的幾項前提說明。

第一,本次榜單隻收錄專業級與數據中心級顯卡,消費級遊戲卡不參與排名。RTX 5090性能確實強悍,32GB顯存運行7B級模型體驗也很好,但它和專業算力卡不屬於同一條產品線。通道規格、散熱設計、ECC糾錯、多卡互聯能力,兩者完全不在一個層級。

第二,排名不參考常規跑分。AI算力負載和遊戲渲染完全是兩回事,3DMark這類跑分沒有參考價值。主要看三項核心指標:顯存容量,決定能承載多大規模的大模型;顯存帶寬,決定每秒輸出Token的效率;FP8/FP16算力,決定推理與訓練吞吐能力。綜合三項性能,再結合定價性價比進行排序。

第三,所有評測數據均來源於公開渠道。包含今年4月最新的MLPerf Inference v6.0基準測試、各廠商官方白皮書,以及CloudRift、Spheron、Nebius等第三方機構實測數據。

第 10 名:NVIDIA L40S

- 架構:Ada Lovelace(4nm)

- 顯存:48GB GDDR6,ECC

- 功耗:350W,被動散熱

L40S 說白了就是 RTX 4090 的數據中心版——同一個 AD102 核心,顯存翻倍到48GB,加了 ECC,做成被動散熱塞進服務器機箱。

48GB。這兩年看確實有點不夠用了,尤其現在 70B 模型滿地跑。但 L40S 的核心優勢從來不是容量——是便宜。直購五六萬,已經是專業卡的門檻價了。

國內雲廠商的 GPU 實例裏,L40S 差不多是最便宜的。阿里雲競價,一小時兩塊多,7B-13B 推理能把成本壓到地板:

- Qwen 3.5-9B FP16 佔 18GB,剩下 30GB全給 KV Cache,batch size 隨便開

- Qwen 3.6-35B-A3B Q4——這模型的 MoE設計太聰明瞭,35B 總量激活才 3B,又快又省顯存,跟 L40S 簡直是天作之合

但別對它有非分之想。70B 以上就算了,Q4量化也就二十來 tok/s,體驗像在泥裏走路。而且沒有 NVLink,多卡堆算力走 PCIe,那點帶寬根本不夠塞牙縫。

所以我把它放第十。不是性能怪獸,就是張踏踏實實幹活的卡。你是個初創公司搭 7B-13B推理 API?閉眼選它。

第 9 名:NVIDIA A100 80GB

- 架構:Ampere(7nm)

- 顯存:80GB HBM2e,帶寬1935GB/s

- 算力:

- FP64:9.7 TFLOPS

- FP32:19.5 TFLOPS

- TF32:156 TFLOPS

- BF16/FP16:312 TFLOPS

- INT8:624 TOPS

- 功耗:300W(PCIe)

A100,2020 年發佈,五年多了。Ampere架構,擱現在別說先進了,連 FP8 都不支持。

但就是這麼一張“老古董”,雲上還在大量服役。而且我敢說,未來兩年大概率退不了役。

爲什麼?因爲該踩的坑全踩完了。CUDA適配?完美。PyTorch支持?完美。多卡NVLink 600GB/s?穩得一批。MIG切七個獨立實例跑多租戶?一個錯都不帶出的。這種“你只管用、別的不用操心”的確定性,在生產環境裏比什麼跑分都值錢。

價格也在持續跌。直購七八萬,國內雲廠商A100競價已經跌到兩三塊一小時了。三年前你敢想?實測:

- Qwen 3.5-122B-A10B Q4 單卡能跑,25-35 tok/s,一個人夠用了

- Qwen 3.5-27B FP16 單卡流暢跑,60+ tok/s

- 兩張 A100 拿 NVLink 一接,Qwen 3.5-122B-A10B FP8 完全能打

說白了吧,你要是租雲 GPU 跑推理的,A100大概率還是你實際用到最多的那張卡。不是它最好,是它最穩、最便宜、最不用動腦子。

第 8 名:NVIDIA RTX PRO 6000 Blackwell

- 架構:Blackwell(GB202,4NP)

- CUDA核心:24,064;Tensor核心:752;RT核心:188

- 顯存:96GB GDDR7(ECC),512bit,1.8TB/s

- 算力:FP4 18 PFLOPS;FP8 4.5 PFLOPS;INT8 4,000 TOPS

這張卡定位很特殊。不屬於數據中心 SXM 線,也不屬於消費 GeForce 線,卡在正中間的工作站專業卡。

96GB GDDR7 帶 ECC。注意這個數字:96GB。消費級 5090 才 32GB,它直接三倍。而且還是 Blackwell 架構,第五代 Tensor Core,原生 FP4 支持——跟 B200 一樣的待遇。直購五六萬,工作站卡的天花板。

最騷的是它能幹什麼:單卡剛好能跑 Qwen 3.5-122B-A10B Q4。122B 的 MoE,一張卡搞定。第三方實測跑 Qwen 3.6-35B-A3B AWQ,一張卡 8400 tok/s——差不多是四張 RTX 4090 摞在一起的水平,功耗卻只有人家的一半。

雲上競價兩三塊一小時,比 H100 便宜一半還多。個人開發者或者小團隊,這可能是目前單卡跑大模型性價比最高的方案。

但有個硬傷我很糾結:沒有 NVLink。多卡走 PCIe 5.0,張量並行效率跟 NVLink 差了一個數量級。所以你只能當單卡用,堆卡就別想了。

不過說實話,96GB 單卡對絕大多數個人和小團隊已經夠了。跑不動 70B 的,7B-32B 那不是閉眼跑?

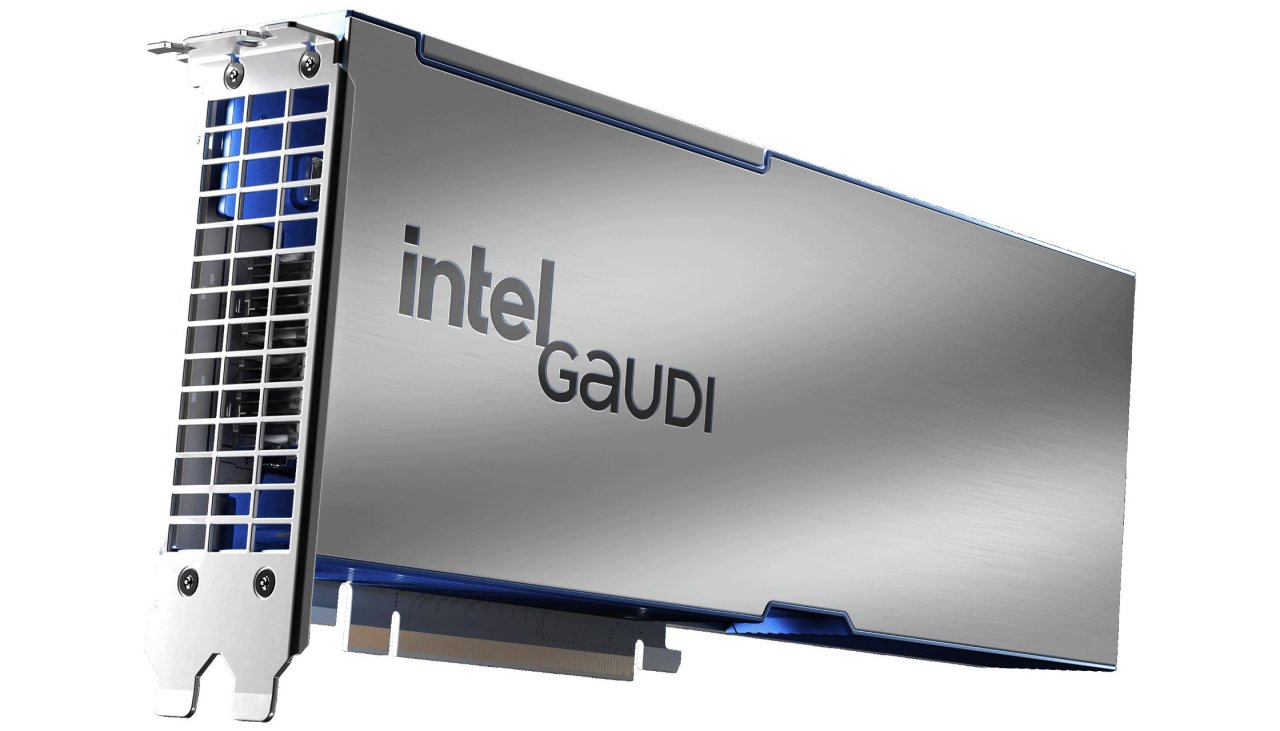

第 7 名:Intel Gaudi 3

- 工藝:臺積電 5nm

- 顯存:128GB HBM2e

- 顯存帶寬:3.7 TB/s

- FP8 算力:1835 TFLOPS

Gaudi 3 是這十張卡里讓我心情最複雜的一張。

硬件底子真不差。臺積電 5nm,128GB HBM2e,3.7 TB/s 帶寬,1835 TFLOPS FP8。最特別的是它集成了 24 個 200Gb 以太網口——別人多卡互聯得額外買 NVLink Switch 或者 InfiniBand,Gaudi 3 直接用網線連。這架構思路其實很聰明。

直購十萬左右,H100 的一半。實測也拿得出手:8 卡跑 70B FP8,21138 tok/s,差不多 H100 的九成到九成五。每百萬 token 推理成本是 H100 的六折。

那問題在哪?不在芯片。在 Intel。

2025 年 Gaudi 3 出貨目標從 35 萬顆砍到 20 萬顆,全年營收預估 5 億美元。隔壁 NVIDIA AI 業務 400 億。更讓人心裏沒底的是 Intel 管理層公開表態:短期內不會在高端 AI 訓練領域跟 NVIDIA 正面競爭。你品品這話的意思。

軟件棧也頭疼。SynapseAI 到現在都沒法跟 CUDA 比。Linux 內核社區甚至拒過 Gaudi 的驅動。

所以 Gaudi 3 適合什麼人?你對 Intel 生態有信心、推理場景剛好卡在它的甜區(70B 以下 FP8)、同時你敢賭它的路線圖不會斷。三個條件全滿足,它可能是你 ROI 最高的選擇。缺一個?老老實實 NVIDIA。

第 6 名:華爲昇騰 910C

- 架構:達芬奇3.0,雙Die合封(2×910B)

- 工藝:中芯國際7nm(N+2)

- 顯存:128GB HBM2e,帶寬3.2TB/s

- 算力:FP16/BF16 800 TFLOPS;INT8 1600 TOPS

- 功耗:≤400W

異騰 910C 可能是這次排名裏爭議最大的一張。放第六,有人覺得高了,有人覺得低了。

單看芯片參數,910C 打不過 H100。BF16 約800 TFLOPS,大概 H100 的六到八成。中芯國際7nm級工藝跟臺積電4nm有代差,良率大概四成,英偉達七成往上。純單卡比,撐死排第八第九。

但華爲做了一件很聰明的事:不跟你拼單卡,在系統層面翻盤。

CloudMatrix 384 超節點。384 張 910C 全對等互聯,CPU 和 NPU 平起平坐,跨節點延遲不到一微秒。這個架構下跑 DeepSeek V3.2,單卡推理 2,300-2,400 tok/s。同一個場景 H20 只有 800。MoE 大模型推理,計算效率全面壓過 H100。

幾個硬數據:

- 中國電信用 910C 集羣跑 DeepSeek 671B滿血版,單卡 2,122 tok/s,刷新了業界紀錄

- 千卡集羣訓練線性度超 95%

國內近半數大模型用昇騰訓練,GLM-5 就是 10 萬張昇騰集羣訓出來的

2025 年 Q3 出貨 70 萬顆

推理成本大概是英偉達方案的十分之一

當然也得說實話。CANN 跟 CUDA 差距還很大,生態兼容性是硬傷。出了中國基本用不到這張卡。但就”制裁之下保算力底線”這件事來說,華爲做得比大多數人想象的好得多。

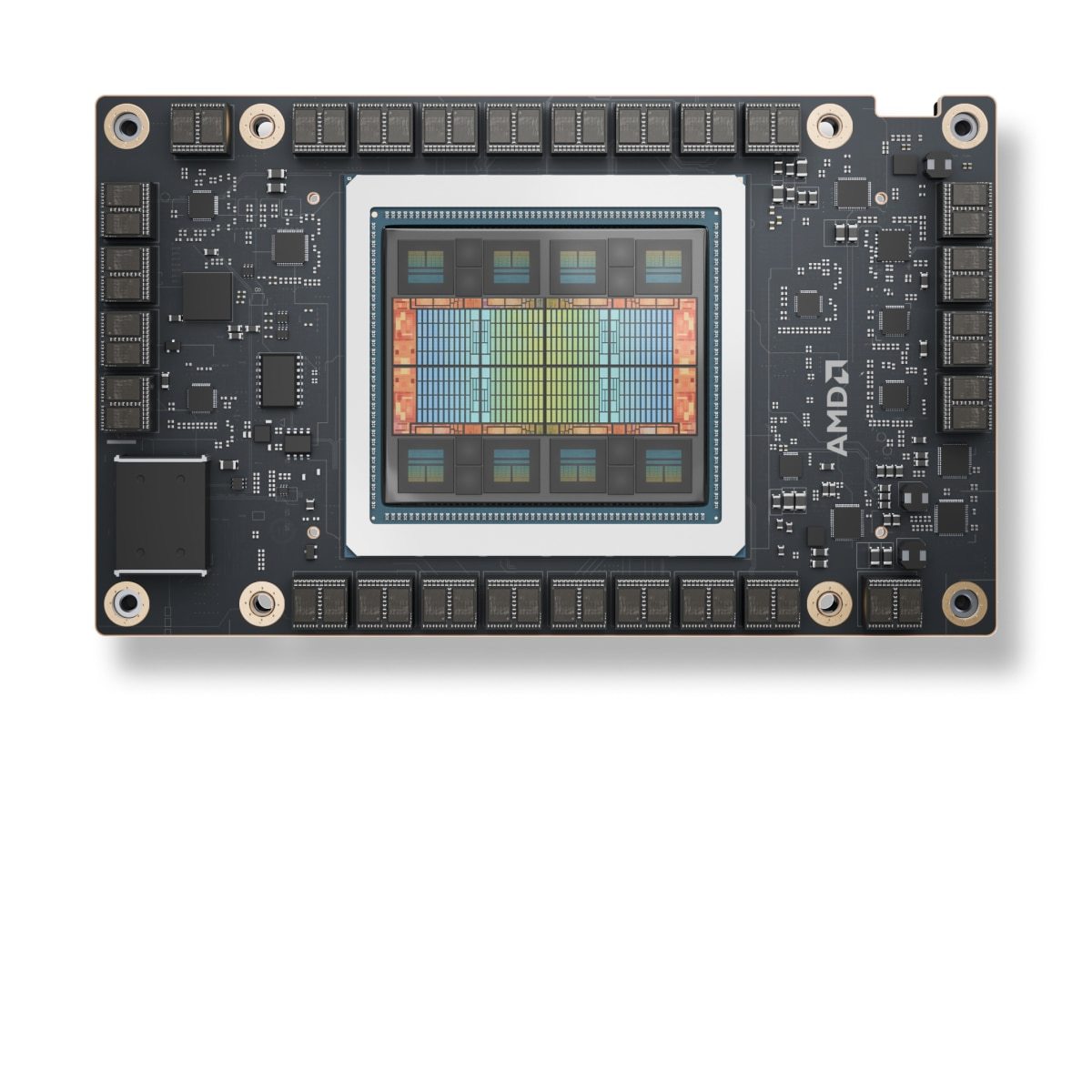

第 5 名:AMD MI300X

- 架構:CDNA 3(5nm+6nm 芯粒)

- 顯存:192GB HBM3,帶寬5.3TB/s

- 算力:FP8 2.61 PFLOPS;FP16/BF16 1.3 PFLOPS

- 功耗:750W

MI300X 是 AMD 真正在 AI 市場站住腳的一張卡。

192GB HBM3。同期 H100 才 80GB,它是人家 2.4 倍。算力 2,615 TFLOPS FP8,比H100 高一截。價格十萬出頭,H100 可是奔二十萬去的。單看紙面,MI300X 簡直按着H100 打。

實際用起來也確實有兩把刷子。大顯存在推理場景是實打實的優勢——同一個 70B,H100 得 Q4 量化才能單卡跑,MI300X 能用更高精度,或者同精度留更多 KV Cache 給長上下文。大 batch 推理,單卡併發用戶數是H100 的 2.3 倍。vLLM 上跑 GLM-5 這種744B 的 MoE,TCO 甚至比 H200 還低。

但是。這一切有個前提:你搞得定 ROCm。

AMD 這兩年軟件上確實在拼了。ROCm 7.x已經覆蓋了 CUDA 12.5 大概九成二的 API,PyTorch、vLLM 這些主流框架官方支持也跟上了。但實際部署的時候,碰到冷門算子或者需要手寫 kernel,該踩的坑一個都跑不掉。延遲也跟不上——同樣八卡集羣,推理延遲比NVIDIA 高了三四成到七八成。

MI300X 就是那種”上限很高、下限也很低”的卡。搞好了比 H100 強還便宜,搞不好跑得還不如 A100。你團隊裏有沒有 AMD FAE 資源?主要負載是不是 vLLM/PyTorch 這些適配好的框架?兩個問題想清楚,答案就有了。

第 4 名:NVIDIA H100

- 架構:Hopper(霍普)

- 顯存規格:主流80GB HBM3版本,顯存帶寬3.35 TB/s;另有141GB HBM3e升級款

- 峯值算力:FP8 約3958 TFLOPS,是A100的3倍左右

- 功耗:PCIe版350W,SXM高性能版最高700W

H100 已經不是最新最強的卡了。但它仍然是目前最重要的卡。

從 GPT-4 到 DeepSeek V3.2 到 Qwen 3.5,你能叫得上名字的大模型,訓練階段幾乎都跑過 H100 集羣。過去三年,這張卡就是 AI 行業的水和電。

2026 年了,爲什麼我還把它放第四?

三件事。第一,生態。CUDA + NVLink 4(900 GB/s)+ MIG + Transformer Engine,這套東西在千萬卡時級別的集羣上跑了三年多,每一家 AI Infra 團隊都知道怎麼調、怎麼修。換成 B200 或者 MI300X,光踩坑就得踩小半年。生產環境,穩定比性能重要一百倍。

第二,雲上價格在持續跌。國內 H100 競價已經降到五塊多一小時了,70B 推理的每百萬 token 成本完全可以接受。

第三,多卡能力。NVLink 4 加持,八卡 SXM 幾乎線性擴展。MIG 還能把單卡切成七個實例跑多租戶。

能跑什麼?Qwen 3.5-27B FP16 單卡綽綽有餘。Qwen 3.5-122B-A10B Q4 單卡 25-40 tok/s。DeepSeek V3.2 FP8 就得兩張卡 NVLink 了。

第 3 名:AMD MI325X

- 架構:CDNA 3(5nm+6nm 芯粒)

- 顯存:256GB HBM3E,帶寬6.0TB/s

- 算力:FP8 2.61 PFLOPS;FP16/BF16 1.3 PFLOPS

- 功耗:約1000W

MI325X,簡單概括:顯存怪獸。

核心跟 MI300X 一樣,還是 CDNA 3。顯存從192GB 拉到 256GB,帶寬從 5.3 拉到 6.0 TB/s。價格十三四萬,多出來的錢全砸顯存上了。

256GB。2026 年 5 月這個時間點,所有你能買到的貨架產品裏,這就是最大的。B300 的288GB 纔剛開始小批量出貨,大部分人根本拿不到。

這意味着什麼?70B FP16 全精度跑完,還剩一百多 GB 給 KV Cache,長上下文隨便造。MoE 更是它的絕對主場——DeepSeek V3.2這種架構,顯存佔用大頭是參數不是 KV Cache,大顯存的優勢直接被放大。百B 級別MoE 跑 Q4,單卡搞定。在別的卡上想都不敢想。

vLLM 實測跑摘要類長上下文任務,MI325X的 TCO 甚至壓 H200 一頭。

但老問題還是那個:ROCm。硬件底子確實強,軟件能不能讓你跑出理論性能的八成還是五成,全看你自己團隊的功力。而且MI325X 是過渡代——AMD 真正的大招是MI355X(CDNA 4,3nm,FP4),現在買325X 的人心裏多少都會犯嘀咕:”我要不要再等等?”

我的看法:你如果天天跑 MoE 或者動不動 128K 長上下文,256GB 的 MI325X 是目前唯一選擇。其他場景,要麼 H200,要麼等 MI355X。

第 2 名:NVIDIA H200

- 架構:Hopper(GH100,臺積電4N)

- 顯存:141GB HBM3e,帶寬4.8TB/s

- 算力:FP8 3958 TFLOPS;FP16/BF16 1979 TFLOPS

- 功耗:SXM版約700W,PCIe版約350W

H200 是 H100 的“換顯存不換芯”升級版。還是 Hopper 架構,FP8 算力一個數沒變。但HBM3 換成了 HBM3e,顯存從 80GB 拉到141GB,帶寬從 3.35 拉到 4.8 TB/s。

直購十八九萬,跟 H100 差不多。這一個改動直接把能跑的模型範圍從“70B 以下”拽到了“70B 及以上”。以前 H100 跑 70B 得兩張卡NVLink,現在 H200 一張卡就夠了。

CloudRift 今年一月的實測數據(8 卡集羣,16K 上下文):

- GLM-4.5-Air AWQ 4bit → 5,463 tok/s

- Qwen3-Coder-480B AWQ(4 路張量並行) → 4,263 tok/s

- GLM-4.6 FP8(8 路張量並行) → 5,588 tok/s

還有個容易被忽略的細節:長上下文衰減。

H200 從 2K 拉到 16K,吞吐掉了大概四成六。H100 掉了六成四。差距就在這裏——KV Cache 不夠用,多長的上下文都是白搭。

一張 H200 單卡跑 Qwen 3.5-122B-A10B Q4,60-80 tok/s,舒舒服服。加一張跑 FP16,直接上生產。多卡 NVLink 跑 DeepSeek V3.2,擴展性拉滿。

雲上競價七八塊一小時,每百萬 token 成本不算最便宜。但 141GB 這個級別,生態、性能、穩定性全算上,沒有真正的對手。

70B 級別,H200 就是那個你不需要思考的答案。

第 1 名:NVIDIA B200

- 架構:Blackwell(雙Die,GB202×2,臺積電4NP)

- 顯存:192GB HBM3e,帶寬8TB/s

- 算力:FP4 18 PFLOPS;FP8 4.5 PFLOPS

- 互聯:NVLink 5,單卡雙向1.8TB/s

- 功耗:約1000W(液冷)

第一沒任何懸念。而且第二名離它差得不是一點半點。

Blackwell 架構,臺積電 4NP,2080 億晶體管,雙 Die 通過 10TB/s 片內互聯封在一起。幾個數字:

- 192GB HBM3e,帶寬 8 TB/s。H200 是4.8,H100 是3.35

- FP8 算力 4500 TFLOPS(4.5 PFLOPS)。H100 的 2.27 倍

- 原生 FP4,開稀疏模式 18000 TFLOPS(18 PFLOPS)

FP4 是 B200 最讓我興奮的東西。以前量化最低到 FP8,FP4 精度損失太大不敢上生產。Blackwell 第五代 Tensor Core 做了硬件級FP4 支持,很多模型能做到速度翻倍、精度基本不掉。翻譯一下:同樣的模型、同樣的效果,推理成本只有 H100 的三分之一到六分之一。

實測數據(MLPerf Inference v6.0,2026 年4月):

- 70B 級別 FP4 推理,單卡 B200 飆到~13000 tok/s。同樣場景 H200 約 7800,H100 約 3000。一腳油門到底,H200 的 1.7 倍、H100 的 4 倍多

GPT-OSS 120B MoE FP8,8 卡 B200 衝到 93,071 tok/s,單卡均分 ~11,600 tok/s。H200 的三倍多

DeepSeek R1 671B MoE,8 卡 B200 → 58,582 tok/s(offline 模式)

訓練 70B:單卡頂倆 H200,速度快一半,成本低三成

NVLink 5,單卡 1.8 TB/s,八卡 HGX 總互聯 14.4 TB/s。DGX B200 單機八卡,1,440GB 總顯存,FP4 總算力 144 PFLOPS。這些數字放兩年前說出來都沒人信。

當然,沒有完美的卡。B200 的毛病也很實在:

貴。一張二十多萬打不住,八卡 DGX 奔兩百萬

熱。單卡 1,000W,八卡滿載 14kW+,不上液冷根本壓不住

難買。2025 年 Blackwell 佔了 NVIDIA 高端出貨的八成三,但訂單積壓十二個月。你現在下單,拿到手可能已是 2027 年

FP4 不是無腦用的,得你自己驗證模型精度損失能不能接受

但這些毛病怪不了 B200——只能怪它太強了,強到所有人都想要,產能根本追不上。

看花了眼?直接按場景對號入座

個人玩家,想在自己電腦上跑模型:

先去 nengpaoma.cn 查你現在這張卡能跑啥。Qwen、DeepSeek、GLM 主流模型全列出來了,還能看大概 tok/s。說不定你手裏的卡已經夠用了。

真要升級?工作站上 RTX PRO 6000(96GB)。數據中心卡別碰,那功耗和散熱不是你家裏搞得定的。

創業公司搭推理 API,預算有限:

7B-13B 上 L40S,阿里雲競價一小時兩三塊。70B 上 H100 或 H200。現階段租,別買。現金流比固定資產重要。

自建機房訓 70B+:

首選 H200 八卡集羣。預算夠直接 B200。團隊有 AMD 積累的話 MI300X/325X 能省不少硬件錢——但軟件上多花的時間自己掂量。

國內買不到高端英偉達:

昇騰 910C,唯一現實選項。推理已經很能打了,訓練差距在縮小。但 CANN 遷移成本別低估。

主攻 MoE(DeepSeek 這種):

顯存優先。MI325X(256GB)、昇騰 910C CloudMatrix、B200 都行。看預算和供貨選。

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com