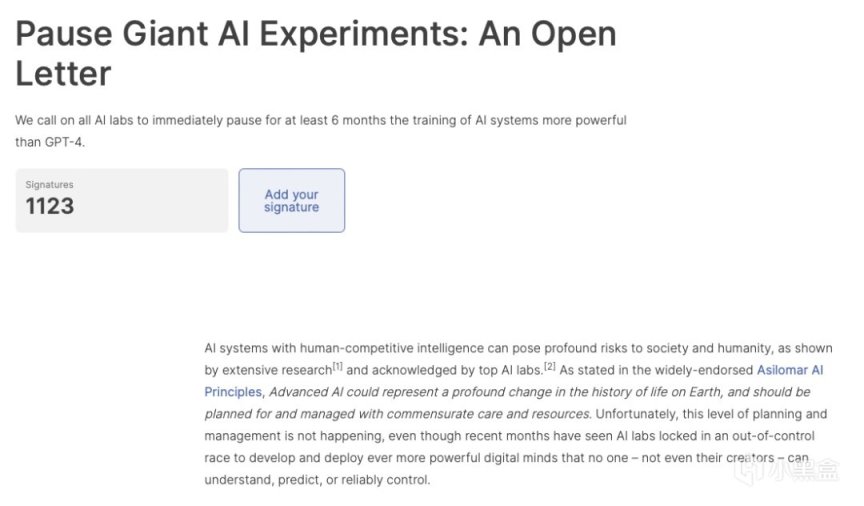

特斯拉首席执行官、推特“掌门”埃隆·马斯克与以及超过1000位科技人士签署了联名信,在公开信中,呼吁暂停训练比开放人工智能研究中心(OpenAI)新推出的GPT-4模型更强大的人工智能系统至少6个月,理由是它们对社会和人类构成潜在风险。

联名信中强调:最近几个月,人工智能实验室陷入了一场失控的竞赛。

联名信指出,具有与人类有同等竞争力的人工智能系统会对社会和人类构成巨大的风险。公开信呼吁暂停高级人工智能的研发,呼吁所有人工智能实验室立即暂停比ChatGPT-4更强大的人工智能系统的训练,暂停时间至少为6个月。直到为此类设计制定、实施共享安全协议,并由独立专家审核。公开信写道:“只有在我们确信它们有积极效果且风险可控时,才应研发强大的人工智能系统。”

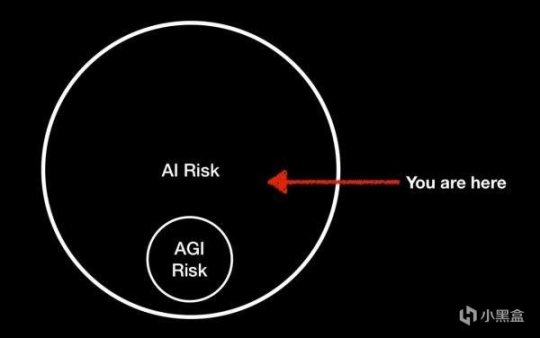

这封公开信还详细介绍了与人类竞争的人工智能系统将可能以破坏经济和政治的形式对社会和文明造成的潜在风险,并呼吁开发者与决策者和监管机构展开合作。

具体节选公开信片段如下:

广泛的研究表明,具有与人类竞争智能的人工智能系统可能对社会和人类构成深远的风险,这一观点得到了顶级人工智能实验室的承认。正如广泛认可的“阿西洛马人工智能原则(AsilomarAIPrinciples,阿西莫夫的机器人三大法则的扩展版本,于2017年由近千名人工智能和机器人专家签署)中所述,高级AI可能代表地球生命史上的深刻变化,应该以相应的关照和资源进行规划和管理。不幸的是,这种级别的规划和管理并没有发生,尽管最近几个月人工智能实验室陷入了一场失控的竞赛,以开发和部署更强大的数字思维,没有人——甚至他们的创造者——能理解、预测或可靠地控制。

“当代人工智能系统现在在一般任务上变得与人类具有竞争力,我们必须扪心自问:我们是否应该让机器用宣传和谎言充斥我们的信息渠道?我们是否应该自动化所有工作,包括令人满意的工作?我们是否应该发展最终可能比我们更多、更聪明,淘汰并取代我们的非人类思维?我们应该冒险失去对我们文明的控制吗?”

“只有当我们确信它们的影响是积极的并且风险是可控的时候,才应该开发强大的人工智能系统。这种信心必须有充分的理由,并随着系统潜在影响的规模而增加。OpenAI最近关于通用人工智能的声明指出,‘在某些时候,在开始训练未来的系统之前进行独立审查可能很重要,并且对于最先进的工作来说,应该同意限制用于创建新模型的计算量增长。’我们同意。那个某些时候就是现在。”

不知道各位盒友怎么看呢?#ai人工智能#

在小黑盒PC端加速器输入Kenan66、wjb66或wow66,即可每月分别白嫖三天会员时长,鹅鹅杀必备的加速器加速器加速多个地区,支持steam微软NS亚马逊等商城,有多个小号每月稳定白嫖

更多游戏资讯请关注:电玩帮游戏资讯专区

电玩帮图文攻略 www.vgover.com

![慢讯:阿里通义千问Qwen核心负责人离职[cube_滑稽]](https://imgheybox1.max-c.com/bbs/2026/03/07/381409aa8b7b37bd877f9706e0a22f64.jpeg?imageMogr2/auto-orient/ignore-error/1/format/jpg/thumbnail/398x679%3E)