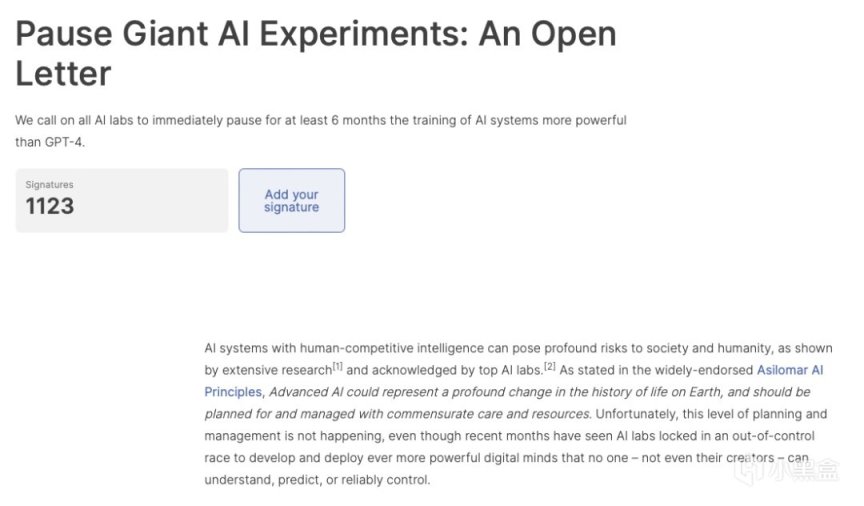

特斯拉首席執行官、推特“掌門”埃隆·馬斯克與以及超過1000位科技人士簽署了聯名信,在公開信中,呼籲暫停訓練比開放人工智能研究中心(OpenAI)新推出的GPT-4模型更強大的人工智能系統至少6個月,理由是它們對社會和人類構成潛在風險。

聯名信中強調:最近幾個月,人工智能實驗室陷入了一場失控的競賽。

聯名信指出,具有與人類有同等競爭力的人工智能系統會對社會和人類構成巨大的風險。公開信呼籲暫停高級人工智能的研發,呼籲所有人工智能實驗室立即暫停比ChatGPT-4更強大的人工智能系統的訓練,暫停時間至少爲6個月。直到爲此類設計制定、實施共享安全協議,並由獨立專家審覈。公開信寫道:“只有在我們確信它們有積極效果且風險可控時,才應研發強大的人工智能系統。”

這封公開信還詳細介紹了與人類競爭的人工智能系統將可能以破壞經濟和政治的形式對社會和文明造成的潛在風險,並呼籲開發者與決策者和監管機構展開合作。

具體節選公開信片段如下:

廣泛的研究表明,具有與人類競爭智能的人工智能系統可能對社會和人類構成深遠的風險,這一觀點得到了頂級人工智能實驗室的承認。正如廣泛認可的“阿西洛馬人工智能原則(AsilomarAIPrinciples,阿西莫夫的機器人三大法則的擴展版本,於2017年由近千名人工智能和機器人專家簽署)中所述,高級AI可能代表地球生命史上的深刻變化,應該以相應的關照和資源進行規劃和管理。不幸的是,這種級別的規劃和管理並沒有發生,儘管最近幾個月人工智能實驗室陷入了一場失控的競賽,以開發和部署更強大的數字思維,沒有人——甚至他們的創造者——能理解、預測或可靠地控制。

“當代人工智能系統現在在一般任務上變得與人類具有競爭力,我們必須捫心自問:我們是否應該讓機器用宣傳和謊言充斥我們的信息渠道?我們是否應該自動化所有工作,包括令人滿意的工作?我們是否應該發展最終可能比我們更多、更聰明,淘汰並取代我們的非人類思維?我們應該冒險失去對我們文明的控制嗎?”

“只有當我們確信它們的影響是積極的並且風險是可控的時候,才應該開發強大的人工智能系統。這種信心必須有充分的理由,並隨着系統潛在影響的規模而增加。OpenAI最近關於通用人工智能的聲明指出,‘在某些時候,在開始訓練未來的系統之前進行獨立審查可能很重要,並且對於最先進的工作來說,應該同意限制用於創建新模型的計算量增長。’我們同意。那個某些時候就是現在。”

不知道各位盒友怎麼看呢?#ai人工智能#

在小黑盒PC端加速器輸入Kenan66、wjb66或wow66,即可每月分別白嫖三天會員時長,鵝鵝殺必備的加速器加速器加速多個地區,支持steam微軟NS亞馬遜等商城,有多個小號每月穩定白嫖

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com

![慢訊:阿里通義千問Qwen核心負責人離職[cube_滑稽]](https://imgheybox1.max-c.com/bbs/2026/03/07/381409aa8b7b37bd877f9706e0a22f64.jpeg?imageMogr2/auto-orient/ignore-error/1/format/jpg/thumbnail/398x679%3E)