各位好,我们是果核剥壳旗下的AI方向新账号 —— 飞碟AI,初来乍到小黑盒(来摸鱼,真的),还请各位多多关注我们,感激不尽!!

最近,美国的父母们有点心累。

不是因为孩子不写作业,而是因为他们用 AI,搞了个“流浪汉进家门”的恶作剧。

故事起源于 TikTok。

不少青少年发现,用生成式 AI 做点“有意思的东西”实在太简单了。于是他们开始伪造一张图:

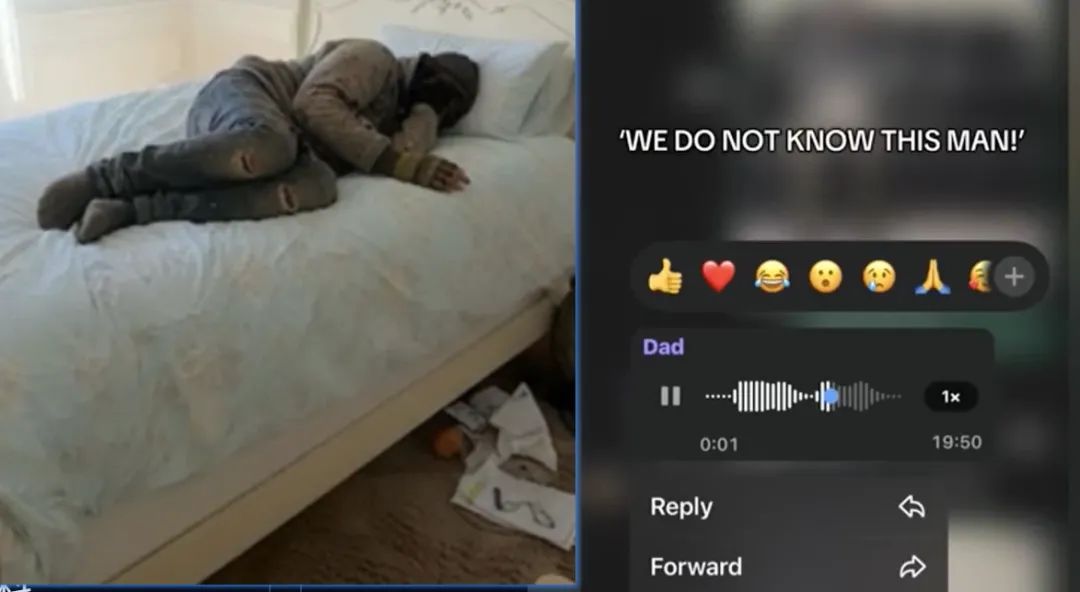

家里的沙发上,多了个衣衫褴褛的陌生男人,旁边还配字——

“他说认识你,所以我让他进来了。”

然后,把照片发给爸妈。

父母的反应?

“WE DO NOT KNOW THIS MAN!!!(英文语境里全大写类似于大叫)”

美国的 911 接线员估计都快崩溃了:

一天接到几个电话,说家里有陌生人闯入,结果全是孩子用 AI 编的。这下好了,不只是家庭闹剧,直接上升成了社会事件。

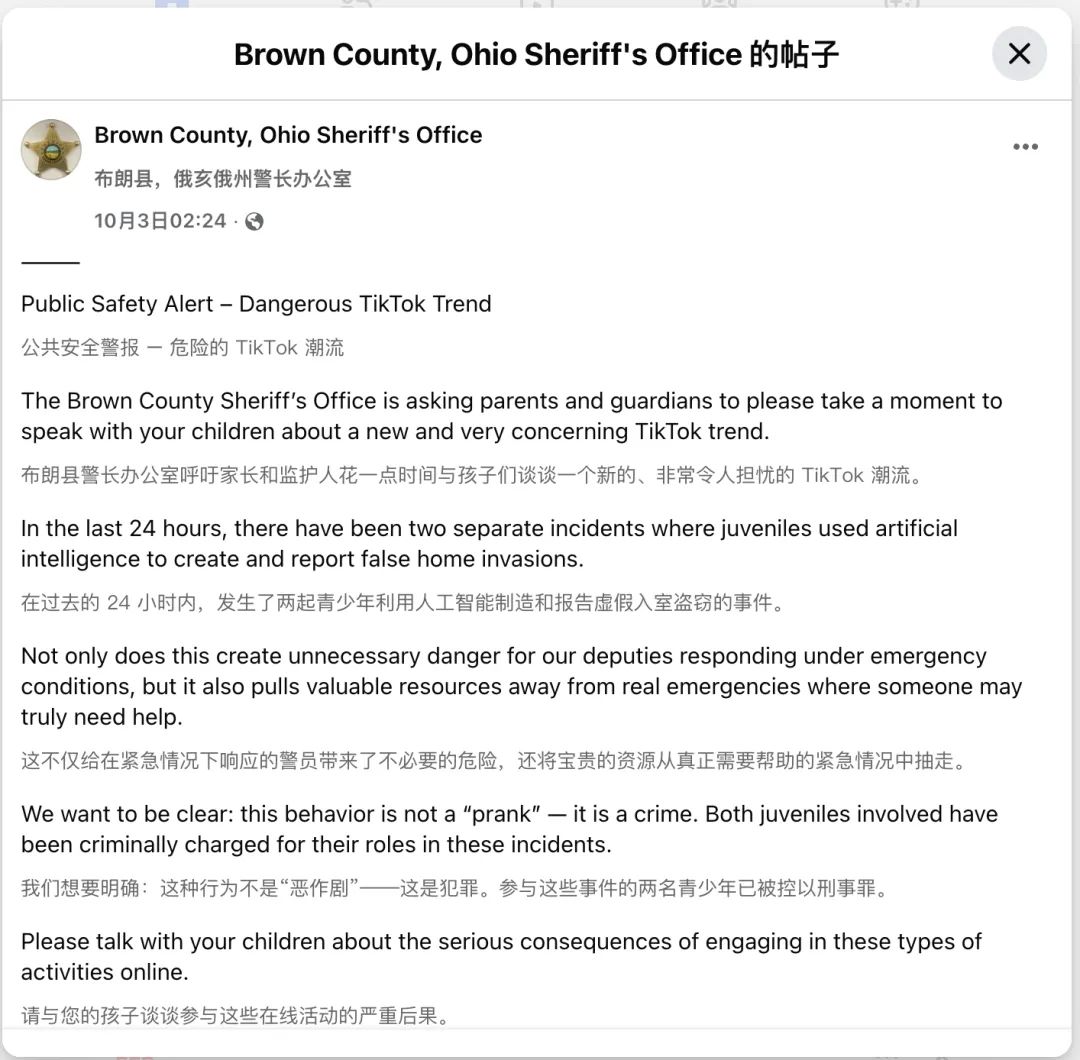

俄亥俄州布朗县警长办公室都发了公告:

“这不是恶作剧,这是犯罪。”

其实,这类“AI 整蛊”早就不是第一次出现。

从 Sora、Runway 到各种开源工具,AI 视频和图像生成已经低到“中学生可操作”的门槛,你想要什么场景,几秒钟就能出。

比如前阵子就有人用 Sora2,生成“牢大(科比)在卖冰红茶”的广告。

还有人做了牢大坠机后生还的视频,就...多少有点太地狱了......

当 AI 已经能在屏幕里制造“另一个现实”,恶作剧自然也升级了,以前吓父母靠藏衣柜、假蛇、曼妥思+可乐,现在靠一张“AI 图”就能让父母吓到报警。

但这事儿的问题在于:没人觉得自己是坏人。这些孩子的心态很简单——“我只是整蛊一下。”

可在警方看来,这是报假警,浪费公共资源。

马萨诸塞州的塞勒姆警察局直接发声明,说这种行为“愚蠢且危险”,还“非人化了无家可归者”。

听起来像是官方版的“我们不生气,只是失望”。

问题是,在这个人人都能造假图的时代,谁来判断“恶作剧”和“犯罪”的边界?

一旦 AI 影像太逼真,连警方都得先当真,而在出警之前,没人知道真相。

这就很危险了。

AI 技术的初衷是“让想象更自由”,结果最先被用来吓爸妈。

当然,这事也不只是美国独有,国内也有不少相关的例子,更不用说最近各大视频平台社交媒体上被用于娱乐所制作出的恶搞视频了。

本来老一辈的辨别这些的能力就比较弱,以前就有熊孩子拿画面拟真的枪战游戏发到家庭群忽悠老人玩。这下,未来家庭群里真保不准有熊孩子会发AI合成的“爸妈,我考了98分”“爸妈,学校今天来xxx了”“爸妈,我撞人了”。

这个萨尼有点勇

说到底,AI 伪造不再是高科技圈的玩具,它已经渗透进最日常的生活,一群普通青少年,用免费的模型生成“现实感十足”的场景。

且这些AI目前几乎处于野蛮生长的阶段,对于这种行为,你很难去说违反了什么什么具体的法律,只能靠道德去约束。当“造假”门槛低到只需要一句提示词,谎言和玩笑的界限,也就彻底模糊了。

在这个真假难辨的时代,我们似乎正在集体习惯“怀疑一切”。

稍微敏感点的,随便看到一张“照片”或是“视频”都会想:“这是真的还是 AI 生成的?”

这种“怀疑感”某种程度上保护了我们,但也慢慢削弱了“信任”。AI 带来的不是纯粹的真假危机,而是一种“心理疲劳”。

当你连亲人的一张照片都需要验证来源,那人类的信任机制就彻底被打碎了。

有人说,AI 是一面镜子,照出了人性。我觉得,它更像一面放大镜——放大了恶作剧的冲动,也放大了信任崩塌的速度。

从“流浪汉进家门”到“牢大卖冰红茶”,AI 的真正能力,不在生成,而在说服。

它能让人相信根本不存在的东西。

我们正在习惯一个真假同价的世界。

朋友圈有 AI 自拍,作业是 AI 写的,连段子也是 AI 编的(其实我们现在写这些文章也会使用AI进行辅助润色之类)。

当真与假都能制造,真假也就不重要了。

AI 已经走出实验室,进了我们的生活。有人拿它创作,有人拿它骗人(当然,我还见过至今都还很抗拒AI的人)。

也许再过不久,你在手机上看到你好哥(大)们(儿)发来一句:

“牛逼不,我找到对象了。”

先别急着叼他,先看那人影,是不是 AI 生成的。

耄耋和do'ro

更多游戏资讯请关注:电玩帮游戏资讯专区

电玩帮图文攻略 www.vgover.com