各位好,我們是果核剝殼旗下的AI方向新賬號 —— 飛碟AI,初來乍到小黑盒(來摸魚,真的),還請各位多多關注我們,感激不盡!!

最近,美國的父母們有點心累。

不是因爲孩子不寫作業,而是因爲他們用 AI,搞了個“流浪漢進家門”的惡作劇。

故事起源於 TikTok。

不少青少年發現,用生成式 AI 做點“有意思的東西”實在太簡單了。於是他們開始僞造一張圖:

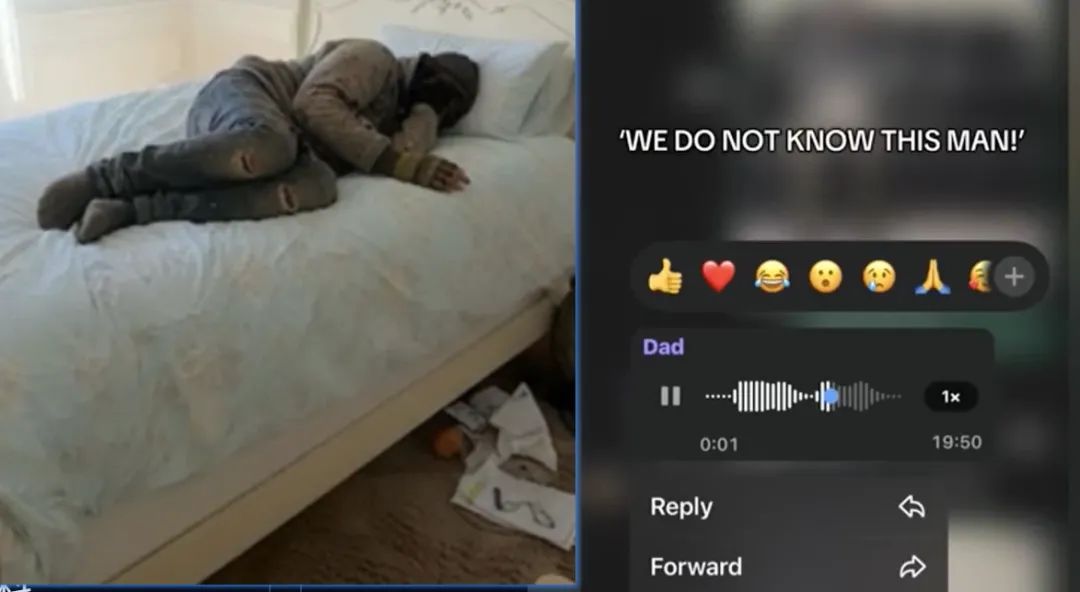

家裏的沙發上,多了個衣衫襤褸的陌生男人,旁邊還配字——

“他說認識你,所以我讓他進來了。”

然後,把照片發給爸媽。

父母的反應?

“WE DO NOT KNOW THIS MAN!!!(英文語境裏全大寫類似於大叫)”

美國的 911 接線員估計都快崩潰了:

一天接到幾個電話,說家裏有陌生人闖入,結果全是孩子用 AI 編的。這下好了,不只是家庭鬧劇,直接上升成了社會事件。

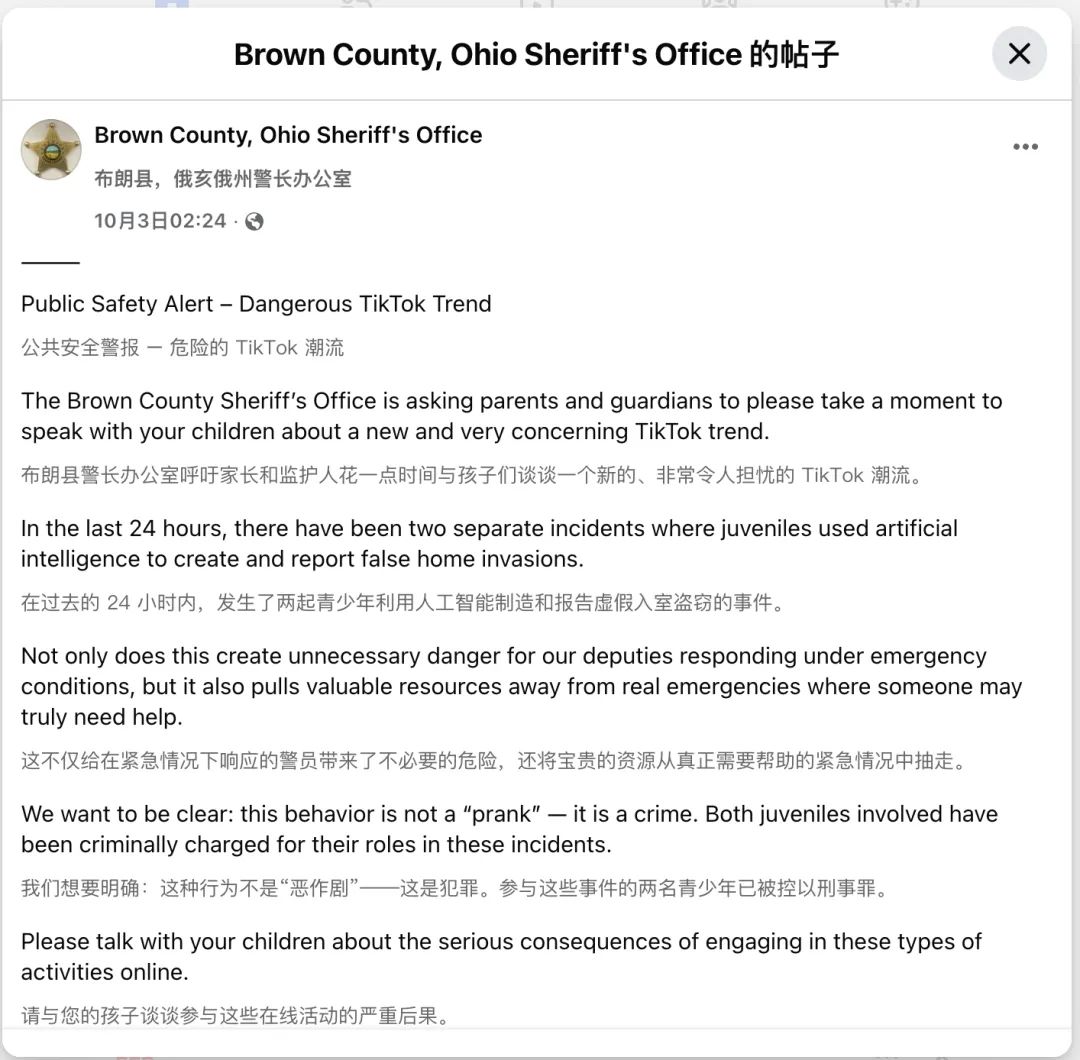

俄亥俄州布朗縣警長辦公室都發了公告:

“這不是惡作劇,這是犯罪。”

其實,這類“AI 整蠱”早就不是第一次出現。

從 Sora、Runway 到各種開源工具,AI 視頻和圖像生成已經低到“中學生可操作”的門檻,你想要什麼場景,幾秒鐘就能出。

比如前陣子就有人用 Sora2,生成“牢大(科比)在賣冰紅茶”的廣告。

還有人做了牢大墜機後生還的視頻,就...多少有點太地獄了......

當 AI 已經能在屏幕裏製造“另一個現實”,惡作劇自然也升級了,以前嚇父母靠藏衣櫃、假蛇、曼妥思+可樂,現在靠一張“AI 圖”就能讓父母嚇到報警。

但這事兒的問題在於:沒人覺得自己是壞人。這些孩子的心態很簡單——“我只是整蠱一下。”

可在警方看來,這是報假警,浪費公共資源。

馬薩諸塞州的塞勒姆警察局直接發聲明,說這種行爲“愚蠢且危險”,還“非人化了無家可歸者”。

聽起來像是官方版的“我們不生氣,只是失望”。

問題是,在這個人人都能造假圖的時代,誰來判斷“惡作劇”和“犯罪”的邊界?

一旦 AI 影像太逼真,連警方都得先當真,而在出警之前,沒人知道真相。

這就很危險了。

AI 技術的初衷是“讓想象更自由”,結果最先被用來嚇爸媽。

當然,這事也不只是美國獨有,國內也有不少相關的例子,更不用說最近各大視頻平臺社交媒體上被用於娛樂所製作出的惡搞視頻了。

本來老一輩的辨別這些的能力就比較弱,以前就有熊孩子拿畫面擬真的槍戰遊戲發到家庭羣忽悠老人玩。這下,未來家庭羣裏真保不準有熊孩子會發AI合成的“爸媽,我考了98分”“爸媽,學校今天來xxx了”“爸媽,我撞人了”。

這個薩尼有點勇

說到底,AI 僞造不再是高科技圈的玩具,它已經滲透進最日常的生活,一羣普通青少年,用免費的模型生成“現實感十足”的場景。

且這些AI目前幾乎處於野蠻生長的階段,對於這種行爲,你很難去說違反了什麼什麼具體的法律,只能靠道德去約束。當“造假”門檻低到只需要一句提示詞,謊言和玩笑的界限,也就徹底模糊了。

在這個真假難辨的時代,我們似乎正在集體習慣“懷疑一切”。

稍微敏感點的,隨便看到一張“照片”或是“視頻”都會想:“這是真的還是 AI 生成的?”

這種“懷疑感”某種程度上保護了我們,但也慢慢削弱了“信任”。AI 帶來的不是純粹的真假危機,而是一種“心理疲勞”。

當你連親人的一張照片都需要驗證來源,那人類的信任機制就徹底被打碎了。

有人說,AI 是一面鏡子,照出了人性。我覺得,它更像一面放大鏡——放大了惡作劇的衝動,也放大了信任崩塌的速度。

從“流浪漢進家門”到“牢大賣冰紅茶”,AI 的真正能力,不在生成,而在說服。

它能讓人相信根本不存在的東西。

我們正在習慣一個真假同價的世界。

朋友圈有 AI 自拍,作業是 AI 寫的,連段子也是 AI 編的(其實我們現在寫這些文章也會使用AI進行輔助潤色之類)。

當真與假都能製造,真假也就不重要了。

AI 已經走出實驗室,進了我們的生活。有人拿它創作,有人拿它騙人(當然,我還見過至今都還很抗拒AI的人)。

也許再過不久,你在手機上看到你好哥(大)們(兒)發來一句:

“牛逼不,我找到對象了。”

先別急着叼他,先看那人影,是不是 AI 生成的。

耄耋和do'ro

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com