在Gemini自动化功能发布之际,Google详细披露了Android系统底层的技术实现机制。该公司正"引入早期阶段的开发者功能,旨在弥合您的应用与代理应用及个性化助手(如Google Gemini)之间的鸿沟"。

尽管这一探索仍处于早期测试阶段,Google强调这些功能的设计"以隐私和安全为核心",这是应用生态系统探索这一范式转变的第一步。

Android系统提供两种技术路径。首先是AppFunctions,该功能虽于去年悄然发布,但直到现在才完全公开细节。作为Android 16平台功能及配套的Jetpack库,AppFunctions允许应用向调用者(如代理应用)暴露特定功能,使其能够在设备本地访问和执行这些功能。

开发者需将其应用能力详细描述为工具和代理及AI助手(如Gemini)可调用的工具。Google将AppFunctions比作目前在代理和服务器端工具中流行的模型上下文协议(MCP),但强调这些功能在Android设备本地运行。具体应用案例包括:

任务管理与生产力场景:当用户提出"提醒我今天下午5点在办公室取包裹"的请求时,调用者识别相关任务管理应用,并调用创建任务的功能,根据用户提示自动填充标题、时间和地点字段。

媒体与娱乐场景:用户请求"创建一个包含今年顶级爵士乐专辑的新播放列表"时,调用者在音乐应用内执行播放列表创建功能,将"2026年顶级爵士乐专辑"等上下文作为查询参数传递,立即生成并启动内容。

跨应用工作流场景:针对"从Lisa的邮件中找到面条食谱,并将食材添加到我的购物清单"的请求,该过程调用多个应用的功能。首先,调用者使用电子邮件应用的搜索功能检索内容,然后提取相关食材,再调用购物清单应用的功能填充用户的清单。

日历与日程安排场景:当用户说"把妈妈的生日派对添加到下周一下午6点的日历"时,经授权的代理应用调用日历应用的"创建事件"功能,解析"下周一下午6点"等相关上下文创建条目,无需用户手动打开日历应用。

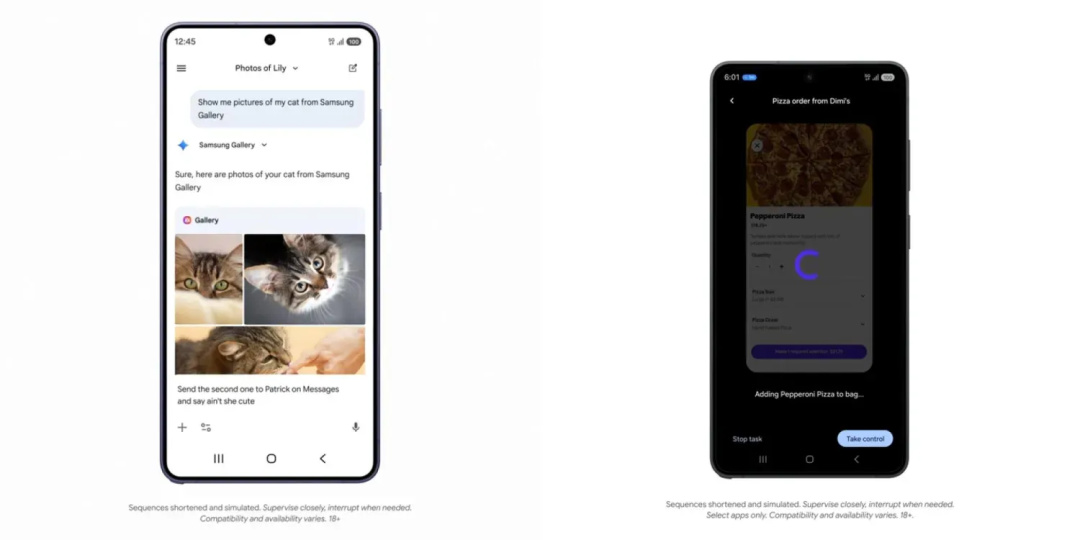

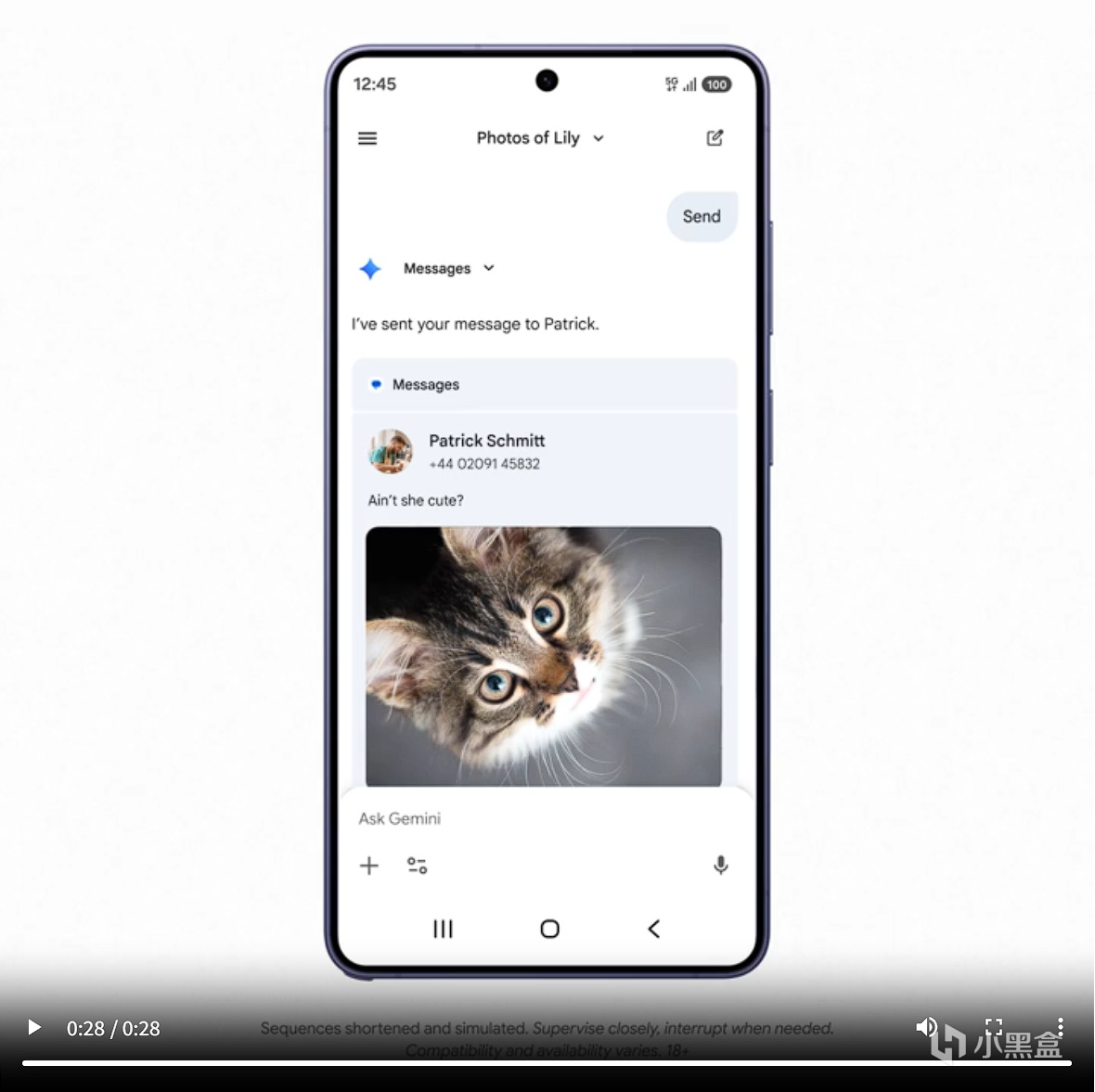

Google展示了AppFunctions在Galaxy S26上利用Samsung Gallery应用的示例。

用户无需手动滚动浏览相册,只需简单要求Gemini"从Samsung Gallery中显示我的猫的照片"。Gemini接收用户查询,智能识别并触发正确功能,直接将Samsung Gallery返回的照片呈现在Gemini应用内,用户无需离开当前界面。该体验支持多模态交互,可通过语音或文字完成。用户甚至可以在后续对话中使用返回的照片,例如通过短信发送给朋友。

与此同时,Google表示Gemini应用已开始使用AppFunctions为其在Google应用及OEM默认应用中的日历、笔记和任务集成提供支持。

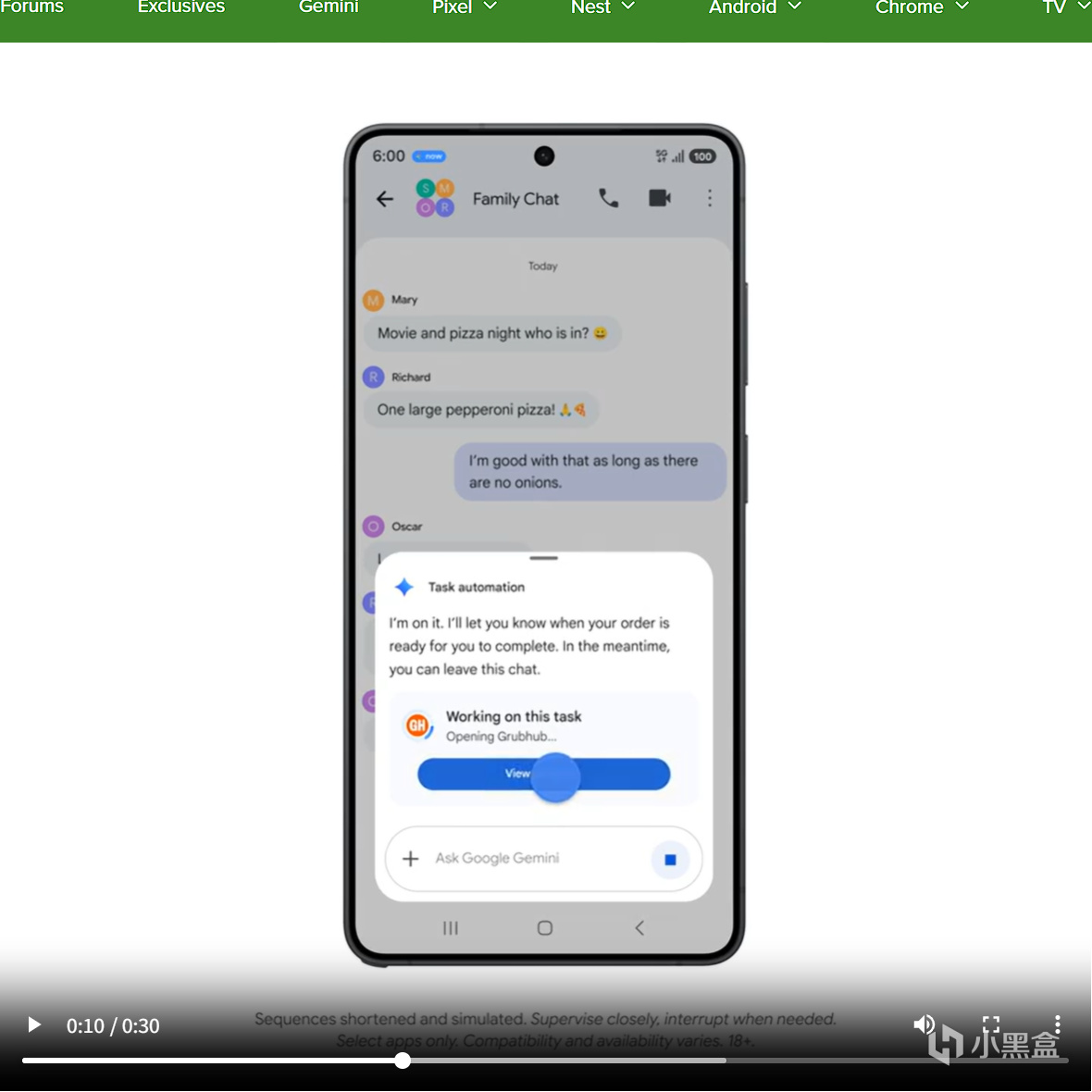

Android系统还在开发第二种方法,即今天上午针对Galaxy S26和Pixel 10系列宣布的Gemini自动化功能。Google解释:"虽然AppFunctions为应用与AI代理及助手通信提供了结构化框架和更强的控制,但我们知道并非每种交互都已具备专门的集成。"

为此,Google正在"开发UI自动化框架,使AI代理和助手能够在用户已安装的应用上智能执行通用任务"。该平台承担繁重工作,开发者无需编写代码即可获得代理功能,这是无需重大工程投入即可扩展覆盖范围的低门槛方式。

Google透露,Android 17将"扩大这些功能,覆盖更多用户、开发者和设备制造商"。公司目前"正与少数应用开发者合作构建体验,专注于在生态系统演进过程中提供高质量用户体验"。Google计划"今年晚些时候分享更多细节,说明如何利用AppFunctions和UI自动化为您的应用启用代理集成"。

更多游戏资讯请关注:电玩帮游戏资讯专区

电玩帮图文攻略 www.vgover.com

![[2.27]育碧大促,多款1折个位数,还有新史低背刺,不容错过!](https://imgheybox1.max-c.com/web/bbs/2026/02/26/20e6e5c82b166624c69bda44c91f94b3.png?imageMogr2/auto-orient/ignore-error/1/format/jpg/thumbnail/398x679%3E)