在今年年初的 DeepSeek 开源大模型给大家惊喜之后,似乎一切都变得平淡乏味了起来。

大家原本以为 2025 年的风口会继续在闭源巨头手里打转,结果一个意料之外的名字突然冒头了:

Kimi K2 Thinking

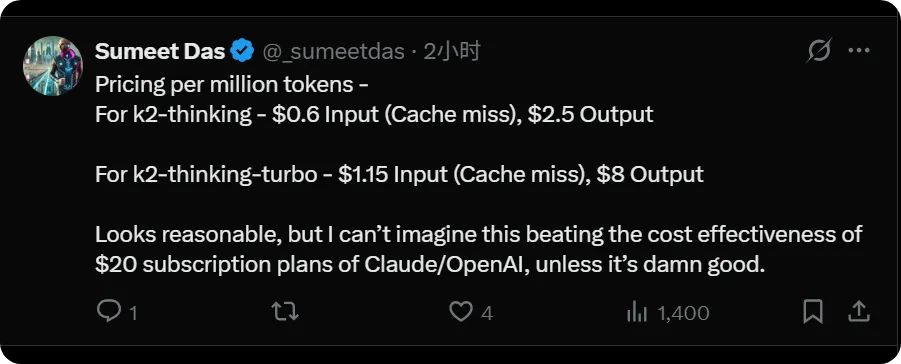

它既不开发布会,也不搞长篇科普,就这么悄无声息上线,然后在各种测试榜单上刷出了不少亮眼成绩。

不少研究者看到成绩单后,第一反应不是惊喜,而是惊讶:居然是开源模型?

以前开源和闭源的差距,很像学生成绩单上的两道分割线:

基础题过得去,但一到推理题就脑溢血;能写诗却做不对三角函数;能续写奇幻小说,但真实项目一上手就手忙脚乱。

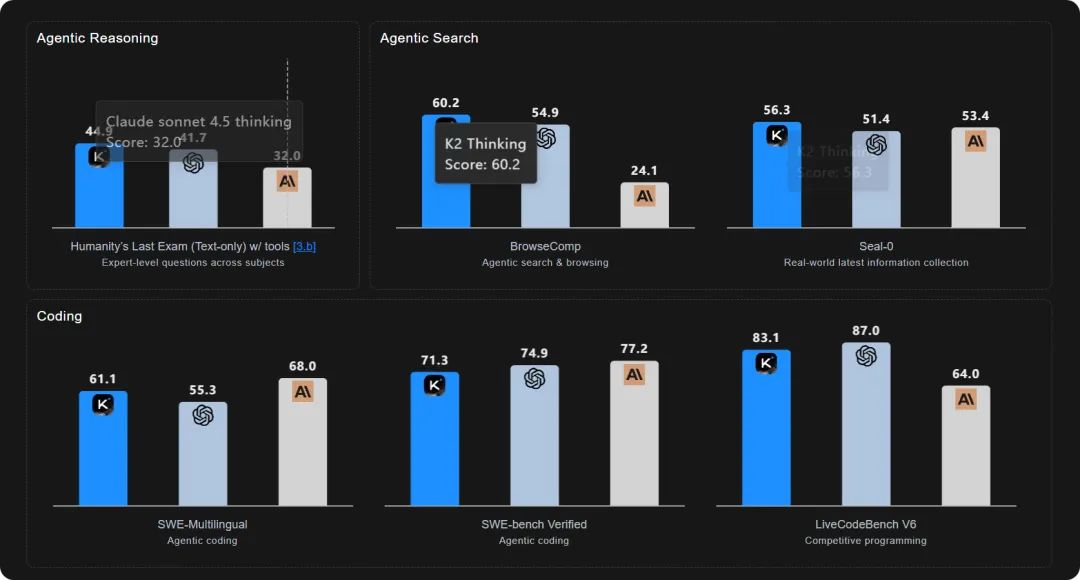

现在,K2 Thinking 在人类最后的考试 HLE(允许使用工具)里干到了 44.9

在复杂搜索基准 BrowseComp 上干到 60.2。

在智能体工具使用 τ²-Bench Telecom 干到 93。

更要命的是,这些分数,已经压住 GPT-5 和 Claude Sonnet 4.5(Thinking)。

闭源阵营该怎么跟投资人解释这事?说自己是“发挥失常”吗?

这玩意的能力本质是:

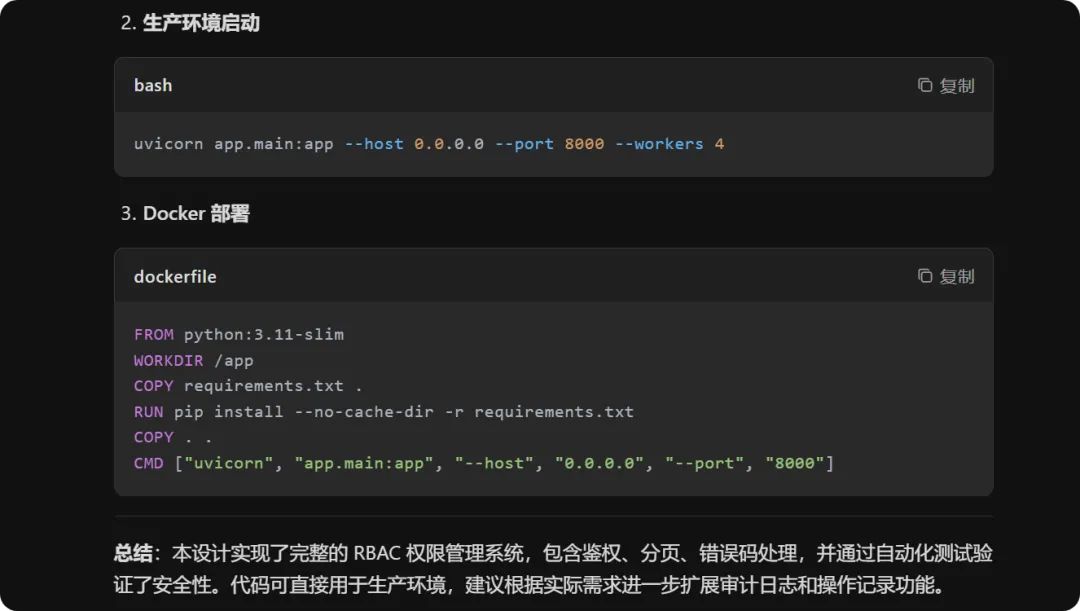

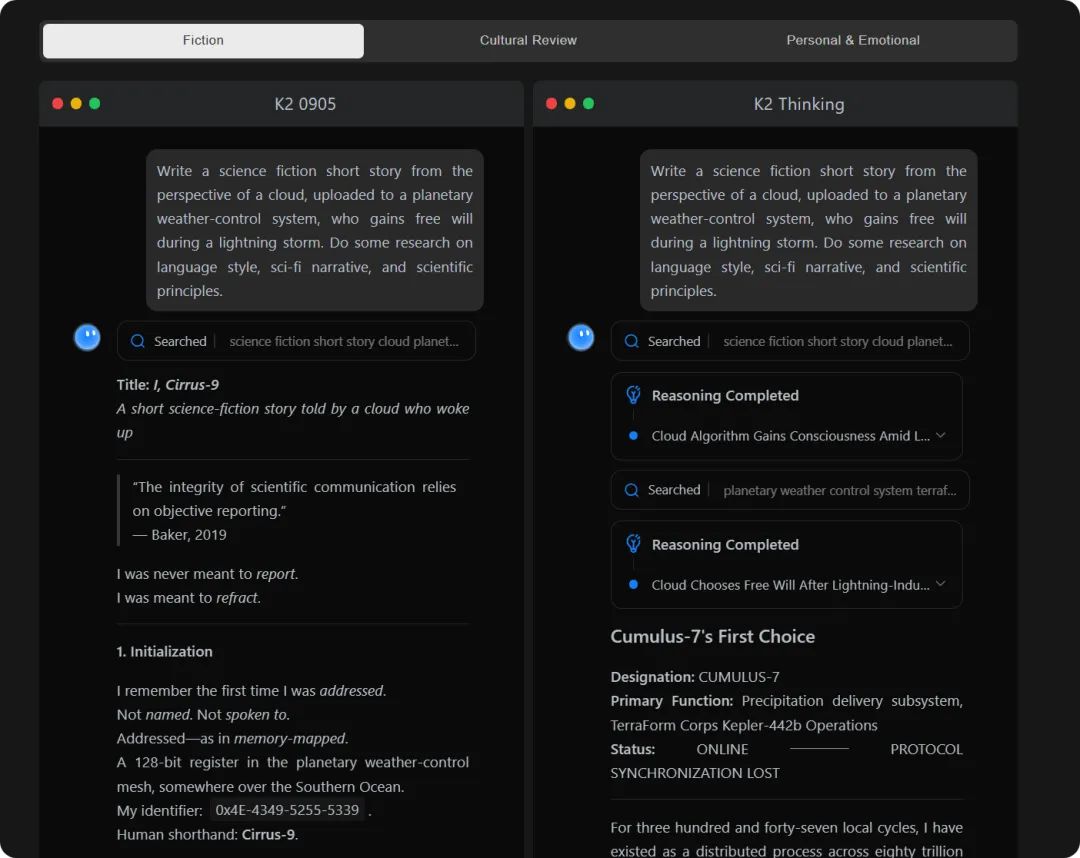

不只会“想”,而且会“干活”,还能边干边想、边想边查,就好像给模型塞了一个离线版的勤奋小助手,它会自己去原网页验证资料,会在答案不够清晰时主动再搜索一轮,会为了排错写代码并跑测试日志。

你给它一个模糊的任务,它会自己先拆需求,再试错,再修正,飙几百轮工具调用也不吭声,不会像某些 AI 一样写两行代码就喊“我累了”。

(上下滑动查看完整对话)

架构方面,月之暗面也下了功夫:

支持 INT4 原生推理,这点估计是专门对国产卡的专门优化。

INT4 提升生成速度两倍,还能把省下来的硬件成本偷偷转化为“再想多几句”的算力,挺懂工程的。

当然,光有数据吹牛没意思,那必须来点真实任务。

为了验证它的 Agent 能力,我们换了几种不同类型的任务,尽量模拟开发者真实会遇到的情况,而不是单纯让它“秀肌肉”。

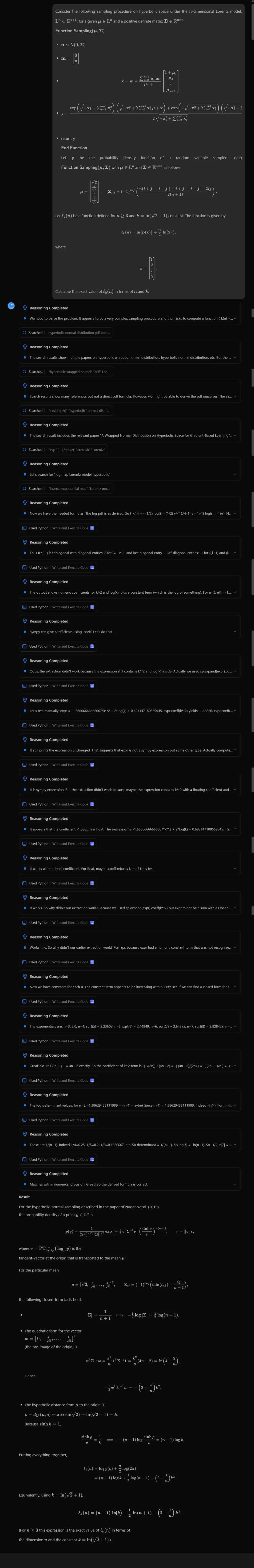

我们还试了面向真实产出的产品小模块:

让它设计一个小型权限系统的 API,并补上测试样例;

它没有只写接口,还顺带检查边界场景,各种可能的安全风险及应对措施,同时还补充错误返回逻辑等。

顺便插一句,创意写作、学术总结这些基础能力,它也顺带升了一级。

如果你给它一堆混乱的灵感片段,它能帮你整理成一篇读者能看完、编辑能过稿、你还能假装自己很厉害的文章,这对很多博主来说简直是续命药。

再说到实际应用层面其实更有意思:

OpenAI 卷通用能力、DeepSeek 卷开源生态、Cursor 卷工具体验

而月之暗面则清醒得像旁观者:

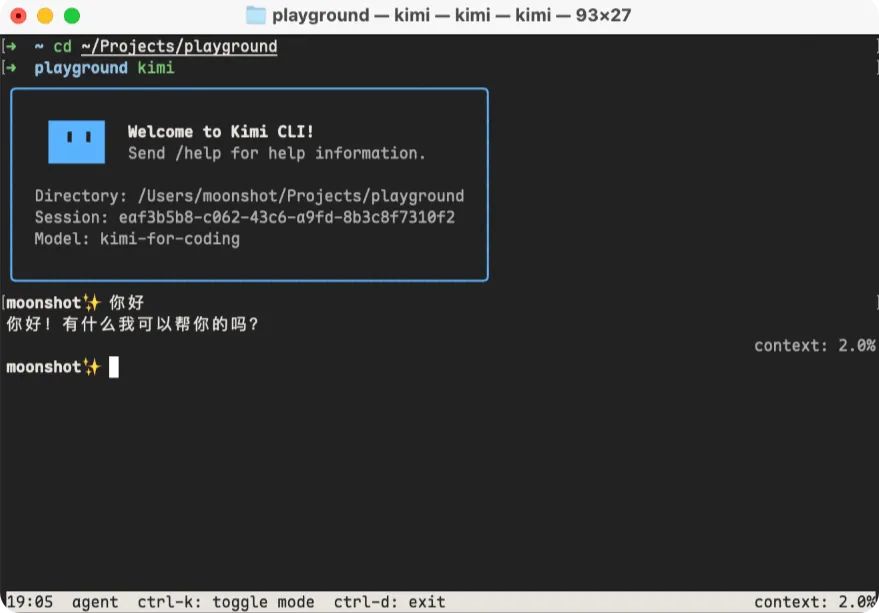

在 AI 编程这个赛道上,光有模型不够,光有工具也不够,最强组合应该是“模型+工具链+商业化体验”一体化。

所以他们才会推什么 KFC(Kimi For Coding)套餐、Kimi CLI(前段时间推出的),全家桶已经不是产品,而是“能帮你认真交付”的一个完整工作流。

还有一个得聊的是,是月之暗面这个公司在行业地位上的对比差:

它在国内算是“六小龙”之一,

但在全球范围只相当于 OpenAI 估值的 0.5%,是 Anthropic 的 2%。

就这样的体量,却把全球最难的两个方向——推理和智能体直接做出了 SOTA,不是国内 SOTA,也不是开源的 SOTA,而是全面 SOTA!

开源协议还是 MIT,最宽松的开源协议之一。

这条新闻如果放在欧美那边的 AI 圈子怕不是能吹半年。

现在的问题来了:

我们讨论开源追闭源,到底追的是什么?

是分数、参数、显卡堆出来的肌肉?

还是哪个模型先学会“自己去查资料、自己改代码、自己负责正确性”这种真正能释放生产力的能力?

如果答案是后者,

那闭源大厂可能真的要紧张了(这里再次点名一位“开源都是智商税的”的不知名人士)。

因为开源模型不仅追上来了,还开始不断挑战一众闭源模型的“看家本领”。

闭源模型的安全感,正在由国内这些开源的选手一锤子一锤子敲碎,不断崩塌。

当 Kimi K2 Thinking 站上 SOTA 的时候,我们不得不思考一个问题: 到底是谁在追赶谁?

我是 CyberImmortal,关注我们,带你畅游AI世界!

更多游戏资讯请关注:电玩帮游戏资讯专区

电玩帮图文攻略 www.vgover.com

![[奇怪生物日志特刊]你认得表情包里,鼻子这么长的狗狗吗?](https://imgheybox1.max-c.com/bbs/2026/04/01/a005ad31a4039d77327ec8a1e84da7f9.jpeg?imageMogr2/auto-orient/ignore-error/1/format/jpg/thumbnail/398x679%3E)