一轉眼,2025年又馬上過完了,

毋庸置疑,從多個維度來看,2025年都將在人工智能發展史上留下濃墨重彩的一筆,成爲一個具有重要意義的里程碑。

如果說2023年是“對話大模型之年”,2024年是“多模態之年”,那麼2025年我個人則更傾向稱之爲“推理、開源、視覺與智能體之年”(Year of Reasoning, Open Source, Vision, and Agents)。

與此同時,在這一年,作爲親身經歷者,我們完整地見證了兔子在人工智能領域從幾年前艱難起步,直至今年實現全面追趕,驚豔世界,甚至在部分領域實現反超的發展歷程。

這一年,從 DeepSeek R1 的發佈開始,行業首次真正意義上邁入全員“深度思考”時代。推理/思考模型全面崛起,行業重心從追求響應速度的“快思考”模型,系統性轉向具備思維鏈(Chain-of-Thought)能力的“慢思考”模型。OpenAI O 系列、阿里 Qwen 3-Thinking 等標誌性推理模型相繼推出,共同確立了邏輯推理能力作爲衡量大模型“智商”的新標準。

這一年,還是從 DeepSeek R1 開始,開源權重首次展現重塑全球格局的統治力。DeepSeek 以極低訓練成本和徹底開源,打破阿美利肯科技巨頭的算力護城河,引爆全球模型價格戰,並推動行業從“拼算力”轉向“拼效率”。這一“非對稱突圍”迅速引發連鎖反應——阿里 Qwen、月之暗面 Kimi 等紛紛開源多類模型,共同構建起以透明、高效、可復現爲核心的開源生態,讓“開放”成爲技術競爭力的新支柱。

這一年,以阿里通義萬相(Wan)和字節即夢(Seedream)以及快手可靈(Kling)爲代表,在音畫同步生成和物理規律模擬上展現了世界級的工程能力,甚至在商業化落地速度上超越了OpenAI的Sora (不過後續的Sora2再一次證明了其技術實力)。在圖像生成方面,Qwen、咕嚕咕嚕香蕉以及Pro還有Flux2等,將圖像生成質量推到了一個新的高度。

這一年,AI已不再侷限於單一的應用或模型。從3月的Manus智能體,到後續的努比亞豆包M153,我們目睹了AI在智能體(Agent)領域的發展,以及與操作系統的深度融合。這無疑是一條充滿挑戰且漫長的征程。

那麼,在今天——這一年的最後一天,飛碟AI將與各位一同回顧2025年人工智能領域中發生的、無論大小卻都值得我們關注的事件。

2025年1月

深度求索(DeepSeek)發佈 R1 推理模型

1月20日 – 兔子 AI 創企 DeepSeek 正式發佈了其 R1 推理模型。

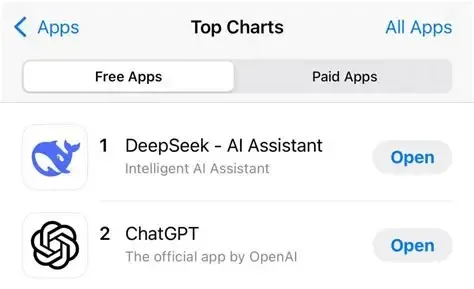

這一開源模型在發佈後迅速流行,甚至在阿美利肯 App Store 免費應用榜位列第一。

DeepSeek R1 以600萬美元的成本實現了接近 OpenAI 和 Google 同級水平的推理能力,顛覆了“巨量算力是 AI 必需品”的常規認知。

這次發佈顯示兔子廠商在大模型研發上迎頭趕上,美中 AI 博弈進入白熱化階段,也加速了全球 AI 模型開源和應用普及的浪潮。

2025年2月

阿里巴巴“萬相”2.1 視覺模型開源

2月25日 – 阿里雲旗下視覺生成基座模型萬相 2.1 (現在來看是夢的開始)(Wan2.1)在 GitHub 和 Hugging Face 等平臺全面開源。

此次開源包括 14B 和 1.3B 兩個規模的模型權重和推理代碼,並支持文本生成視頻、圖像生成視頻等任務。官方測試顯示,萬相 2.1 在視頻生成的諸多評測指標上大幅領先國內外同類模型。 Wan2.1的開源,標誌着阿里雲在 AI 視頻生成領域發力,開放策略降低了入門門檻,助力社區和行業進一步創新。

騰訊發佈元寶AI助手

2月13日 – 兔子科技巨頭騰訊正式發佈元寶AI助手App。

該全能AI應用基於自研混元大模型,支持AI搜索、寫作、文檔解析、圖像生成等多模態能力,覆蓋職場辦公、知識學習、生活娛樂場景,用戶一句話即可高效響應。元寶接入微信、QQ生態,提供公衆號內容及權威信源的聯網搜索,確保答案時新準確。

其在2025年初接入DeepSeek R1滿血版,支持深度思考與高速推理,2月17日更新混元+DeepSeek雙模型深度思考功能,免費開放複雜問題求解。3月DAU激增超20倍,電腦版上線截圖提問與深色模式。7月WAIC展發佈“1+3+N”AI全景圖,升級智能體平臺。8月接入DeepSeek V3.1,進一步提升響應速度。9月上線騰訊會議“AI託管”與公衆號評論區情緒感知。11月開源HunyuanVideo 1.5視頻生成模型。

12月,騰訊元寶發佈2025年度報告:DeepSeek模型調用量同比增長超百倍,全年新增定時提醒、任務管理等功能,憑藉生態整合與多模型融合,用戶體驗大幅提升,已穩居國內AI應用前三。元寶堅持“自研+開源”策略,與文心一言、豆包激烈競爭,通過融入微信等生態及多模態能力,降低門檻,推動AI向生活夥伴演進。

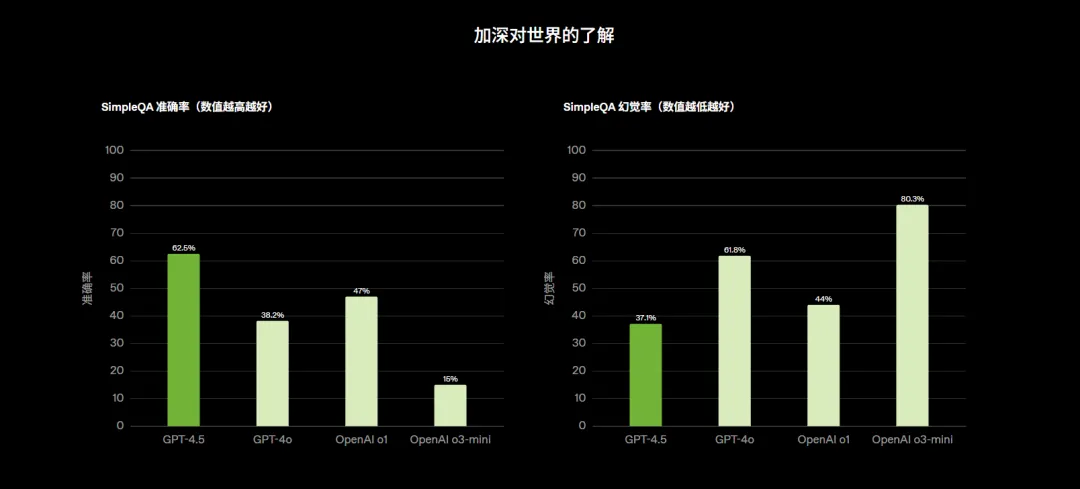

OpenAI 發佈 GPT-4.5

2月27日 – OpenAI 正式推出 GPT-4 的升級版 GPT-4.5。

這一研究預覽版模型相比 GPT-4 在預訓練規模上更進一步,擁有更廣泛的知識庫與更強的理解能力。官方指出 GPT-4.5 更善於把握模式、跟隨用戶意圖,交互體驗更自然,寫作、編程、解決問題等能力都有明顯提升。

作爲 OpenAI 最新的聊天模型,GPT-4.5 爲廣大開發者和普通用戶提供了升級的智能助理服務,是這一年全球範圍內 AI 能力躍升的代表之一。

2025年3月

Manus推出全球首款通用AI代理

3月6日 – 初創公司 Butterfly Effect 推出全球首款通用 AI 代理 Manus

Manus 定位爲自主執行復雜任務的通用 AI 智能體,能獨立處理市場研究、數據分析、編碼、旅行規劃、簡歷篩選等實世界任務,而無需持續人類監督。採用多智能體架構,在雲端虛擬環境中運行,支持異步操作和過程回放。

官方演示視頻迅速走紅,首周等待名單超200萬人。Manus 在 GAIA 基準測試中大幅超越 OpenAI Deep Research 等競品,被譽爲“兔子第二個 DeepSeek 時刻”。

其前身產品 Monica 已積累超1000萬用戶,爲 Manus 提供了技術和用戶基礎。

並且誰能預想到,在25年年底,Manus居然被Meta花10億美元收購。

2025年4月

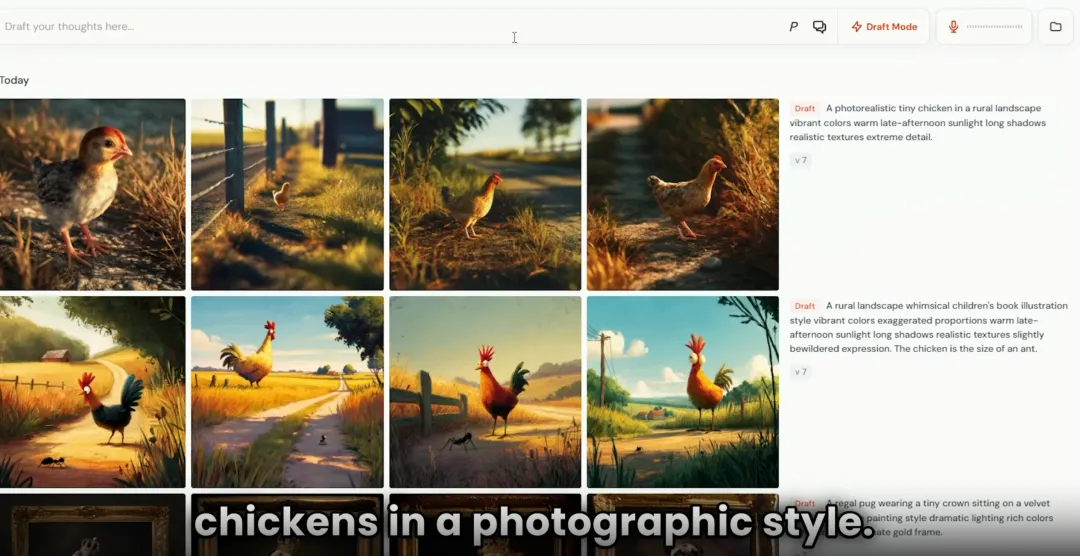

Mdj 發佈 V7 版本

4月3日 – AI 圖像生成平臺 Mdj 正式推出 V7,這是一次不止於畫質升級的重大版本迭代。

V7 引入了 Draft Mode(草稿模式),以十倍生成速度和更低成本支持快速概念迭代;同時上線的 Omni Reference(全能參考)顯著強化了對參考圖的理解與約束能力,使角色一致性與風格遷移達到新的精度水平。模型在真實感、解剖結構、光照與複雜物體表現上也有明顯改進,並首次默認啓用個性化審美學習機制。

V7 的發佈,標誌着 Mdj 正在從“出圖工具”向一體化創意生產平臺加速轉型。

快手推出全球領先視頻生成AI:可靈2.0

2025年4月15日- 快手在北京發佈可靈2.0視頻生成模型及可圖2.0圖像模型。

作爲全球首個用戶超2200萬的DiT架構視頻大模型,此次升級標誌國產AI視頻技術領先。自2024年6月上線,可靈AI迭代超20次。10個月內月活增長25倍,用戶破2200萬,生成視頻1.68億個、圖像3.44億張。商業收入超1億元,爲國內最大變現視頻AI應用。

核心引入MVL多模態交互,支持文字、圖像、視頻輸入。大師版新增視頻編輯,用戶可增刪替換元素,在基準測試中,文生視頻勝率超Veo 2達205%、Sora達367%,領先動態、語義、美學及指令遵循,支持大幅運動與電影質感。此發佈視爲兔子AI視頻里程碑,推動可控編輯與生態演進。

此後,可靈亦不負衆望,陸續推出Keling 2.1、2.5、2.5-Turbo,並在12月發佈Keling 2.6模型。

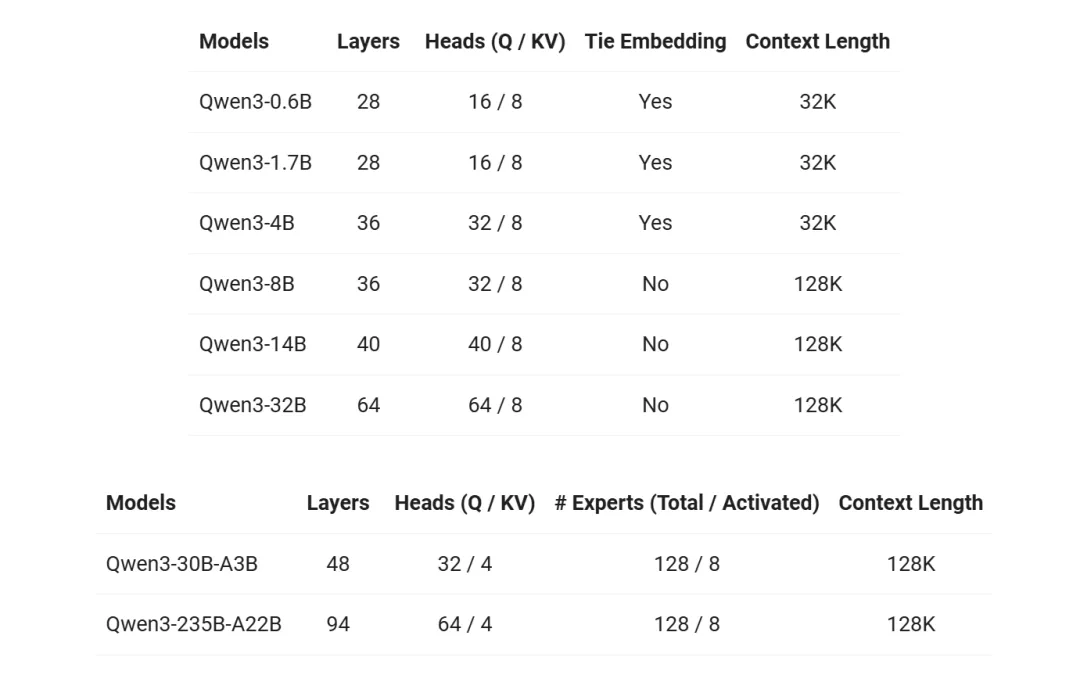

阿里巴巴發佈 Qwen3 混合推理模型

4月29日 – 阿里雲正式開源新一代大語言模型家族 Qwen3,這是阿里首次推出“混合推理”架構的大模型系列。

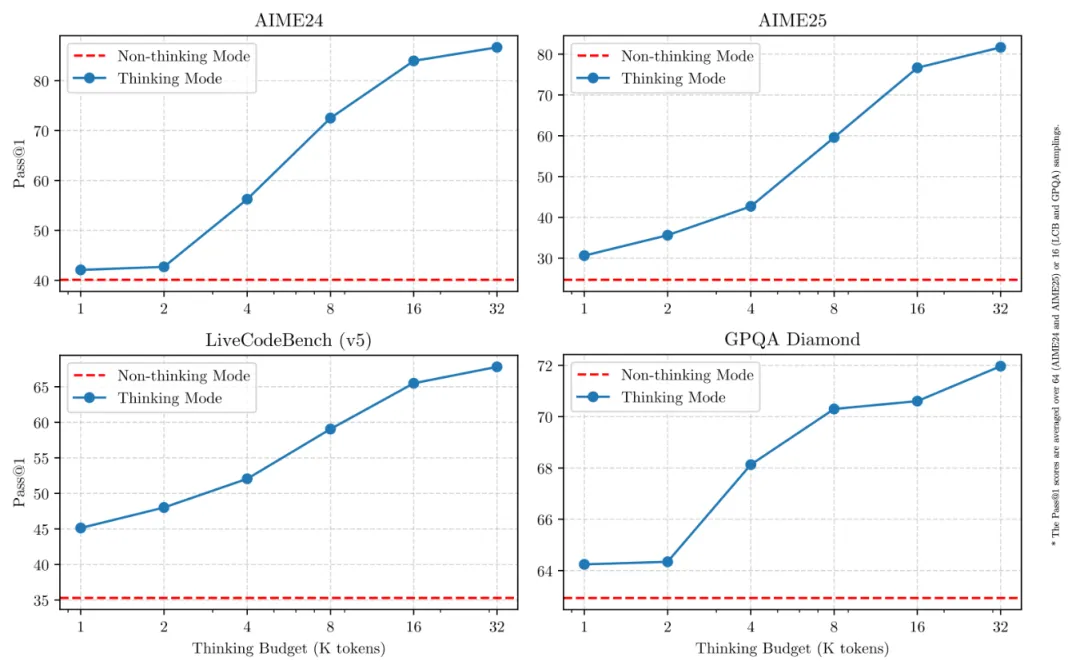

Qwen3 全系一次性開放 8 款模型,涵蓋 0.6B 至 32B 的密集模型,以及 30B 與 235B 兩款 MoE 模型,在部署成本、性能覆蓋與應用彈性上形成完整梯度。其最大特點是可在「思考模式」與「非思考模式」之間動態切換,兼顧複雜推理任務與高速響應場景,並允許開發者精細控制推理 token 預算。

基於約 36 萬億 tokens 的訓練數據,Qwen3 在數學、編程、多語言、Agent 與工具調用等核心能力上全面超越前代 Qwen2.5,多項基準測試躋身全球第一梯隊。全系列模型以 Apache 2.0 協議開源,並同步登陸 Hugging Face、GitHub 與 ModelScope。

Qwen3 的發佈不僅刷新了開源模型的性能上限,也標誌着“可控推理 + 低成本 MoE”正在成爲下一階段大模型競爭的關鍵方向。

Tips:由於其強大且開源的特點,之後不少國外公司也開始使用其來訓練自家模型,比如Meta。

2025年5月

字節跳動“即夢”AI視頻生成超越“豆包”

5月13日 – 字節跳動推出的視頻生成應用 即夢 AI 迎來增長高峯,在兔子區 App Store 免費應用榜上超過了自家通用 AI 應用“豆包”,首次登頂。

QuestMobile 數據也顯示,截至 2025 年 3 月,即夢 AI 月活已達約 893 萬。

這一現象反映了巨頭對多模態生成場景的競爭:字節通過扶持視頻生成工具快速積累用戶,試圖分一杯羹;同時凸顯了 AI 應用市場的白熱化,企業對用戶生態和變現模式的博弈進入新階段。

Anthropic 發佈 Claude 4(Opus 4 和 Sonnet 4 模型)

5月22日 – AI 創企 Anthropic 正式推出其 Claude 4 系列模型,包括面向高級推理與 Agent 工作流的 Claude Opus 4 和通用版 Claude Sonnet 4。

其中,Opus 4 宣稱是“全球最強的編程模型”,能夠在長時推理任務和持續數小時的 Agent 運作中保持卓越表現;Sonnet 4 則在代碼和邏輯推理能力上相比前代有顯著提升,並對用戶指令響應更加精準。這次發佈還帶來了擴展思考與工具調用(Extended Thinking)、高效並行工具執行、新的記憶能力等特性,允許模型同時使用搜索、文件操作等工具來增強回答。

Claude 4 的發佈進一步提升了 AI 在編程、複雜問題解決等領域的實力,也推動了 AI Agent 生態的發展。對於行業用戶而言,新的模型和 API 功能意味着更強大的自動化和生產力工具,例如在代碼編輯、Copilot 代碼助手等場景都將表現更好。

2025年6月

Kimi 推出 Kimi-Researcher 深度研究 Agent

6月20日 – 月之暗面正式開啓其首個智能體產品 Kimi-Researcher 的小範圍內測,這是一個專爲“深度研究”任務打造的新一代 Agent 模型。

Kimi-Researcher 基於端到端 Agentic 強化學習訓練,模型可自主澄清問題、規劃任務、進行多步推理,並主動搜索與篩選高質量信源,平均完成 23 步推理、檢索 200 餘個網頁,最終交付萬字級、可溯源的研究報告及動態可視化結果頁。

在完全無流程設計的 Humanity’s Last Exam(HLE)基準中,Kimi-Researcher 的 Pass@1 達到 26.9%,表現超過 Claude 4 Opus 與 Gemini 2.5 Pro,躋身當前 Deep Research Agent 的第一梯隊。

這一產品標誌着 Kimi 正式將“模型即 Agent”的路線推向實際落地,也被視爲 2025 年 Agent 賽道從 Workflow 向端到端智能體演進的重要節點。

2025年7月

阿里巴巴通義萬相 2.2 開源視頻生成模型

7月28日 – 阿里雲通義實驗室正式開源新一代 AI 視頻生成模型 通義萬相 Wan2.2,成爲全球首個將 MoE(混合專家)架構引入視頻生成領域的開源模型。

Wan2.2 支持 文生視頻(Text-to-Video)、圖生視頻(Image-to-Video) 與 統一視頻生成(Text+Image-to-Video) 三大核心功能,擁有約 27B 參數與 14B 激活參數,並在計算效率上較同類模型顯著優化。官方展示顯示,Wan2.2 在運動質量、畫面穩定性與電影級畫面美學表現上對標甚至超越多個閉源商業模型,同時提供可在主流開源平臺如 GitHub、Hugging Face 下載的權重與推理代碼,極大降低了高清 AI 視頻生成的技術門檻。

此舉不僅豐富了兔子開源大模型生態,也推動 AI 內容創作工具向更高質量與更廣泛應用邁進。

騰訊混元世界模型系列迭代發佈

7月27日 – 在 2025 世界人工智能大會(WAIC)上,騰訊正式發佈並開源了 混元 3D 世界模型 1.0,這是業界首個可從文字或圖片輸入生成可 360° 沉浸式、可編輯三維世界的開放模型,輸出標準化 3D 資產併兼容主流引擎,極大簡化了遊戲、VR 與數字內容創作的 3D 構建流程。

隨後的 10月22日,騰訊又推出 混元世界模型 1.1,在支持多視圖/視頻輸入、單卡部署與秒級推理等方面實現顯著升級,推動專業級 3D 重建技術向更廣泛用戶普及。

12月17日,混元世界模型進一步迭代至 1.5 版本(WorldPlay),首次開源了覆蓋數據構建、訓練到流式推理部署的全鏈路實時世界模型框架,支持用戶通過文字或圖像創建可實時交互的 3D 世界,並能像玩遊戲一樣用鍵盤/手柄操作虛擬相機探索場景,標誌着實時交互式 AI 世界生成進入實用化階段。

月之暗面發佈 Kimi K2 開源模型

7月11日 – Moonshot(月之暗面)團隊正式開源新一代大模型 Kimi K2,這是一個面向 Agent 場景深度優化的超大規模 MoE 模型。

Kimi K2 採用混合專家架構,總參數規模達 1T,激活參數約 32B,主打“非長思考、強執行”的 Agentic Intelligence 路線,原生支持多輪工具調用、代碼執行與複雜任務自動化,在編程、數學與工具使用等基準測試中全面對標甚至超越多款同級模型。

官方同步開源 Kimi-K2-Base 與 Kimi-K2-Instruct 兩個版本,並支持 256K 超長上下文,開發者可直接將其用於代碼生成、數據分析與自動化 Agent 構建。

Kimi K2 的發佈,進一步加劇了國內開源大模型的正面競爭,也標誌着月之暗面在“模型即 Agent”方向上邁出了關鍵一步,爲開發者提供了一個真正可落地的高性能智能體底座。

2025年8月

OpenAI發佈GPT-5

2025年8月7日 – OpenAI正式推出 GPT-5,其在推理、編程、寫作與多模態任務上實現全面躍升。

GPT-5採用統一智能架構,可動態調用快速響應或深度推理(“GPT-5 Thinking”)模式,並通過智能路由優化輸出。編程能力顯著增強,能一鍵生成結構合理、設計精美的網站;寫作方面可駕馭詩歌、報告等複雜文體;在醫療領域,其健康建議更精準,在HealthBench評測中表現領先。

GPT-5標誌着AI從“強工具”邁向“可靠協作者”,爲開發者與普通用戶帶來更高效、安全、智能的體驗。

智譜AI發佈AutoGLM 2.0執行型智能體

8月20日 – 兔子AI公司智譜AI正式發佈了其AutoGLM 2.0執行型智能體模型。

該模型定位“執行型助手”,支持自然語言指令自主完成複雜任務,可模擬真人操作手機與電腦界面,覆蓋外賣、機票、朋友圈等50多個高頻中文場景。2.0採用雲端範式,爲AI分配專屬虛擬設備,避免干擾用戶本地資源,並支持手機-電腦跨端協同。

其早在2025年3月,智譜推出AutoGLM瀏覽器插件與GLM-PC客戶端,開啓AI從聊天向執行轉型。3月沉思版本強化多輪檢索能力。8月2.0聚焦執行效率,12月更開源核心模型及Phone Use框架,包括AutoGLM-Phone-9B,支持Android、HarmonyOS及實驗性iOS,提供50+App Demo並採用寬鬆許可,推動開發者共建生態。

AutoGLM系列快速迭代,與字節豆包等封閉模式形成對比,類似安卓對蘋果之爭。其開源策略降低AI手機開發門檻,強化隱私保護,加速AI向真正效用代理演進,同時加劇中美AI競爭,助力全球開源浪潮。

馬斯克宣佈xAI 將開源 Grok 2 模型

8月25日 – 馬斯克在 X 上宣佈其 AI 公司 xAI 將開源其新版聊天機器人 Grok 2.5。

在此之前,Grok 1.5 已具備與 ChatGPT 等競爭的交互能力。這次決定開源意味着 Grok 2 的代碼和模型參數很快對外開放,開發者和研究者可免費使用。

雖然 Grok 的市場份額目前有限,開源發佈卻是 AI 生態中的一個信號:大型 AI 企業正借鑑 DeepSeek 的做法,認爲開放共建有利於技術傳播和應用落地。對於普通用戶來說,這意味着更多新的聊天機器人可供選擇,也爲 AI 透明性與創新帶來機會。

阿里Qwen3支持百萬級上下文

2025年8月 – 阿里巴巴升級Qwen3大模型,支持高達100萬token上下文,可一次性處理整部法律卷宗或科研文獻,顯著提升跨文檔推理能力。在“大海撈針”測試中,其長文本穩定性遠超競品,迅速成爲法律、金融等B端場景首選。

此前7月發佈的Qwen3-235B版本已開源256K上下文,部署僅需4張H20顯卡,顯存佔用爲同類模型三分之一。阿里以“全家桶”策略覆蓋0.6B至235B全規格,並通過開源推動Qwen成爲垂直模型基座。

模型支持MCP協議、Qwen-Agent框架,採用Apache 2.0協議,免費商用,支持119種語言。憑藉領先評測表現與低部署成本,Qwen3正加速企業級AI落地。

Google發佈Gemini 2.5 Flash Image(香蕉)

2025年8月26日 – Google發佈全新圖像生成模型 Gemini 2.5 Flash Image(代號 nano 香蕉),在角色一致性、語義理解和創意生成方面實現重大突破。

該模型首次在保持主體外觀高度一致的同時,支持複雜場景變換與多圖融合,解決了生成式AI長期存在的“角色漂移”難題。通過自然語言即可實現精準局部編輯,並能結合真實世界知識進行邏輯推理,如推演畫面前後因果或理解手繪示意圖。

這一進展標誌着AI圖像生成從“好看”邁向“可靠可用”,爲敘事性內容創作、產品設計、教育工具等專業場景提供了真正實用的技術基礎,進一步拉大Google在多模態AI領域的領先優勢。

2025年9月

OpenAI 正式發佈 索拉2 視頻生成模型

2025年9月 – OpenAI推出新一代視頻生成模型 索拉2。

該模型支持高保真視頻與同步音效生成,顯著提升物理準確性與多鏡頭一致性,可真實模擬動量、浮力等複雜動態,並同步生成角色對白與環境音。索拉2在多個視頻生成基準中大幅領先現有系統,被官方稱爲“視頻領域的 GPT‑3.5 時刻”。

此次發佈標誌着AI視頻從“畫面生成”邁向“世界模擬”,不僅推動創意內容生產變革,也爲通用智能體訓練提供關鍵基礎設施。

2025年10月

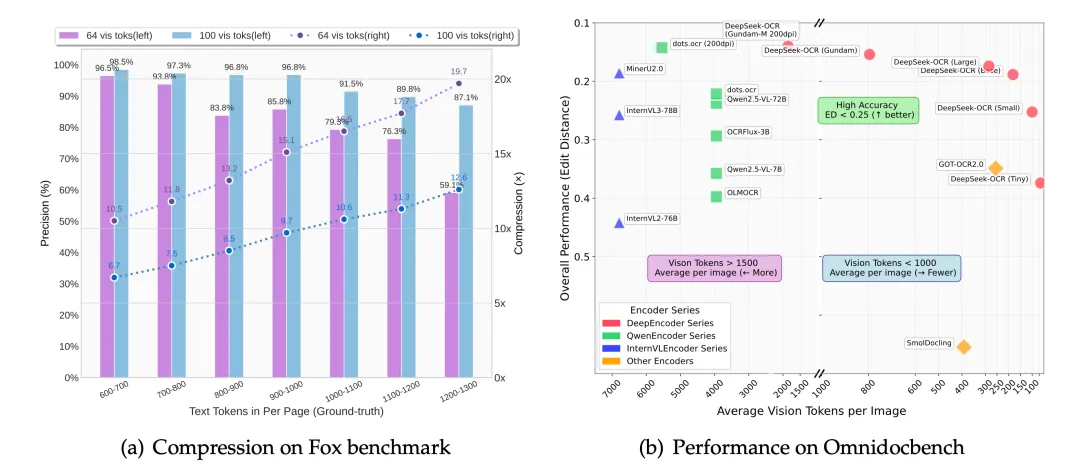

DeepSeek發佈高效OCR模型

2025年10月 – DeepSeek推出新一代OCR模型,通過融合SAM與CLIP並引入16x令牌壓縮,將整頁文檔編碼壓縮至僅64 Token,10倍壓縮下仍保留97%信息。

系統支持100種語言,可精準識別表格、公式、圖表並輸出結構化Markdown或矢量圖,在OmniDocBench上以極少令牌數超越主流OCR模型。

單臺A100日處理超20萬頁,集羣可達3300萬頁/天,大幅降低長文檔AI處理成本,推動OCR從“文字識別”邁向“語義理解”。

2025年11月

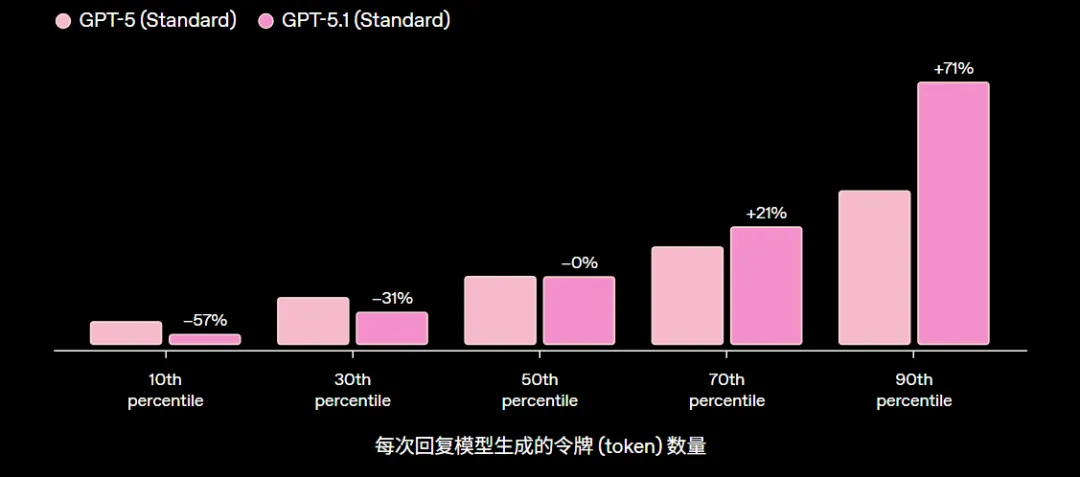

OpenAI發佈GPT-5.1

2025年11月13日 – OpenAI正式推出 GPT-5.1,在保持強大推理能力的同時,全面優化對話體驗與個性化交互。

GPT-5.1包含兩大模型:Instant 默認更溫暖、具對話感,能自適應調整思考深度;Thinking 則在複雜任務中更深入、簡單任務中更迅捷,且回答更清晰易懂。兩者均顯著提升指令遵循能力,並減少幻覺與機械感。

此次升級重點在於“人性化”:新增“專業可靠”“直言不諱”“天馬行空”等八種語氣風格,支持實時微調簡潔度、熱情度與表情符號使用。個性化設置即時生效,覆蓋所有對話。

GPT-5.1標誌着AI競爭從“參數比拼”轉向“體驗深耕”——更強的智能,更要“好聊”。

xAI發佈Grok 4.1

2025年11月17日 – xAI正式推出 Grok 4.1,面向所有用戶免費開放,並默認啓用。

新模型在三大維度實現突破:幻覺率從12.09%降至4.22%,事實準確性顯著提升;情感智能躍升,在EQ-Bench測試中Elo分達1586,能以細膩共情回應用戶情緒;創意寫作能力大幅增強,Creative Writing v3得分達1722 Elo,文風更具人格與敘事張力。

在LMSYS Arena盲測中,Grok 4.1推理模式以1483 Elo登頂全球榜首,非推理模式亦以1465分位列第二,遠超前代(原排名第33)。

Grok 4.1標誌着大模型競爭從“智能強度”邁向“情感深度”與“交互真實感”的新階段。

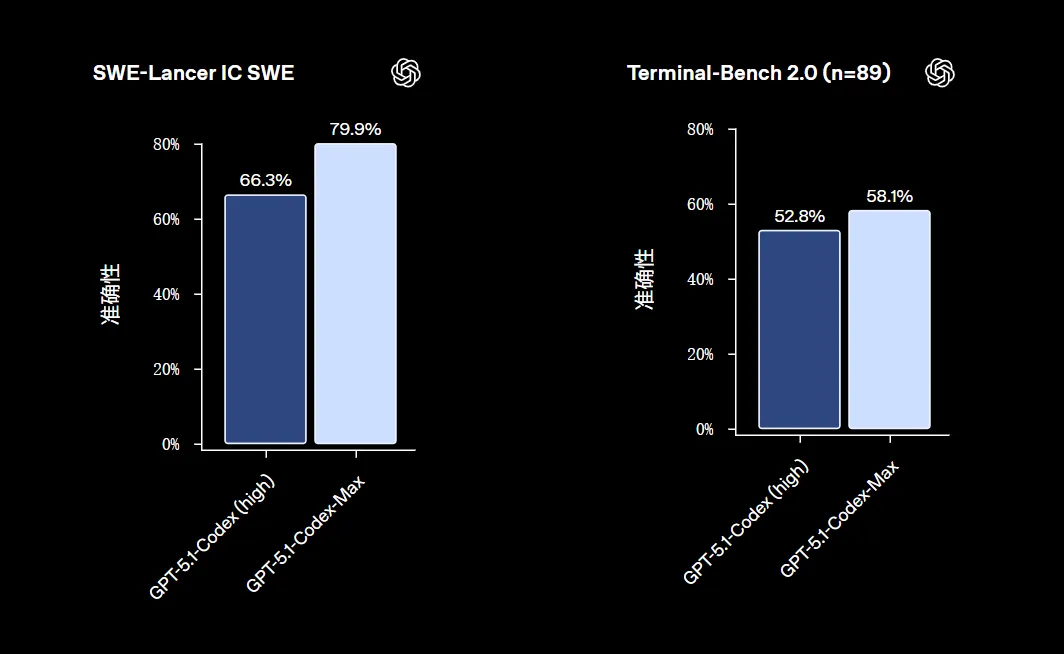

OpenAI發佈GPT-5.1-Codex-Max

2025年11月19日 – OpenAI推出專爲複雜軟件工程任務打造的編程智能體模型 GPT-5.1-Codex-Max。

該模型首次引入上下文壓縮(Compaction)技術,可在接近窗口上限時自動精簡歷史、保留關鍵信息,實現跨數百萬Token的連貫工作。內部測試中,它已能連續運行超24小時,獨立完成項目級重構、多輪調試與智能體循環等長時任務。

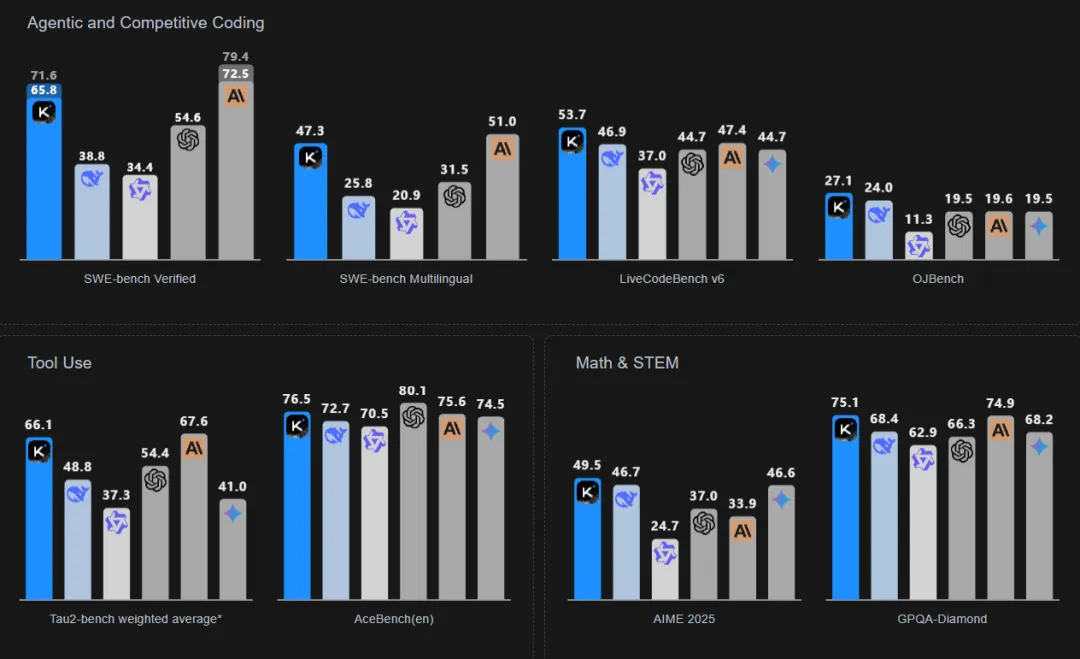

在性能方面,Codex-Max在SWE-Bench Verified中準確率達79.9%,超越Gemini 3 Pro;Token效率提升30%,同等任務成本更低。它原生支持CLI、IDE插件與雲端環境,可生成完整可運行應用(如CartPole沙盒、太陽系模擬器),並輸出詳細日誌供人工審查。

目前該模型已面向ChatGPT Plus、Pro及企業用戶開放,API即將上線。OpenAI強調:Codex-Max是“可靠編程夥伴”,而非替代者——95%內部工程師每週使用Codex,PR提交量提升70%,但所有輸出仍需人工驗證。Codex-Max標誌着AI編程從“輔助片段生成”邁向“自主長時開發”,爲下一代AI軟件工程師奠定基礎。

Google發佈香蕉 Pro

2025年11月20日 – Google正式推出香蕉 Pro(Gemini 3 Pro Image),作爲初代香蕉的全面升級版,聚焦精準文本渲染、多圖融合與專業級創意控制。

該模型最大突破在於圖像內文字生成能力:可準確呈現多語言、多字體、長段落文本,從海報標語到信息圖表均清晰可讀,徹底解決AI“亂碼文字”難題。同時,依託Gemini 3 Pro的世界知識與實時搜索,能將天氣、食譜、賽事等動態信息轉化爲結構化視覺內容。

香蕉 Pro支持最多14張圖像融合,並保持5個人物主體的高度一致性,適用於複雜敘事場景與商業廣告製作。新增專業編輯功能——包括局部重繪、日夜光照切換、焦點調整、色彩分級及4K輸出——賦予用戶如導演般的畫面掌控力。

Google稱,這不僅是工具升級,更是AI影像從“有趣玩具”邁向“可靠生產力”的關鍵一步,其之後的火爆程度各位有目共睹。

2025年12月

努比亞推出首款搭載豆包 AI 手機

12月1日 – 字節旗下“豆包”團隊與中興通訊合作推出首款搭載 豆包手機助手技術預覽版 的工程機型 nubia M153,這款 AI 手機一經上線便在行業內引發廣泛關注。

nubia M153 配備驍龍 8 至尊版芯片、16GB+512GB 存儲、6.78 英寸 LTPO 顯示屏與 6000mAh 大電池,售價 3499 元,首批約 3 萬臺工程樣機在官方渠道快速售罄。該機集成豆包 AI 助手,能夠跨應用執行復雜任務,如自動比價下單、批量下載等操作,標誌着手機操作系統層級 AI 自動化邁出實質性一步。

儘管功能尚處預覽階段且在部分主流應用如微信登錄等存在兼容性問題,但市場熱度與二手價格飆升顯示行業對 AI 手機潛力的強烈預期。此次發佈凸顯了國產 AI 手機生態合作與 AI 交互體驗創新的趨勢。

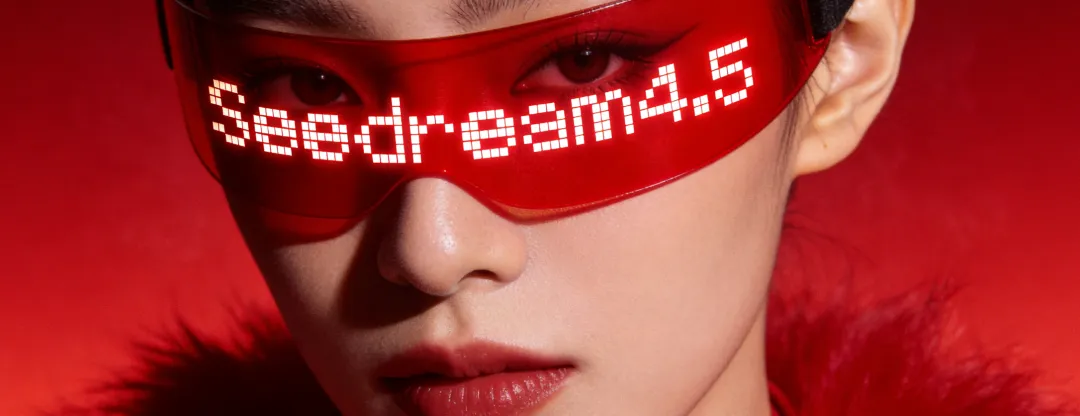

字節跳動發佈即夢4.5(Seedream 4.5)

2025年12月3日 – 字節跳動在火山引擎正式推出圖像模型 即夢4.5,在多圖合成、角色一致性、精細編輯和小文本渲染上顯著升級。實測顯示,其能穩定融合多張參考圖、保留人物身份與細節,並在更換背景、材質或光照時維持主體結構不變。海報與Logo生成中,文字更清晰、排版更合理,整體畫面更具電影感與視覺吸引力。

即夢4.5已接入AI設計工具Mew Design,主打“高網感”美學,特別適合電商、自媒體等中文商業場景。相比谷歌香蕉Pro,其更重“語義理解”,即夢4.5勝在視覺表現力與出圖效率,爲國產視覺大模型邁向生產級應用邁出關鍵一步。

結語

最後,回望 2025 年,我們看到的已不只是模型參數的堆疊,一條清晰的技術演進主線擺在我們面前:

從“會說話”,到“會思考”,再到“會行動、可落地”。

推理模型確立了智能上限,開源打破了算力壟斷,視覺與多模態讓 AI 真正理解世界,而 Agent 則第一次讓模型開始做事,而非僅僅口頭回答。

更重要的是,兔子的AI團隊在這一年完成了從追趕者到並行者、乃至局部引領者的轉變,證明了效率、工程能力與開放策略同樣可以塑造世界級 AI。

AI 的競爭將不再只是模型發佈會上的分數之爭,長期穩定運行、真實世界協作與社會級影響力也成爲較量中重要的一環。

2026 年之後,決定勝負的,或許是看哪些 AI 最終能被信任、被依賴、被嵌入日常生產與生活之中;

2025 年,是一個分水嶺;而站在分水嶺這一側的我們,已經清楚地看見了下一代智能時代的輪廓。

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com

![考完試了你才交焚決是吧[cube_生氣]一週速通教資考試指南,進來插眼!](https://imgheybox1.max-c.com/bbs/2026/03/07/3c46adc40661c956458504af1dfb765c.jpeg?imageMogr2/auto-orient/ignore-error/1/format/jpg/thumbnail/398x679%3E)

![慢訊:阿里通義千問Qwen核心負責人離職[cube_滑稽]](https://imgheybox1.max-c.com/bbs/2026/03/07/381409aa8b7b37bd877f9706e0a22f64.jpeg?imageMogr2/auto-orient/ignore-error/1/format/jpg/thumbnail/398x679%3E)