前言

一月初因爲註冊送500萬token我第一次去了解了一下這個國產大模型,當時api放chatbox裏用了一下我就把這個放那不管了,當時用上去完全沒有GPT好用

現在deepseek熱度太高了,網上相似的文章也有一些,但是每個人都有每個人的特色,多我一個也不算多

正文

安裝ollama

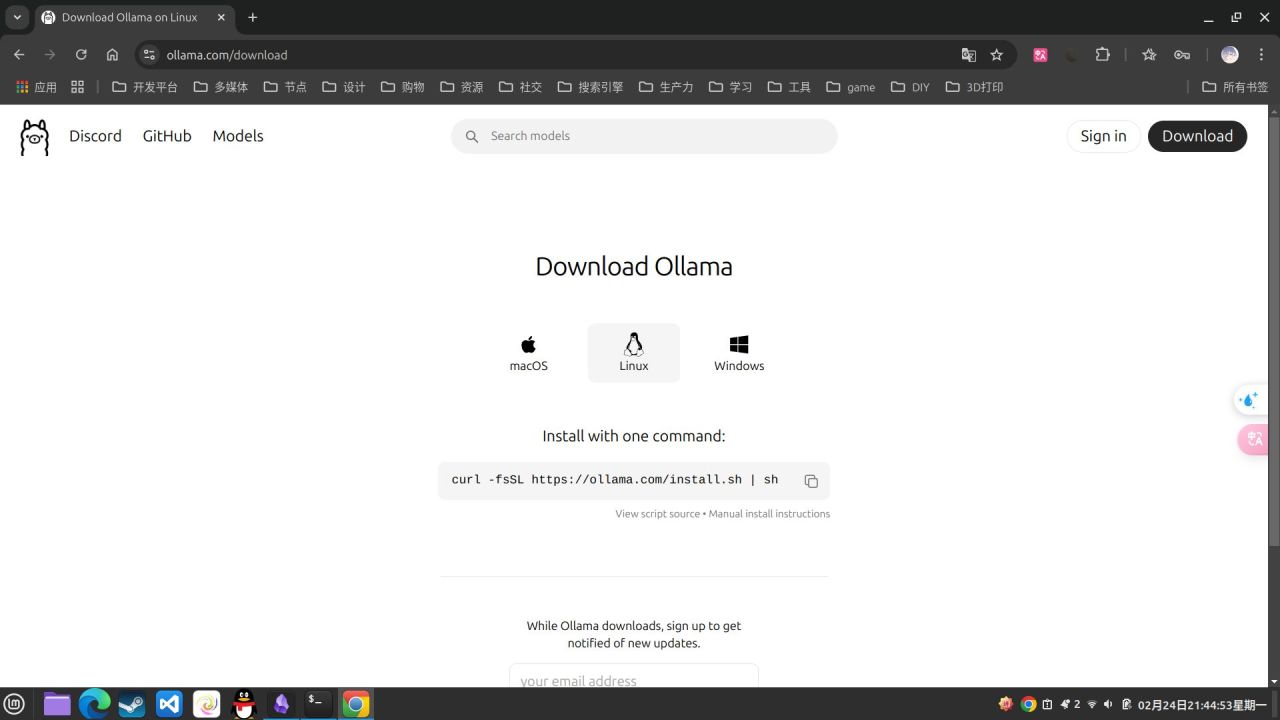

首先我們進入ollama的官網

ollama點com

這裏可以選擇不同的系統安裝,我這裏是Linux mint所以直接選擇Linux

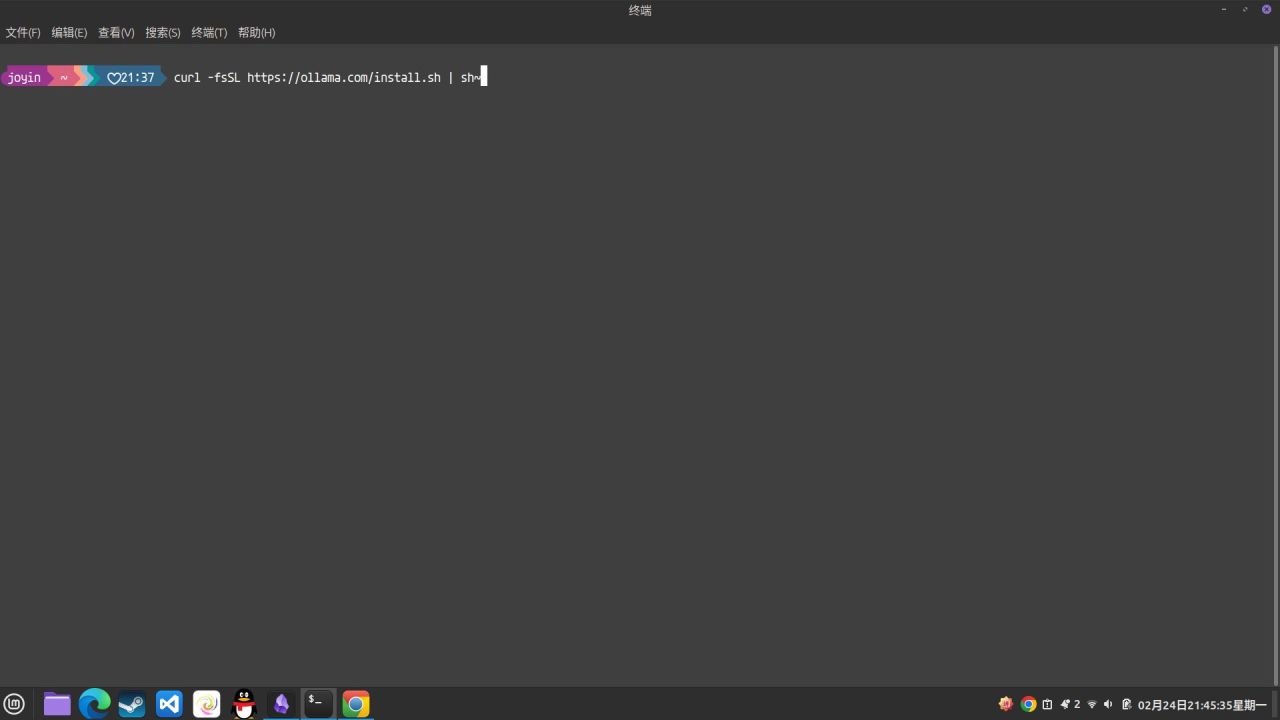

這裏給我們了一行安裝命令,我們直接複製到終端打開

curl -fsSL https://ollama.com/install.sh | sh

等進度條結束後就是安裝成功了

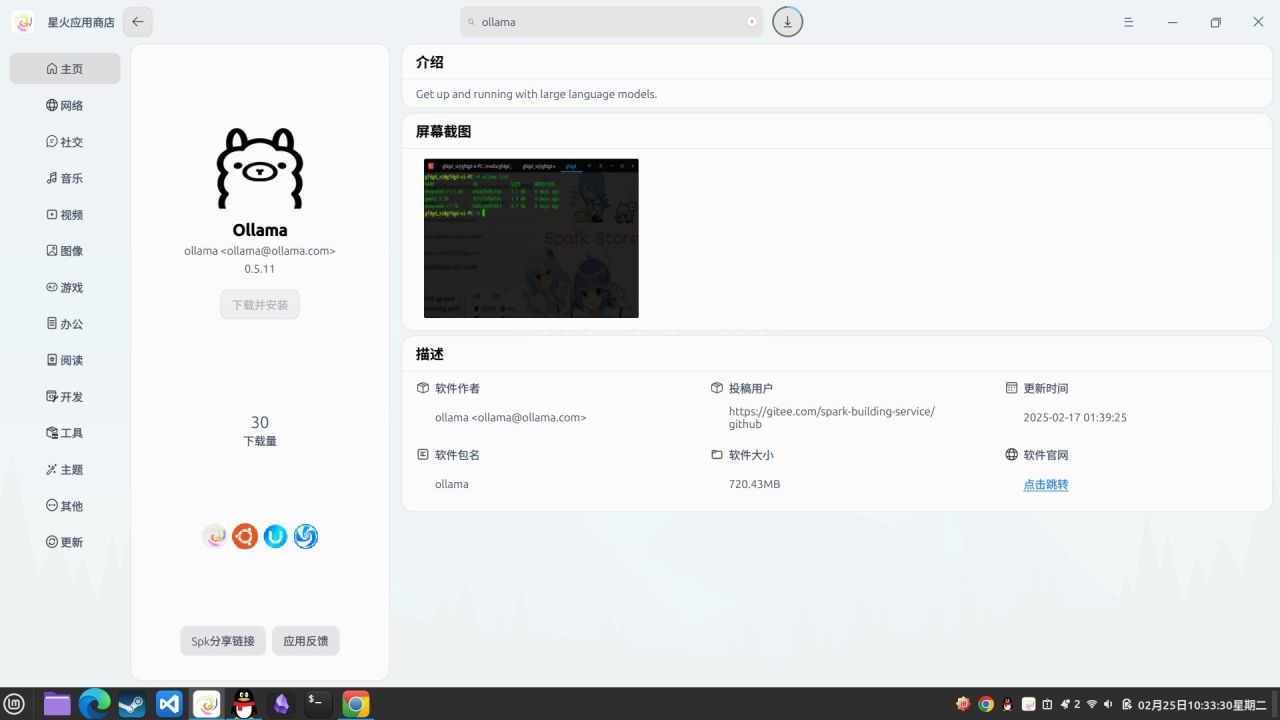

當然,這種方法安裝速度是比較慢的,有一種快速的方法就是直接去星火應用商店下載!

Windows的話直接下載exe文件雙擊安裝就可以了(注意,Windows下ollama默認安裝到C盤)

安裝完成之後會自動創建環境變量,大家可以去終端輸入ollama -v試一下能彈出版本號就是安裝成功了

## 部署deepseek r1

安裝完ollama之後對於deepseek的部署我們直接去ollama官網去複製命令到終端執行就可以了

我直接放在下面幾個,大家直接複製就行

DeepSeek-R1-Distill-Qwen-1.5B

ollama run deepseek-r1:1.5b

DeepSeek-R1-Distill-Qwen-7B

ollama run deepseek-r1:7b

DeepSeek-R1-Distill-Llama-8B

ollama run deepseek-r1:8b

DeepSeek-R1-Distill-Qwen-14B

ollama run deepseek-r1:14b

配置vscode

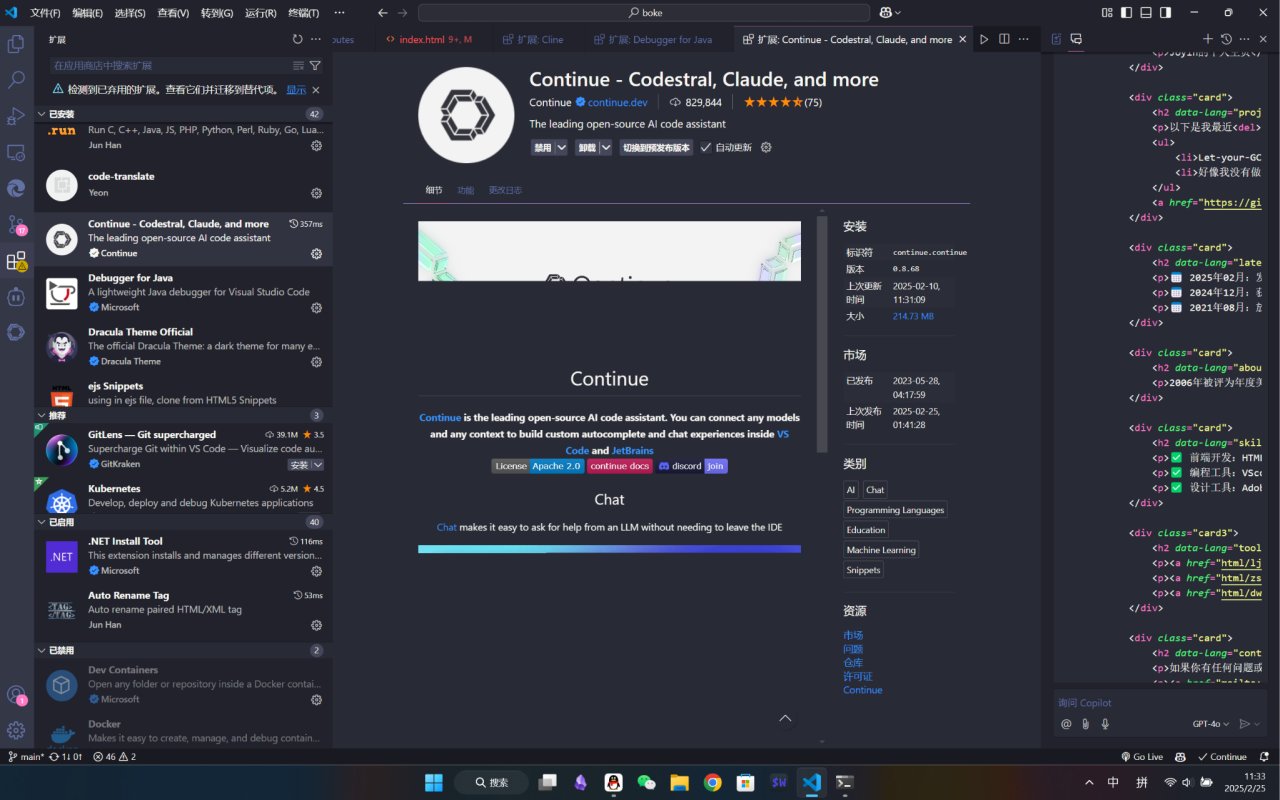

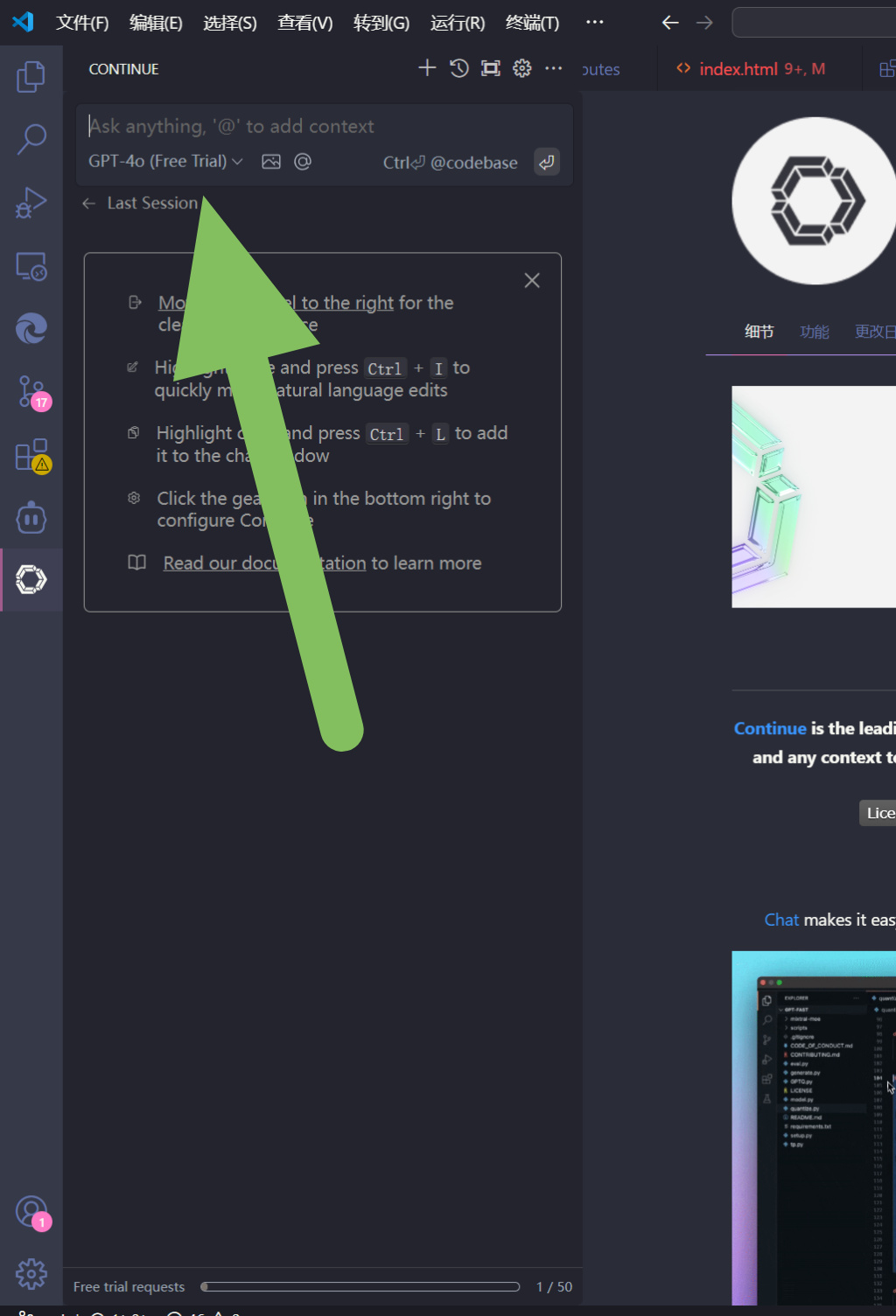

打開vscode我們去安裝拓展

然後點擊這裏!

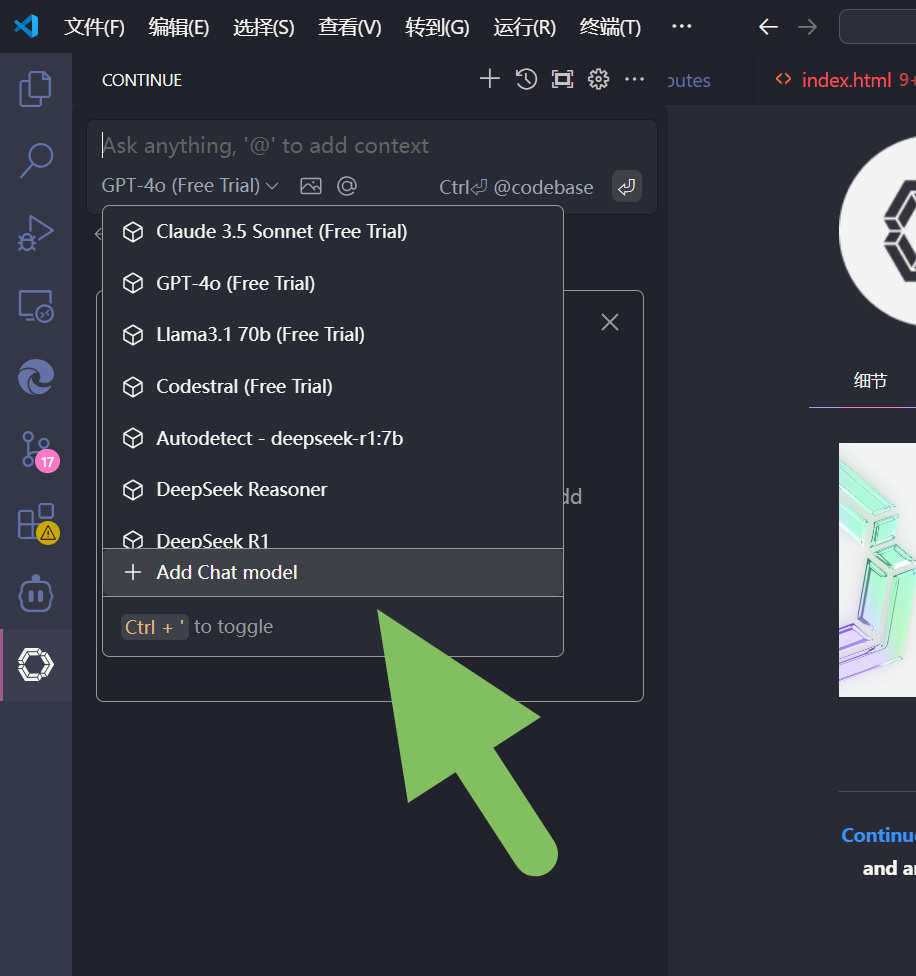

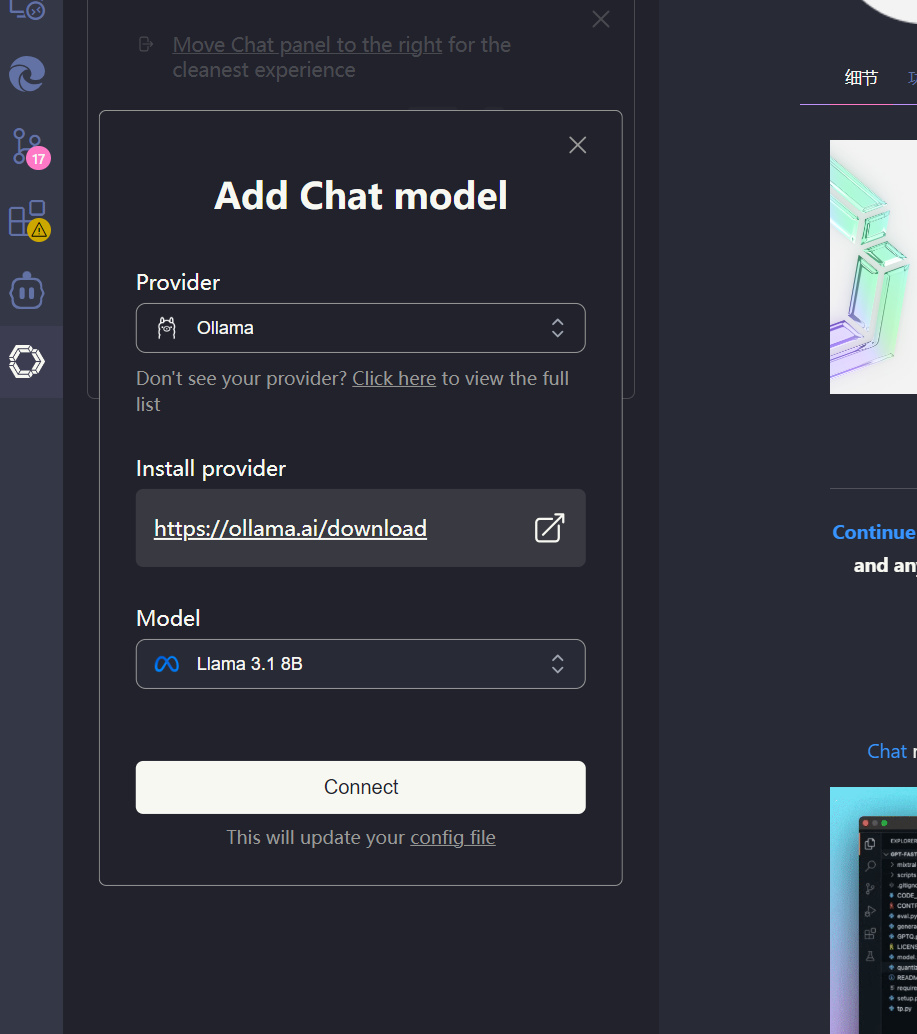

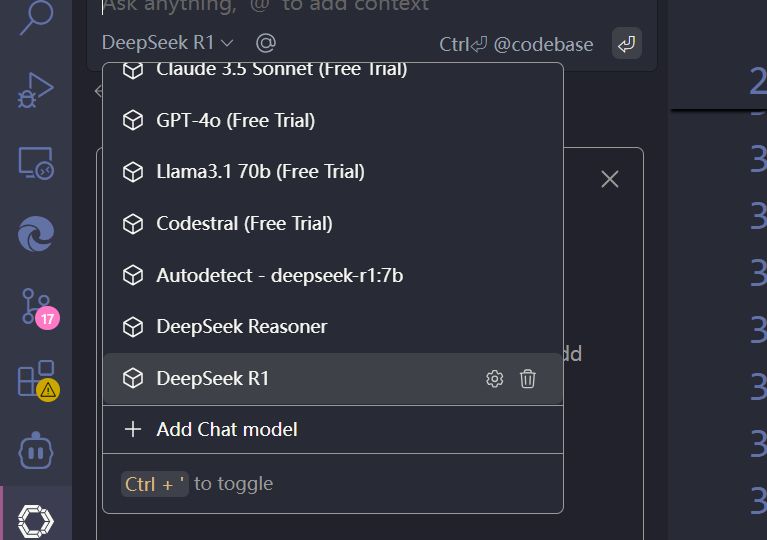

在這裏Provider我們選擇ollama,但是model裏面沒有deepseek R1所以我們這裏隨便選擇就可以了

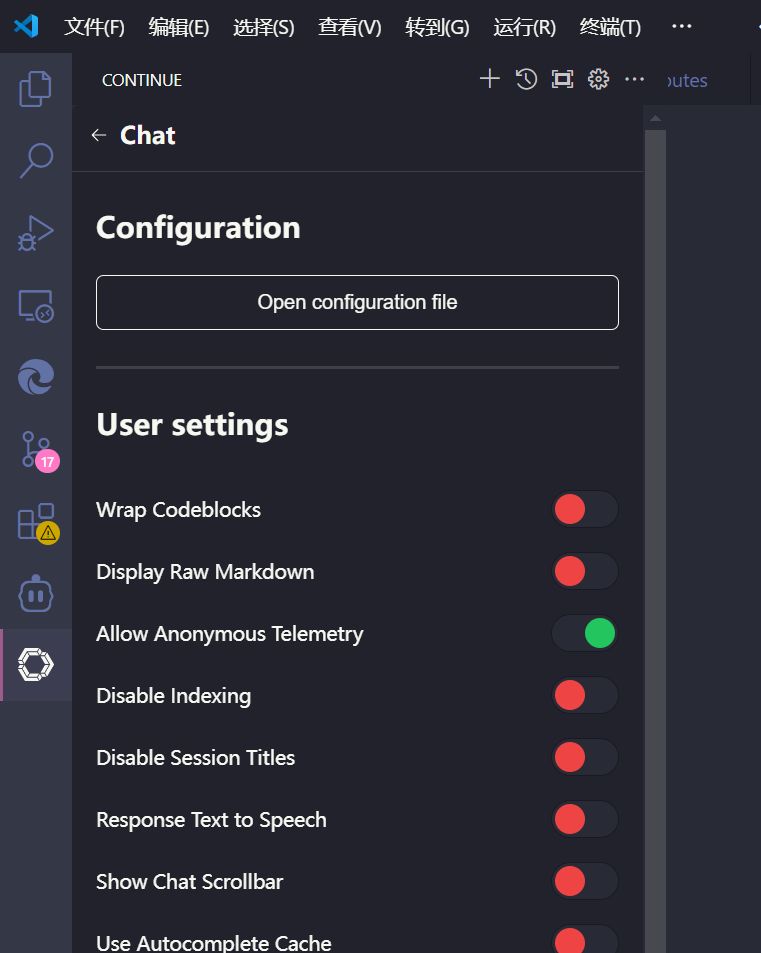

點擊connect,回到主頁點擊右上角的齒輪來到下面的頁面

點擊Open configuration file打開config.json文件,在這裏找到我們剛剛添加的ollama,自己改成自己的大模型

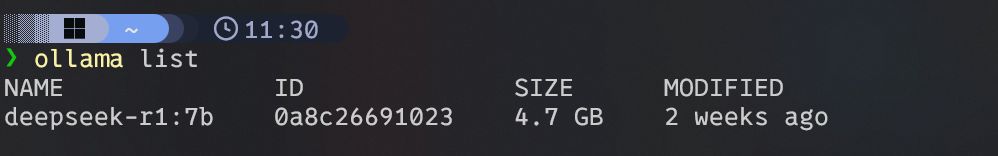

如果忘記了自己的大模型名字的去終端裏面執行一下

ollama list

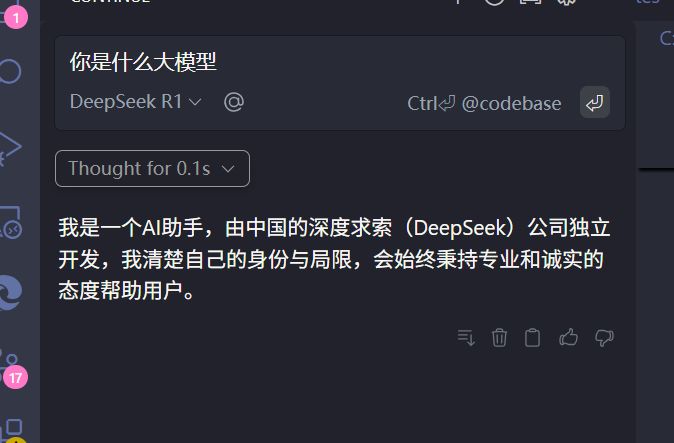

然後回到主頁就可以用deepseek R1了

✌︎' ֊'

接下來我們測試一下(๑⃙⃘´༥`๑⃙⃘) 𐂐

Okay!

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com