在人工智能競爭日益激烈的今天,DeepSeek 以突破性的算法優化震驚了整個AI行業!他們使用 2,048張NVIDIA H800 GPU,僅耗時兩個月,就成功訓練出了擁有6710億參數的混合專家(MoE)大模型,整體效率比AI巨頭Meta高出10倍!💥

那麼,DeepSeek是如何做到的?他們並沒有依賴NVIDIA的CUDA編程,而是直接使用了更底層的PTX(並行線程執行)架構,這一技術讓DeepSeek在算力利用率上取得了跨越式突破。🔬✨

繞開CUDA限制,DeepSeek如何用PTX“榨乾”H800 GPU的潛能?

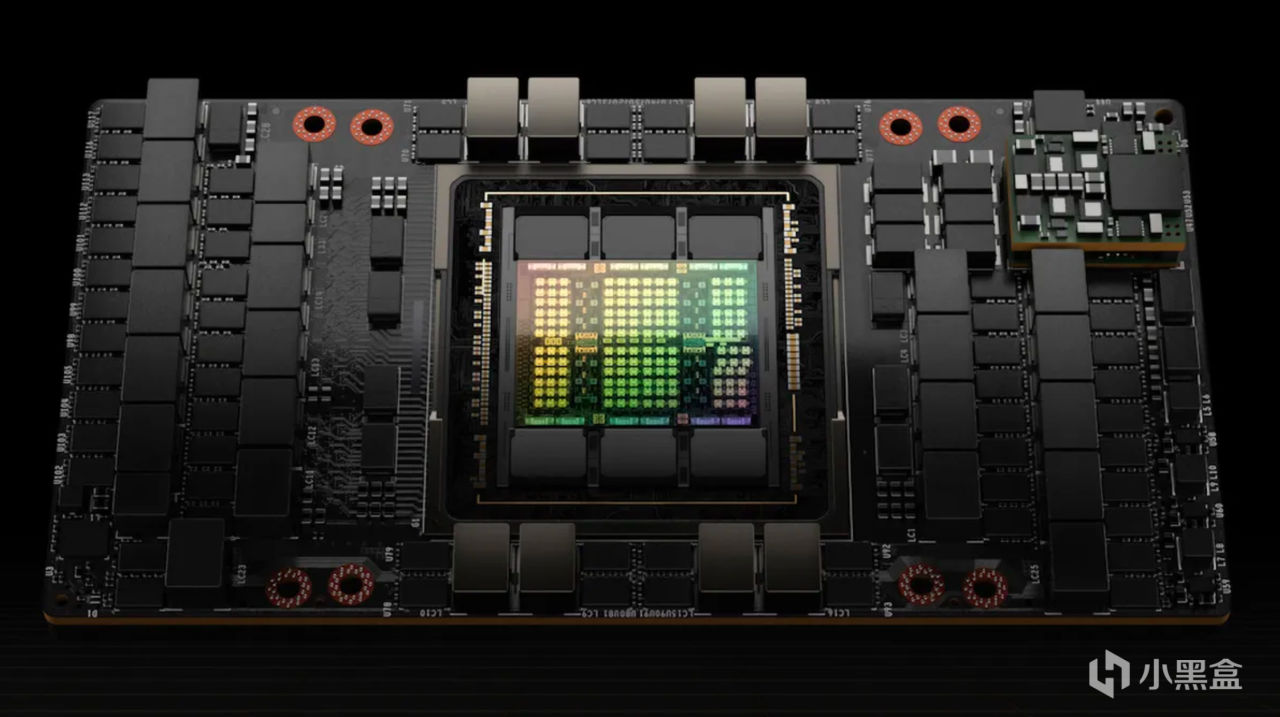

NVIDIA的PTX(Parallel Thread Execution) 是一種比CUDA更底層的“彙編式”指令架構,它介於高級GPU編程語言(如CUDA C++)和真正的底層機器碼(SASS流式彙編)之間。PTX的最大優勢在於:

✅ 更接近硬件底層,讓GPU變成純粹的數據並行計算設備,比CUDA能更細粒度地調整寄存器分配、線程/warp級別調度。

✅ 直接優化SASS代碼,針對不同架構的NVIDIA GPU進行深度優化,使計算更高效。

✅ 繞開CUDA封裝的限制,開發者可以直接操控GPU資源,提高計算吞吐量,降低能耗和硬件成本。

DeepSeek的技術突破:少用硬件,多榨乾性能💡

爲了在全球高端GPU短缺的大背景下取得更高效能,DeepSeek在H800 GPU的架構上做出了驚人優化:

🔹 動態調整流處理器(SM)分配:在H800的132個流處理器(SM)中,DeepSeek專門劃分出20個用於服務器間通信,這可能涉及數據壓縮/解壓,以克服帶寬瓶頸並加快訓練效率。

🔹 Warp級別調優算法:DeepSeek在GPU的線程管理上做了超精細優化,可能通過高級流水線算法,提高任務調度和計算吞吐率,讓每一個GPU核心都發揮最大性能。

這些優化方案遠超CUDA開發的傳統方式,屬於極端精細的底層優化,這也凸顯了DeepSeek工程團隊的卓越實力!💪🇨🇳

DeepSeek帶來的市場震盪,AI硬件需求真的會降低嗎?

DeepSeek的這一技術突破讓許多投資者開始重新評估AI硬件的需求,甚至有人擔憂未來高性能AI芯片的市場需求會下降,影響NVIDIA等廠商的收入。🤔📉

然而,業界資深人士(如前Intel CEO Pat Gelsinger)認爲,AI應用場景無上限,AI會吞噬它所能獲取的一切計算能力,DeepSeek的突破並不會減少對高性能硬件的需求,反而可能讓AI技術進入更大規模的商用市場,使更多設備能夠運行高效AI模型。

無論如何,DeepSeek的成功證明了一件事:頂級工程師+創新優化=少花錢,多辦事!🔥 在未來,或許我們可以看到更多國產AI企業突破算力瓶頸,用更高效的方式,讓AI技術賦能世界!🌏🚀

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com