4月的 GitHub Trending 月榜数据来了,有点神仙打架的意思。

19 个项目一共获得了 46.7 万 Star。榜单里面 andrej-karpathy-skills 凭借一个CLAUDE.md 文件获得了 8.9 万 Star 。Hermes Agent 本月增长了 10.8 万 Star,总 Star 数已经突破 12.4 万。microsoft/markitdown 本月增长了 2.6 万,claude-mem 本月增长了 2.8 万,rtk 本月增长了 2.3 万……。

榜单的19个项目中,至少有10个都是为 AI 编程助手(Claude Code / Codex / Cursor 等等)服务的。整个软件开发范式已经发生了变化。

今天把排行榜按AI 编程助手增强、Agent 基础设施三组、专业领域 / 实用工具这三个类型展开聊聊。

AI 编程助手增强

AI 编程助手增强这类项目都在做同一件事情——让 AI 编程助手更好用。

[andrej-karpathy-skills](https://github.com/forrestchang/andrej-karpathy-skills) — 98,136 Stars / 月增 88,829

一个 CLAUDE.md 文件,Karpathy 将他对LLM 编程的经验,提炼成四条最佳实践原则。

Karpathy 原话:

"模型会代你做错误假设,然后不假思索地执行。它们不管理自身的困惑,不寻求澄清,不呈现矛盾,不展示权衡,在应该提出异议时也不反驳。"

"它们真的很喜欢把代码和 API 搞复杂,堆砌抽象概念,不清理死代码……明明 100 行能搞定的事情,非要实现成 1000 行的臃肿架构。"

"它们有时仍会改动或删除自己理解不足的代码和注释,即使这些内容与任务本身无关。"

这个CLAUDE.md增加了四个原则:

编码前思考。不要假设。不要隐藏困惑,困惑时停下来,适时提出异议。

简洁优先。用最少的代码解决问题,不要过度推测。

精准修改。只碰必须碰的。只清理自己造成的混乱。

目标驱动执行。定义成功标准,循环验证直到达成。

[claude-mem](https://github.com/thedotmack/claude-mem) — 69,494 Stars / TypeScript / 月增 27,718

Claude Code 的长期记忆插件。通过捕获 Claude 在编码过程中完成有操作,用 AI 压缩,然后在后续编码会话时注入给 Claude 上下文。

核心流程:

**捕获**:利用 Claude Code 的 Hook 机制(SessionStart / PostToolUse / Stop),记录每次工具调用的输入、输出,并写入本地 SQLite 队列。

**压缩**:后台 Worker 会将原始记录喂给一个 AI 观察者(基于 Anthropic Agent SDK,同时支持 Gemini / OpenRouter),将每个工具调用提炼为一张结构化的"观察卡片":包含类型(bugfix/feature/decision)、摘要、关键事实、涉及到的文件等。原始输出可能几千 token,经过压缩仅剩 50-100 token。

**注入**:下次新开会话时,从 SQLite + Chroma 向量库中检索相关记忆,自动注入到上下文里。Claude 立刻知道之前改过什么、为什么这么改。

有一个设计细节值得注意:渐进式披露。claude-mem 不会把所有记忆一股脑塞进上下文窗口。它分两层——大多数记忆只注入标题和类型(约 15-25 token),只有最近几条才展开完整内容。需要深入查看时,通过内置的 mem-search 技能按需检索,也是三步走:先搜索返回紧凑索引,再用 timeline 查看上下文,最后按 ID 批量拉取完整记录。整个设计都在控制 token 消耗。

月增 2.8 万 Star,在已知的所有 Claude Code 插件中仅次于 Karpathy Skills。

[claude-howto](https://github.com/luongnv89/claude-howto) — 30,197 Stars / Python / 月增 26,211

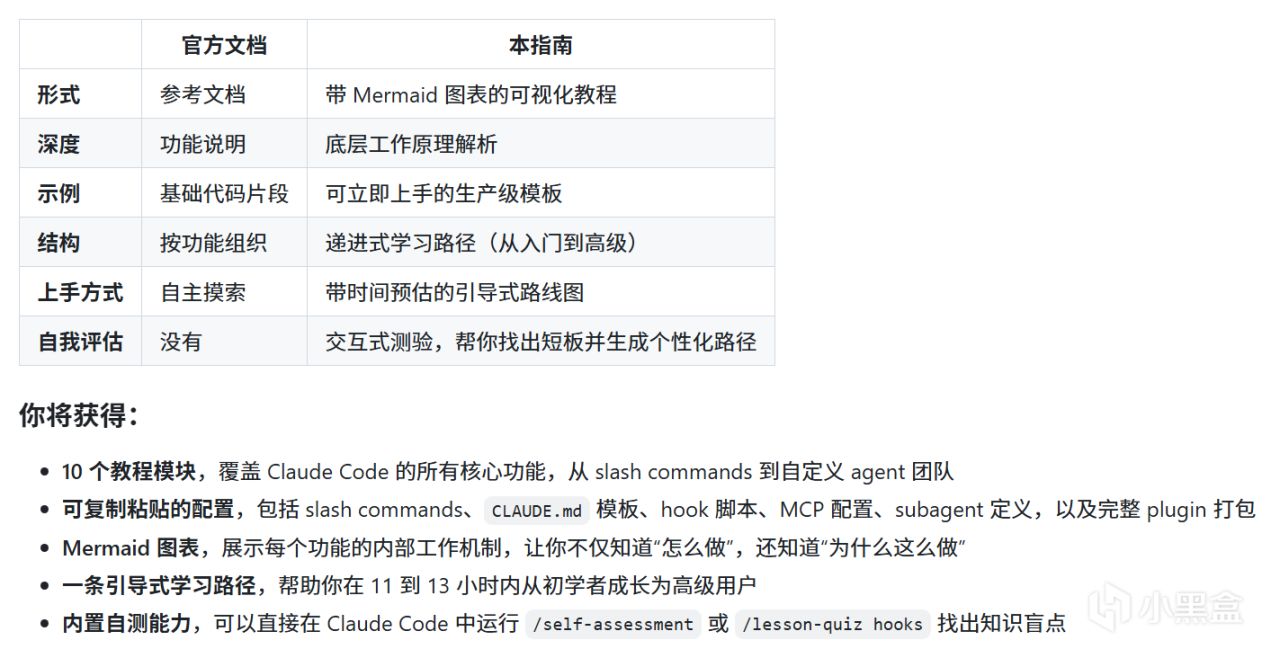

一份"周末入门 Claude Code"的教程文档。从输入 claude,一路教你编排 Agent、Hook、Skill、MCP Server,全程有图有代码的实操教程。

Claude Code官方文档会介绍功能,但不会告诉你如何把它们组合起来,感觉就是一个一个的碎片化文档。而且没有清晰的学习路径,实例也非常清楚。

Claude How To不是另一份功能参考手册,而是一份结构化、可视化、以示例驱动的指南。它会教你如何使用 Claude Code 的每一项功能,并提供今天就能复制到项目里的真实场景模板。

月增 2.6 万 Star,说明市场上关于"Claude Code 入门教程"还是比较欠缺。

[free-claude-code](https://github.com/Alishahryar1/free-claude-code) — 18,019 Stars / Python / 月增 15,944

一个代理服务器,将 Claude Code 的 API 请求路由到 NVIDIA NIM、OpenRouter、DeepSeek、LM Studio、llama.cpp、Ollama——六个完全免费或低成本的模型提供商之一。

[oh-my-codex](https://github.com/Yeachan-Heo/oh-my-codex) — 26,752 Stars / TypeScript / 月增 23,981

一个跑在 OpenAI Codex CLI 之上的多智能体编排框架。Codex CLI 本身是个命令执行器,oh-my-codex 在上面包了一整套结构化工作流:澄清需求 → 共识规划 → 执行验证,每一步都有明确的状态机和门控条件。

四个内置 Skill 各管一段:

**$deep-interview**:苏格拉底式需求澄清。用数学公式算"歧义分数",不到阈值不进入规划阶段。支持三种深度(quick / standard / deep),最多 20 轮追问。

**$ralplan**:三角色共识规划。规划师出方案,架构师给"最强反题",评审员审查通过后才允许执行。最多迭代 5 轮,确保计划经得起质疑。

**$ralph**:持久化执行循环。迭代实现、跑测试、验证通过,最后强制跑一轮 `ai-slop-cleaner` 清理冗余代码,才标记完成。最多 10 轮,不验证过不了。

**$team**:当工作量足够大时进行协调并行执行。

所有状态持久化在项目的 .omx/ 目录里——面试记录、规划文档、执行进度、团队通信——会话断了可以恢复。

和gstack有点像。

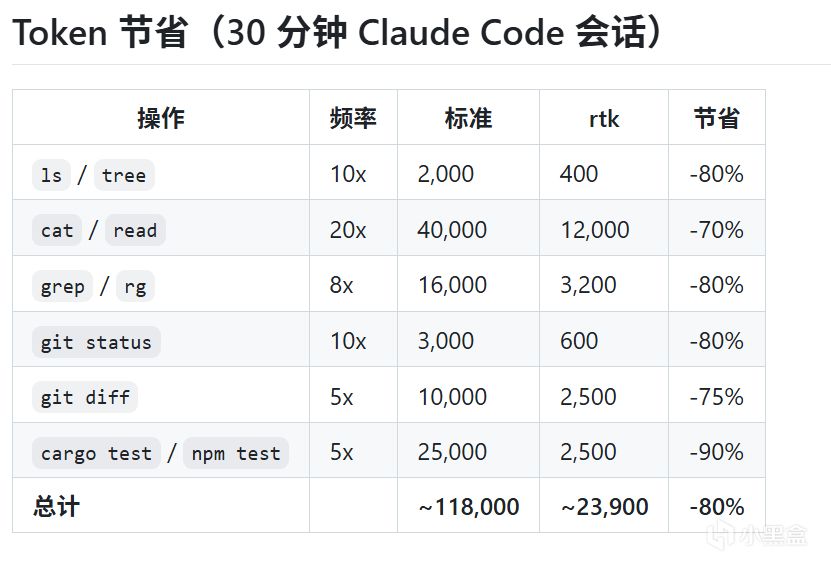

[rtk](https://github.com/rtk-ai/rtk) — 38,082 Stars / Rust / 月增 23,044

一个用于将命令输出到达 LLM 上下文之前进行过滤和压缩的工具,减少 60-90% 的 token消耗。

实现原理:通过 Claude Code 的 PreToolUse Hook 自动把重写命令(比如 git status → rtk git status),获取输出并压缩返回。

三个设计细节:

Tee 原始输出恢复:如果压缩输出还不够用,会自动把原始完整输出缓存到本地硬盘,LLM 随时可以恢复读取,而不需要重新执行。

SQLite token 追踪:每次命令消耗的 token 和执行时间都记录到本地数据库,可以通过 rtk gain 查看累积报告。

零依赖单二进制:全流程 Rust 编译,4-6MB,啥也不依赖,完美适配 macOS / Linux / Windows 三端,开箱即用。

[mattpocock/skills](https://github.com/mattpocock/skills) — 40,781 Stars / Shell / 月增 24,449

Total TypeScript 作者 Matt Pocock整理的 Claude Code Skill集合,形成了一套软件工程解决方案。

解决的是 AI 编程过程中,四大常见痛点:

需求对不齐

输出太啰嗦

代码不自运行

架构一不小心就会塌

`/grill-me`、`/grill-with-docs`(项目最火的skill):多轮问答思考,让 Agent 不断施压追问直到所有分支情况都明确。grill-with-docs 还能自动记录一个 `CONTEXT.md` 作为术语共识,在后续的沟通交流中节省大量 token ,变量命名也自然就统一了。

`/tdd`:测试驱动开发红-绿-重构循环。先编写测试用例,再编写代码实现,形成“Agent 得到真实执行反馈”的循环。

`/diagnose`:科学系统化调试模板——复现问题 → 缩小化 → 假设原因 → 插桩检查 → 找到问题解决 → 回归测试。

`/improve-codebase-architecture`:代码库深度重构,防治 AI 越来越快造成代码熵增。Matt 建议每两三天跑一次。

`/to-prd` + `/to-issues`:把对话内容直接生成 PRD ,再按步骤拆解成可以单独提出认领的 Issue(垂直拆分)。

`/caveman`:沟通最简模式,删掉个 ~75% 的填充语,只保留纯技术含义的提示信息,有效省 token 。

安装也极简:npx skills@latest add mattpocock/skills,选择需要的 skill 即可。

Agent 基础设施

[Hermes Agent](https://github.com/NousResearch/hermes-agent) — 124,014 Stars / Python / 月增 107,890

这个项目应该不需要过多的介绍,前端时间真的是刷屏,月增高达 10.8 万 Star,本月排行榜的绝对统治者。

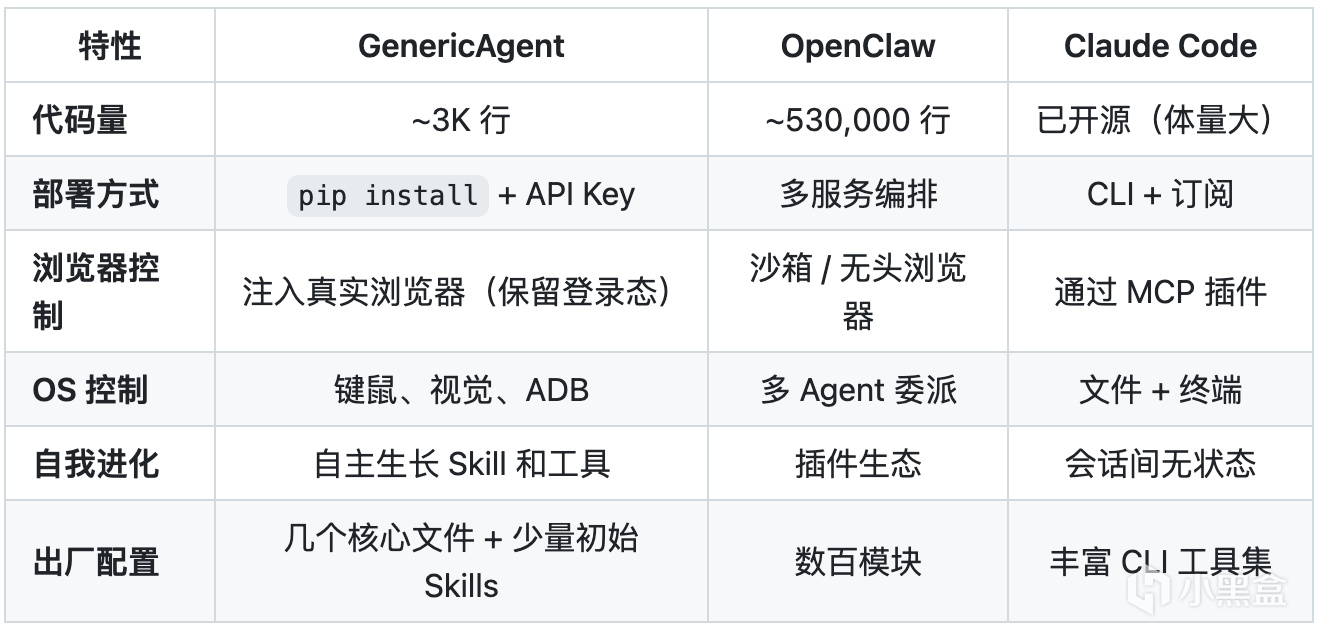

我自己也是从Openclaw迁移到了hermes,不过两个都用过之后我觉得这俩是可以互补的。

openclaw的每个workspace都可以是一个hermes。

[Archon](https://github.com/coleam00/Archon) — 20,094 Stars / TypeScript / 月增 6,309

Archon 是一款面向 AI 编码智能体的工作流引擎。你可以将开发流程定义为 YAML 工作流,包括规划、实现、验证、代码审查、拉取请求创建,并在所有项目中可靠地运行这些流程。

这个项目将AI 编程工作流标准化了,就像 Dockerfile 标准化了基础设施,GitHub Actions 标准化了 CI/CD 这么规范一样。每次运行都是确定性和可重复的。Archon 为每个工作流维护一个 git worktree,能并行运行五个修复 bug 不冲突。

[GenericAgent](https://github.com/lsdefine/GenericAgent) — 8,130 Stars / Python / 月增 7,182

GenericAgent 是一个极简、可自我进化的自主 Agent 框架。核心仅 ~3K 行代码,通过 9 个原子工具 + ~100 行 Agent Loop,赋予任意 LLM 对本地计算机的系统级控制能力,覆盖浏览器、终端、文件系统、键鼠输入、屏幕视觉及移动设备。

它的设计哲学是:不预设技能,靠进化获得能力。

每解决一个新任务,GenericAgent 就将执行路径自动固化为 Skill,供后续直接调用。使用时间越长,沉淀的技能越多,形成一棵完全属于你、从 3K 行种子代码生长出来的专属技能树。

专业领域 / 实用工具

[Kronos](https://github.com/shiyu-coder/Kronos) — 21,944 Stars / Python / 月增 10,628

第一个开源的金融市场 K 线基础模型,用来自全球 45+ 交易所的数据进行预训练的模型。

训练路线图:先将连续的 OHLCV 数据量化为层次化的离散 Tokens,再使用自回归 Transformer 进行预训练。AAAI 2026 论文接受。提供 15M 到 1B 参数不等的模型系列。

这是一个很好的 AI Agent 用于垂直领域的例子:通用型模型不能产生足够好的预测,但是针对金融市场数据专门预训练的模型则可以。

[FinceptTerminal](https://github.com/Fincept-Corporation/FinceptTerminal) — 17,521 Stars / Python / 月增 14,039

现代金融智能端末,集成 CFA 级别的分析、AI 自动化、无限连接数据。宣称要取代 Bloomberg Terminal。

如果说上面的 Kronos 是底层基础模型,那 FinceptTerminal 就是上层应用了。

[markitdown](https://github.com/microsoft/markitdown) — 118,530 Stars / Python / 月增 25,993

微软出品的各种文件格式转 Markdown 工具。支持从 PDF、PPT、Word、Excel、图片(EXIF+OCR)、音频(EXIF+语音转写)、HTML,甚至包含数据的格式 CSV/JSON/XML、压缩包 ZIP 进行转换。

目前总计 11.8 万 Star,本月增长了 2.6 万。这个数据说明:对 AI 输入做格式转换这个看似无用的需求,在 AI 撑起全栈架构的新时代有了新的意义。所有的 LLM 都需要 Markdown 格式的输入,markitdown 就是那条管道。

[OpenScreen](https://github.com/siddharthvaddem/openscreen) — 33,554 Stars / TypeScript / 月增 24,564

Screen Studio 免费开源的替代。录屏 → 自动裁剪缩放 → 添加背景 → 输出高质量 PPT 格式演示视频。

100% 免费且商用可用。功能包括录制指定窗口或者全屏、自动/手动裁剪缩放比例、录制麦克风和系统音频、画中画动态模糊、添加注释标记。用 TypeScript 写的桌面应用。

月增长高达 2.5 万 Star,说明市场上的"PPT 高质量演示视频"需求早就被压抑了。

[PPT Master](https://github.com/hugohe3/ppt-master) — 9,315 Stars / Python / 月增 5,881

AI 将任意文档转换为原生可编辑的 PPTX 幻灯片格式,而不是低能的图片截图或 PDF。

有一个用户问题被解决了:AI 输出 PPT 的大部分工具生成的是图片格式的内容,用户没法在 PowerPoint 中二次编辑。PPT Master 的输出是 PowerPoint 的原生形状和文本框,可以直接修改。

剩下的项目速览

**Google AI Edge Gallery**(22,250 Stars / 月增 6,809):由 Google 提供的用于展示端侧 ML/GenAI 的用例的 Gallery 应用

**Google LiteRT-LM**(4,494 Stars / 月增 3,481):由 Google 提供的端侧 LLM 推理引擎,C++ 实现

**hackingtool**(68,270 Stars / 月增 12,549):收录了安全相关工具的全家桶,老项目本月再度回春

**DeepTutor**(22,493 Stars / 月增 11,653):来自港大的 Agent-Native 个性化学习助手

---

总结

1. AI 编程助手正进入"生态系统"阶段。 榜单前十名中有七个都直接服务于 Claude Code / Codex 等 AI 编程助手。当一个工具周围的生态达到整个 Trending 榜单的规模时,可以认为它已经进化成了底层基础设施。

2. 减少使用 Token 的成本正在成为一个巨大的用户需求。 rtk 在输入端减少 Token,claude-mem 在存储状态时压缩 Token,Karpathy Skills 在减少不必要的输出方面减少了 Token——从不同的角度切入了同一个痛点。Token 的成本是 AI 编程大规模落地的关键瓶颈。

3. 垂直领域定制的小模型开始显现价值。 Kronos 就是针对金融市场 K 线数据专门训练出来的小模型,收录于 AAAI2026。这不是将通用模型套一个新的头,在内核和 tokenizer 层面都重新为特定数据格式设计。后面类似的小模型会涌现在金融市场之外的法律、医疗、工业等领域。

GitHub 4 月的趋势大家也看出来了:AI 编程助手相关的占了一大半。从让 Claude/ChatGPT 写代码更好用的 Skill,到记忆系统,从输入端和输出端的 Token 压缩,到任务编排工作流。

GitHub 上完整排行榜:https://github.com/trending?since=monthly

更多游戏资讯请关注:电玩帮游戏资讯专区

电玩帮图文攻略 www.vgover.com