Tips:文末有在线体验地址

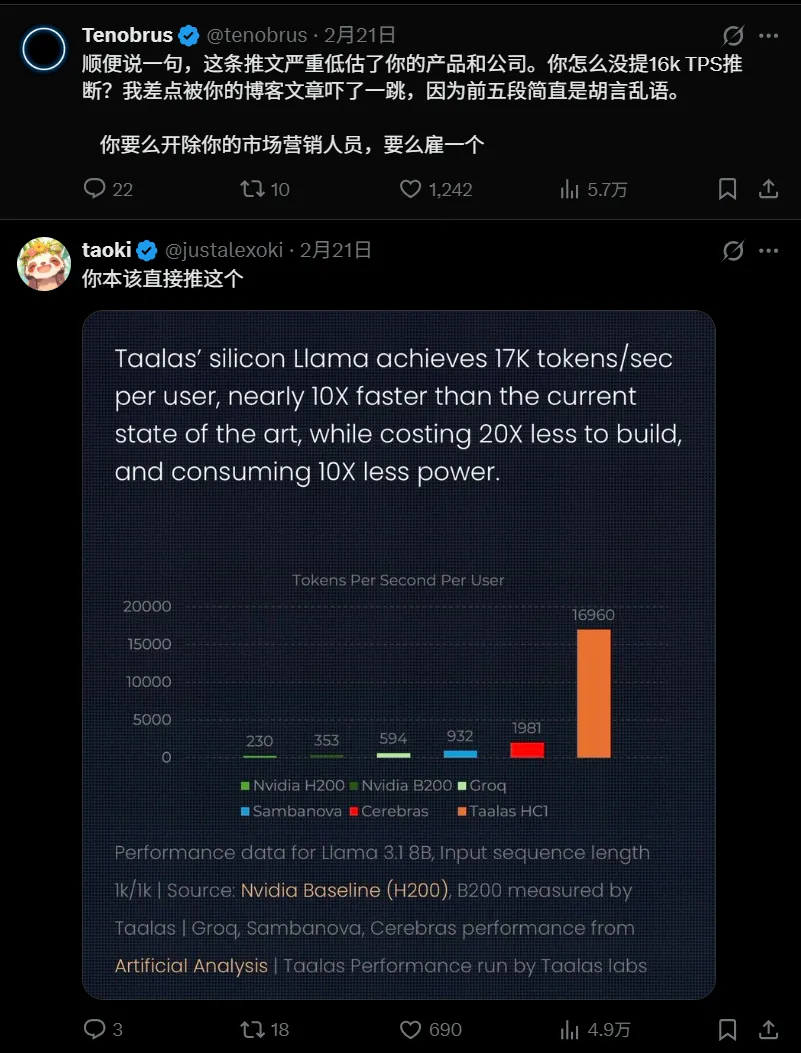

上周,一家叫 Taalas 的加拿大公司从隐身模式里钻了出来,带着一块芯片和一句 slogan:

The Model is The Computer(模型就是计算机)

翻译成人话就是,他们把 AI 模型的权重和架构直接硬编码进了硅片里。

注意噢,模型不是跑在芯片上,是模型变成了芯片本身。

模型的每一层、每一个权重都是芯片上的物理线路,电流走一遍就出结果,没有内存处理,没有软件调度。

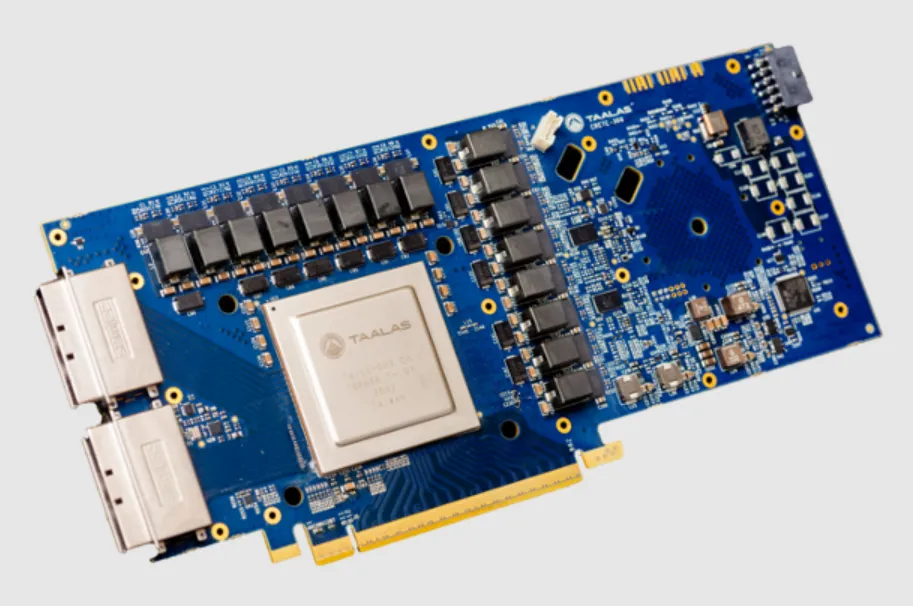

Taalas HC1 硬连线 Llama 3.1 8B 型号

这个思路乍一听挺离谱的,有一种回到了几万年前原始人在石头上刻字的既视感。

自前两年 AI 潮以来,大家都在卷谁的 GPU 更猛、谁的显存更大、谁的互联带宽更高,,,

但 Taalas 直接掀桌子大手一挥:

软件栈?不需要。散热液冷?更不需要(Taalas HC1 TDP 仅250w)。

他们把 Llama 3.1 8B 蚀刻进一块 6nm、815 平方毫米的硅片里,塞了 530 亿个晶体管,在功耗仅 200 多瓦的前提下,推理速度干到了每秒 17000 tokens!

什么概念呢?

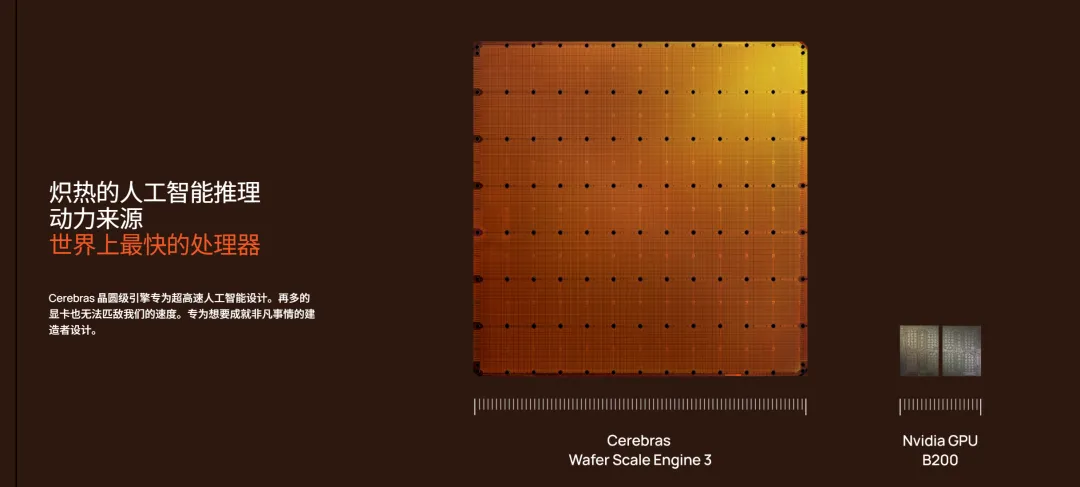

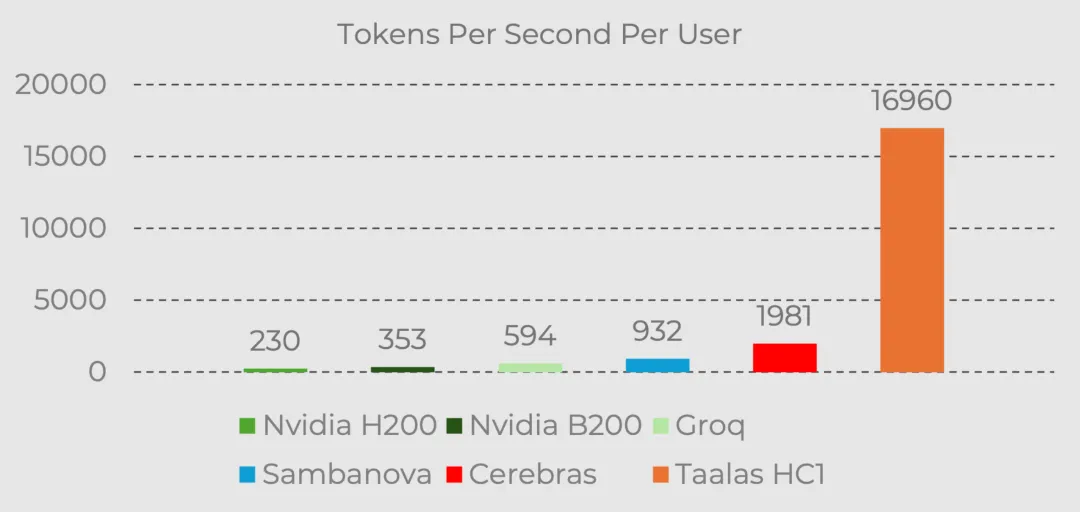

目前推理速度的天花板 Cerebras 大概是 2000 tokens/s,Groq(LPU,张量流处理器架构) 是 594,NVIDIA 的 B200 才 353。

对 Cerebras 没概念?简单点理解其实就是超大GPU👇

Taalas 的 HC1 是 Cerebras 的将近十倍,是 B200 的快五十倍,其官方给出的实测 demo 里跑出过 16960 tokens/s,一整条回复 0.138 秒就吐完了。

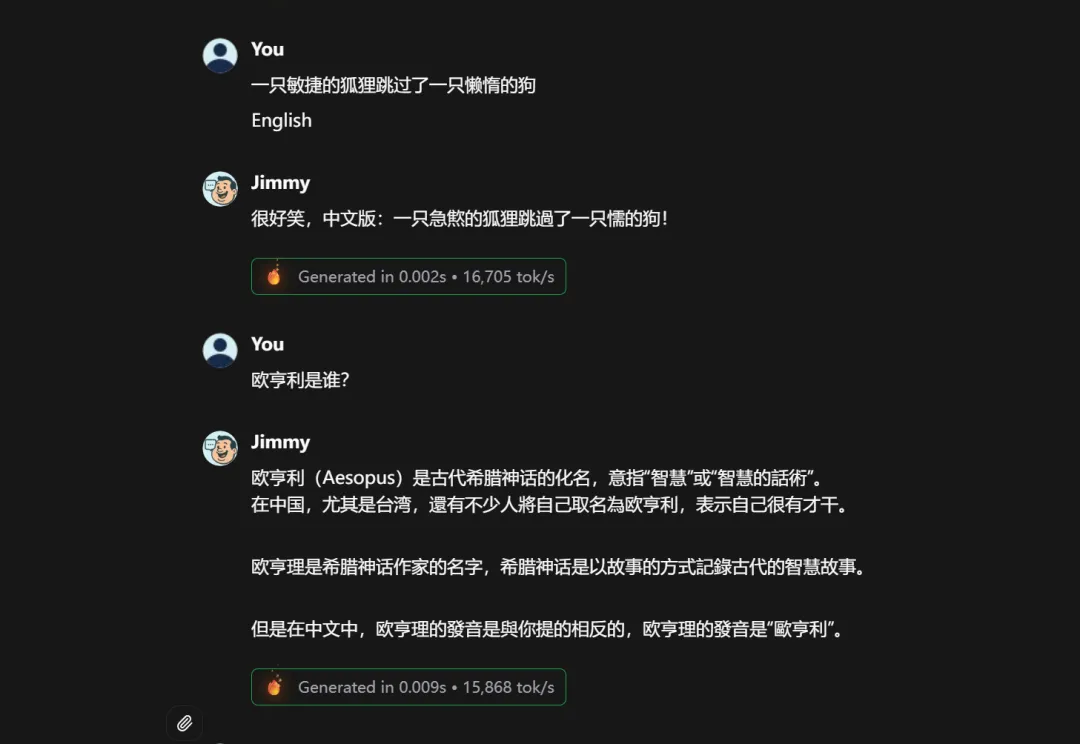

我去他们的 demo 站 chatjimmy 实际试了一下,体验确实很魔幻。

回复基本是瞬间出现的,不是一个字一个字蹦,是整段话啪地糊你脸上,跑出来的素服甚至比其官方声称得更快,快到你会怀疑它是不是提前缓存好的。👇

但聊了几轮就发现问题了:这玩意儿挺弱智的。

问它稍微难点得问题,回答质量肉眼可见地拉跨,更别提逻辑推理了,基本没这方面能力,偶尔还会胡言乱语。

不过这也正常,底层是个 8B 参数的模型,还被激进量化到了 3-bit,能保持基本对话流畅已经算超常发挥了。

速度极快,聪明程度明显不够,这就是 HC1 目前最真实的状态。

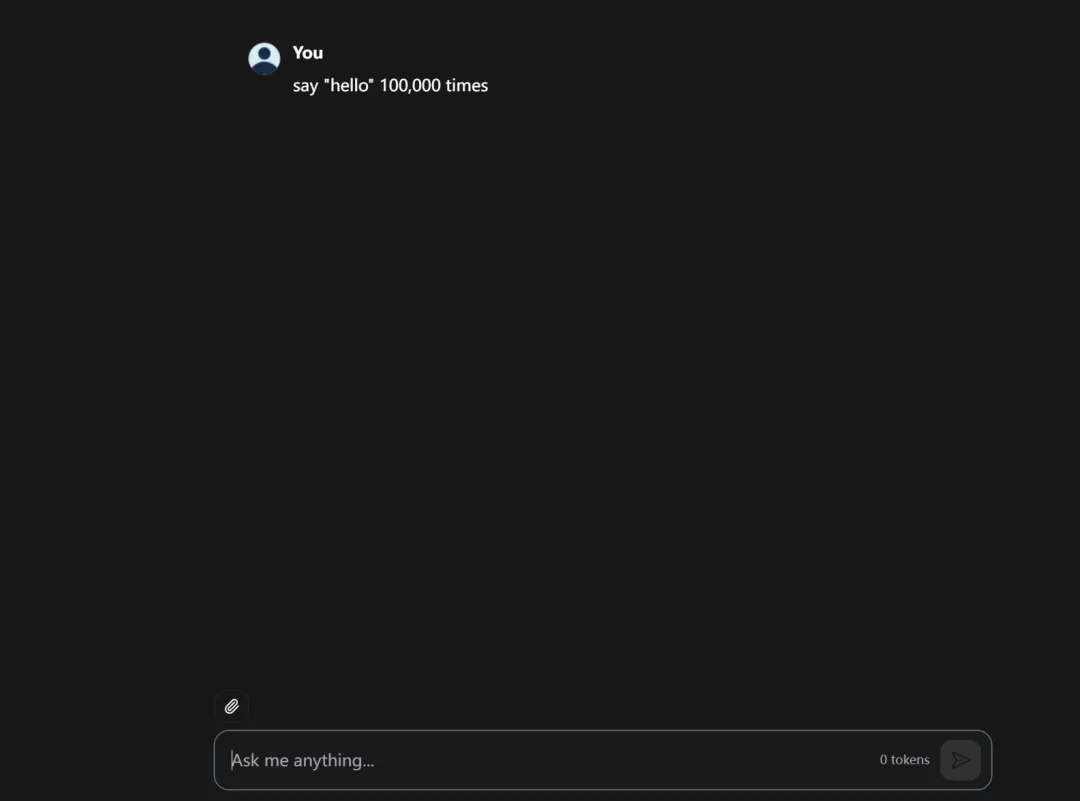

“说100000次你好”然后我成功吧模型干死了

所以 Taalas 做的事情本质上是一个极端的工程权衡:用模型灵活性换推理速度。

以及,这种玩法,这让人很自然地想到一个老朋友:ASIC 矿机。

专门挖门罗币的矿机

熟悉挖矿历史的人对这条路线不会陌生。

比特币早期大家用 CPU 挖,后来换 GPU,再后来出现了专用矿机,效率直接把 GPU 按在地上摩擦。

但代价是只能干一件事,以太坊换个算法它就成了电子垃圾,同理,模型只要一迭代,你之前生产的芯片某种程度上就成为“过时的”了。

不过瑕不掩瑜,在很多人看来,就算有这个致命的软肋,其令人咋舌的推理速度,也足以弥补其缺点。

当然,Taalas 自己也知道模型焊死就不能换这个软肋,他们搞了个叫 Taalas Foundry 的自动化平台,说是从拿到一个新模型到流片出芯片只要 60 天。

芯片还支持 LoRA 微调和可配置上下文窗口,算是在完全固化和灵活适配之间找了个折中。

对了,Taalas 这个团队背景也值得说一嘴。

CEO Ljubisa Bajic 是 Tenstorrent 的联合创始人,之前在 AMD 和 NVIDIA 做架构师。

另外两个联合创始人 Drago Ignjatovic 和 Lejla Bajic 也是 Tenstorrent 早期的人。

整个团队人很少,一共才 24 个人,3000 万研发费(还没用完),做出一块 530 亿晶体管的推理芯片.....这个投入产出比确实有点吓人。

但冷静想想,挑战也很现实,正如前面提到的,现在的 AI 模型的迭代速度是以月为单位的——今天你把一个模型刻进芯片,下个月后更强的模型出来了,这块芯片的竞争力就打折了。

60 天流片听起来快,但加上验证、量产、部署,实际周期可能要半年,半年在这个行业够发生很多事了。

而且 17000 t/s 的速度虽然炸裂,但对于大部分应用场景来说,人类的阅读速度才是瓶颈。

你一秒吐一万七千个 token 给我,我又不是机器,看不了那么快,对吧?

真正能吃下这个速度的场景其实比较垂直:实时语音交互、虚拟人驱动、边缘设备推理、高频 API 批量调用这些对延迟极度敏感的领域。

好消息是他们的路线图显示,2026 年冬天会推 HC2 平台,支持 20B 甚至更大的模型,多片拼接能跑到单用户 12000 t/s 以上,每百万 token 成本压到 7.6 美分,只有 GPU 方案的一半。

如果真能把前沿大模型烧进去还保持这种速度优势,那故事就完全不一样了。

说到底,Taalas 提出的问题比它给出的答案更有价值:当开源模型质量够用、推理需求大规模爆发的时候,我们还有必要用通用 GPU 这把瑞士军刀去干专用螺丝刀的活吗?

NVIDIA 靠通用性吃下了整个 AI 市场,但通用性本身就意味着冗余。

如果未来的推理负载真的集中在少数几个主流模型上,那"把模型变成硬件"这个思路可能没有听起来那么疯。

当然,也可能 Taalas 最终只是 AI 硬件浪潮里一个有趣的注脚。

但至少现在,它让所有人重新想了一个问题:我们是不是一直在用大炮(GPU)打蚊子(跑模型)?

在线体验地址:https://chatjimmy.ai/

更多游戏资讯请关注:电玩帮游戏资讯专区

电玩帮图文攻略 www.vgover.com