在最近的Siggraph大會上,NVIDIA展示了一種名爲“神經外觀模型”(Neural Appearance Models)的新實時渲染方法,通過利用AI技術,大幅提升了材質渲染性能。

去年,NVIDIA推出了其神經壓縮技術,使紋理細節提高了16倍。今年,公司進一步提升了紋理渲染和着色性能,實現了驚人的性能飛躍。

主要特點和優勢

NVIDIA的這一新方法將成爲適用於所有材質的通用運行時模式,不論是由藝術家捕捉的真實物體、測量數據還是通過生成式AI從文本提示生成的材質。

這些模型將在不同的質量水平上進行擴展,從PC/主機遊戲、虛擬現實到電影渲染都涵蓋在內。

細節捕捉:這種方法能夠捕捉對象的每一個細節,如灰塵、水漬、光線和各種光源及顏色混合產生的光線。

性能提升:傳統的材質渲染模型被NVIDIA的神經網絡取代,使得渲染計算性能提升12-24倍。

應用範圍廣:該方法不僅適用於遊戲,還適用於電影製作和虛擬現實等領域。

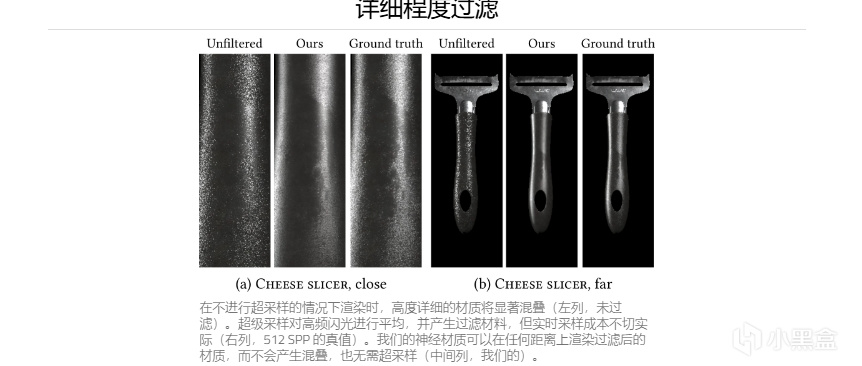

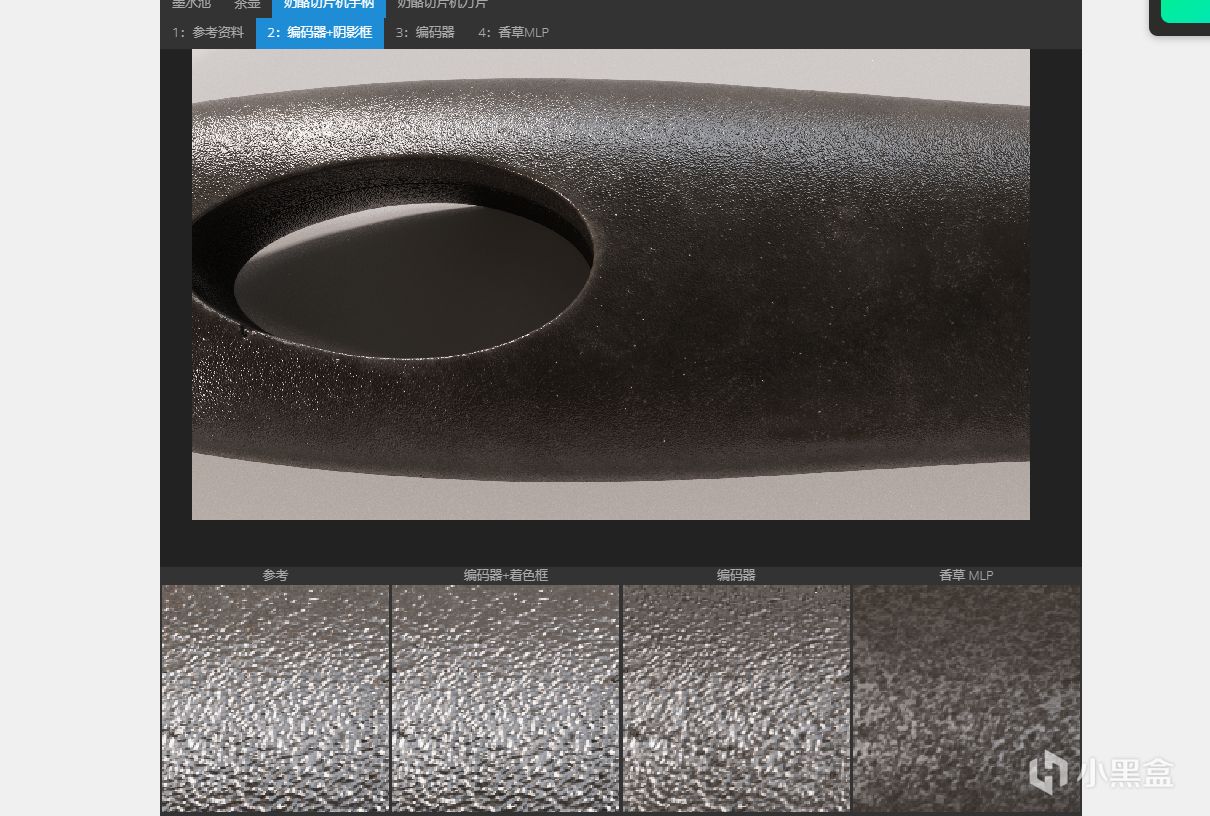

渲染示例和技術細節

NVIDIA展示了使用傳統着色圖和神經材質模型渲染的模型對比,神經材質模型在各方面都匹配參考圖像,並且渲染速度更快。所有通過“神經材質”方法渲染的模型都支持高達16K的紋理分辨率,提供了遊戲中的深入和詳細對象,同時減少了遊戲的性能負擔。

支持硬件和工具

NVIDIA表示,這些神經材質模型將利用現有的機器學習框架,如PyTorch和TensorFlow,工具如GLSL或HLSL,以及在AMD、Intel和NVIDIA的各類GPU架構上的硬件加速矩陣乘加(MMA)引擎。運行時着色器將使用開源的Slang着色語言編譯神經材質描述成優化的共享代碼,這些代碼支持Vulkan、Direct3D 12和CUDA等多種目標。

性能展示

NVIDIA使用GeForce RTX 4090 GPU進行硬件加速DXR(光線追蹤)在1920x1080分辨率下進行性能展示。結果顯示,新神經方法在渲染圖像時速度更快,細節更好。以全幀渲染時間爲單位,4090在使用3x64模型參數時實現了1.64倍的性能提升,在使用2x16模型參數時達到了4.14倍的提升。在路徑追蹤的材質着色性能上,2x32參數實現了1.54倍的提升,3x64參數則實現了6.06倍的提升。

總結

NVIDIA的神經材質模型方法重新定義了實時渲染材質和對象的方式,性能提升高達12-24倍,將使開發者和內容創作者能夠更快地生成超現實的材質和對象,並在最新硬件上運行更快。希望這一方法在即將到來的遊戲和應用中得到廣泛應用。

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com